英伟达与云巨头必有一战

HelloKitty • 2023-08-24 15:17

3110

本文由 甲子光年 撰写/授权提供,转载请注明原出处。

文章来源于:甲子光年

作者:赵健

“为了食物而奔跑,或者为了不被他人当食物而奔跑。无论哪一种情况,都要保持奔跑。”

这是英伟达 CEO 黄仁勋今年在台湾大学演讲中对毕业生的寄语,当然它也是黄仁勋一手缔造的这家万亿市值帝国的心态诠释。

2023 年,奔跑中的英伟达遇到了生成式 AI,黄仁勋多次称之为“AI 的 iPhone 时刻”。在这一时刻,黄仁勋把目光瞄向了一个成为猎手而非猎物的机会——云。

英伟达貌似不应该有做云的动力,不仅因为云服务商都是英伟达的重要客户,每年向英伟达采购数十亿美元的 GPU,更因为这件事看上去毫无胜算。

今天的云计算市场被亚马逊 AWS、微软 Azure、谷歌云三大云巨头牢牢把控。根据 Statista 数据,2022 年 AWS 的市场份额为 32%,Azure 为 23%,谷歌云为 10%,三家合计市场份额达到了 65%。

我们并非没有看到挑战者。过去十年,VMware、戴尔、惠普等知名企业都想在云计算的市场分一杯羹,但无一例外都失败了。

然而,正如每一次技术革命都会产生新的弄潮儿,这一次生成式AI的浪潮,芯片厂商英伟达开始向云计算市场一步一步试探:

第一步,在今年 3 月 21 日的 GTC 大会上,英伟达发布了 DGX Cloud。从名字就可以看出,这是一款云产品,客户可以通过按月租用的方式,直接在云端或者本地数据中心获取英伟达的 AI 产品与服务;

第二步,投资三大云巨头的竞争对手。英伟达今年先后投资了 CoreWeave、Lambda Labs 两家美国的中小云服务商,并且向其倾斜分配稀缺的 GPU 芯片。这种“偏爱”有多夸张?在 GPU 一芯难求的当下,CoreWeave 却能通过抵押其囤积的充沛的 GPU——尤其是 H100,而获得了 23 亿美元的债务融资。

尽管才刚刚开始,但布局云业务代表了英伟达对于云巨头的反击。

众所周知,谷歌、亚马逊、微软先后在内部启动自研 AI 芯片项目——谷歌的 TPU 系列,亚马逊的 Inferentia 和 Trainium 系列,以及微软今年被曝光的 Athena 芯片。三大云巨头都有充分的资源与动力自研 AI 芯片,来削减英伟达的“GPU 税”。

英伟达对此心知肚明。黄仁勋在上一季度财报的电话会上直言“我们一直在关注竞争,而我们一直都有竞争”。

黄仁勋并不能阻止三大云服务商的扩张行为,但或许最好的防守就是进攻,英伟达的反击方式是直接下场做云。

凭借手上的 A100、H100 两张王牌——在很长的一段时间内,这两款芯片都是大模型训练与推理的最佳选择且没有之一,英伟达有机会成为云计算市场真正意义上的幕后操盘手。

一场围绕着芯片与云计算的明争与暗斗,正在这四家全球市值前五名的科技巨头中缓缓展开。

差点倒在黎明之前

熟悉英伟达的人会知道,今天的英伟达有多风光,去年的英伟达就有多惨烈。

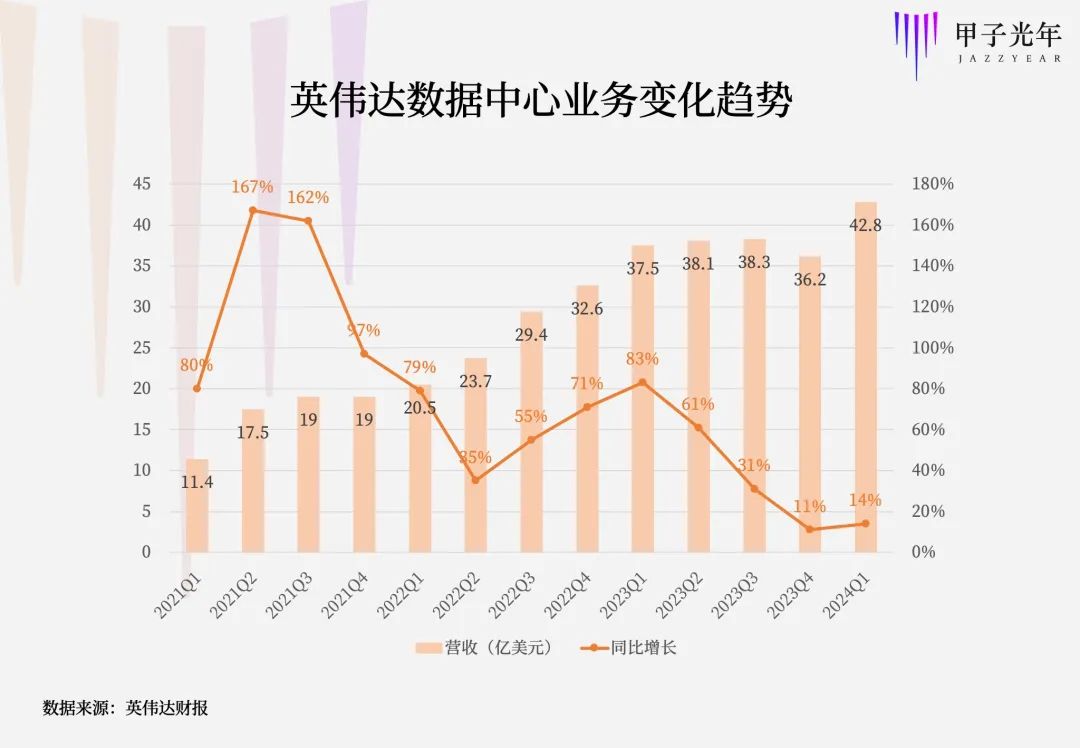

英伟达的核心业务包括数据中心、游戏、专业可视化以及汽车四大板块。2020 年第二季度,英伟达数据中心业务首次超过游戏,成为英伟达的第一大收入来源。

在 2022Q4 财报会(对应自然年 2021 年 11 月~2022 年 1 月)上,英伟达交出了强劲的第四季度财报,数据中心业务同比增长 71%。当时的黄仁勋乐观地表示:“英伟达运算平台迎来超乎寻常的市场需求。”然而一周之后,俄乌冲突爆发,干扰了关键原物料供应链。加上疫情影响,整个 2022 年,英伟达数据中心业务增速不断放缓。

今年 2 月发布的 2023Q4 财报业绩,英伟达数据中心增速仅 11%,创下了历史新低,也是自 2020 年以来首次环比下滑。

2022 年,英伟达的股价也惨遭腰斩。当然,今天它已经涨回来了,ChatGPT 的横空出世拯救了英伟达。

注:英伟达即将在本周三(8月23日)发布2024Q2财报,对应2023年5月-7月。

在导致业务增速下滑的众多原因中,大客户需求的缩减最值得警惕。在 2023Q4 财报会上,英伟达 CFO Colette Kress 公布了一个数字:2023 财年数据中心部门的 150 亿美元收入中,有大约 40% 的收入(约 60 亿美元)来自超大规模数据中心和云服务商。

但如果只看第四季度,这一比例仅占四分之一。超大规模数据中心建设者与云服务商正在大量减少 GPU 的支出。

除了客观的需求下滑,三大云巨头不断推进的自研 AI 芯片计划,正一点一点蚕食英伟达 GPU 的市场份额。

谷歌在 2016 年推出了第一代自研 AI 芯片 TPU,五年之后的 2021 年 5 月 19 日又推出了第四代 TPU v4。在今年发表的一份研究报告中,谷歌称已将 4000 个 TPU v4 串联在一起,构建了一台超级计算机,这台超级计算机的运行速度要比采用英伟达 A100 GPU 的同等机器快 1.7 倍,效率高出1.9倍。

亚马逊也有自研芯片的传统,这不仅是针对英伟达,而是针对所有芯片厂商。目前,亚马逊已经推出了四个系列的自研芯片——网络芯片 Nitro 系列,服务器芯片 Graviton 系列,AI 推理芯片 Inferentia 系列、AI训练芯片Trainium。其中,后两款AI芯片与英伟达GPU存在竞争关系。

尽管入局较晚,但微软“虽迟但到”。今年 4 月 18 日,据 The Information 报道,自从 2019 年以来,微软一直在秘密研发 AI 芯片,内部代号为“雅典娜”(Athena),有数百名员工正在从事 Athena 项目,微软已投入了约 20 亿美元。微软与 OpenAI 的一些员工,已经可以拿到芯片来测试在 GPT-4 等最新大语言模型上的表现。

云服务商每年因采购 GPU 要交大量的“英伟达税”,尤其是在生成式 AI 爆发之后。

今年 2 月,New Street Research 曾做过一次预估:基于 ChatGPT 的 Bing 搜索引擎,要想在一秒钟之内响应用户的提问,需要 8 个 GPU。按照这一速度,微软需要超过 2 万台包含 8 个 GPU 的服务器才能将 Bing 中的模型部署给每一名用户,而这将花费微软 40 亿美元。如果是谷歌这样的规模,每天处理 80~90 亿次查询,则需要花费 800 亿美元。

云服务商自研 AI 芯片并不会对外销售,并不会与英伟达产生直接的竞争。但是,通过将自研芯片替代 GPU 部署到数据中心里,可以有效削减成本。比如,谷歌已在其云服务中部署了数百台 TPU v4 超级计算机。

三大云服务商都有充分的资源与动力去自研芯片,这被看做是英伟达帝国的一条裂缝。英伟达对此心知肚明,但似乎没有更好的办法。

直到 ChatGPT 的出现,被云服务商步步紧逼的英伟达看到了反击的突破点。既然云服务商可以做芯片,那英伟达难道不能在AI时代做云吗?

英伟达做云有机会吗?

英伟达目前是生成式 AI 革命的最大受益者,黄仁勋今年也总是把“AI 的 iPhone 时刻”挂在嘴边。生成式 AI 爆发的需求,让 GPU 成为了硬通货,有人干脆称“GPU 就是新的美元”。

从 GPU 到云,英伟达真的有机会吗?

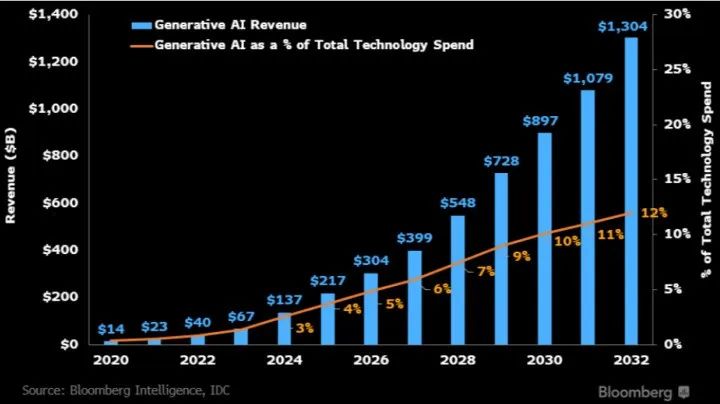

生成式 AI 的训练与推理主要是在云端进行,提供 AI 基础设施的云服务商将是生成式 AI 浪潮的最大受益方之一。根据硅谷风投机构 A16Z 估算的数据,生成式 AI 所产生总收入的 10%~20% 最终流向了云服务商。

但是,这个过程不会很快。亚马逊 CEO 安迪·贾西在 2023 年 Q2 财报电话会上称:“生成式 AI 无疑将改变几乎所有客户的体验。但现在还为时尚早,大多数公司仍在考虑如何实现这一目标。我们处于一个非常早期的阶段,这是一场马拉松。”

云服务的本质是将数据中心内的硬件资源虚拟化,然后租给市场。传统数据中心的服务器几乎 100% 是基于英特尔、AMD 的 CPU 而建设,CPU 像是一名“拥有最强大脑的通才”,它向外提供“通用计算”能力——处理操作系统、系统软件与应用程序这一类拥有复杂指令调度、循环、分支、逻辑判断与执行等程序任务。

但 CPU 并不擅长大规模的数据处理与并行计算,而这正是人工智能所需要、英伟达 GPU 所擅长的。GPU 像是一名“暴力计算的专才”,专门对付图像处理、深度学习以及当下的大模型训练、推理等任务。黄仁勋将这种大规模并行计算能力称为“加速计算”。

2012 年,深度学习之父杰夫·辛顿及其徒弟首次尝试在英伟达 GPU 上训练卷积神经网络模型 AlexNet,并在图像识别大赛中一举夺冠。这件事催生了接下来十年的深度学习大爆发,整个人工智能行业包括英伟达自己,都意识到了 GPU 做加速计算的潜力。

英伟达命运的齿轮开始转动。此后,黄仁勋在很多场合呐喊“摩尔定律已死”。他认为,CPU 扩张的时代已经结束,每五年以同样成本获得十倍性能的提升也已经结束。取而代之的将是 GPU,黄仁勋专门发明了一个“黄氏定律”——GPU 将推动 AI 性能实现逐年翻倍。

2012 年~2022 年的十年间,我们可以称之为加速计算的从 0 到 1,人工智能在图像识别等特定行业、特定场景落地。但是,这一时期 AI 需求还是不够大,研究机构 Aletheia 预测,当前 AI 服务器的市场渗透率还不足 5%。这对于实现黄仁勋加速计算的梦想还远远不够。

直到 2022 年 11 月 ChatGPT 诞生,“AI 的 iPhone 时刻”出现了。这可以看做加速计算从 1 到 10 规模化增长的开始。

生成式AI收入(图片来自彭博社)

黄仁勋认为,加速计算与生成式 AI 两大发展趋势相结合,将改变过去 60 年来的计算方式。随着公司竞相将生成式 AI 应用到每个产品、服务和业务流程中,价值万亿美元的全球数据中心基础设施将从通用计算过渡到加速计算,由此引发的数据中心重塑必将创造出巨大的市场机遇。

上一季度的财报电话会中,黄仁勋信誓旦旦地表示:“我们正处于一个为期十年的数据中心智能化的第一年。”

黄仁勋表示,加速计算是一个全栈挑战,它必须把所有的软件、所有的框架库、所有的算法集成在一起进行工程化,这些工作不仅仅是针对一颗芯片,而是针对整个数据中心。数据中心就是一台超级计算机,要获得最佳性能,需要对网络操作系统、分布式计算引擎、网络设备、交换机、计算架构等全栈内容进行优化。

比如,通用计算数据中心主要使用以太网将所有服务器进行连接,不需要大规模的数据传输;英伟达提出的加速计算数据中心使用名为 Infinite Band 的技术进行连接,具有极高的数据吞吐量。

系统性的优化也让加速计算数据中心比传统数据中心有更高的效率、更低的成本。

黄仁勋在今年 8 月举办的计算机图形年会 SIGGRAPH 上抛出了一个问题:“花 1 亿美元能买什么?”黄仁勋自问自答:“过去,1 亿美元能买 8800 块 x86 CPU 组成的数据中心,功耗是 5MW;今天,1 亿美元能买 2500 块 GH200 组成的 Iso-Budget 数据中心,功耗是 3MW,AI 推理性能达到上述 CPU 数据中心的 12 倍,能效达 20 倍。”

在相同的 AI 推理性能下,GPU 数据中心的成本只有 CPU 数据中心的 1/12。“买得越多,省得越多。”这是黄仁勋对其加速计算数据中心的带货宣言。

迄今为止,英伟达已经建设了 5 座数据中心,并帮助世界各地的客户建立自己的数据中心。而且,传统的数据中心从交付到运行可能还需要数月甚至一年之久,而在英伟达。这一时间以周为单位。“团队在这方面的专业知识非常了不起。”黄仁勋表示。

对于三大云巨头而言,从通用计算数据中心到加速计算数据中心的过渡不会很快。这不仅关乎技术与能力,也关乎这类巨头公司的决策与流程,俗话说“船大难掉头”。

这就给了英伟达做云的机会。从数据中心向前一步迈向云只是一件水到渠成的事,而且,英伟达已经在尝试这么做了。

暗度陈仓

就在数据中心业务增速最低的 2023 年 Q4 财报上,英伟达同时还预告了一款新产品——DGX Cloud。在一个月之后的 GTC 大会上,DGX Cloud 正式发布。

从名字就可以看出,这是一款云服务产品。难道英伟达要进军云计算市场了?

先来看下 DGX 是什么。DGX 是英伟达在 2017 年首次发布的超级计算机,黄仁勋称之为“装进机箱里的数据中心”。

第一代 DGX 内部集成了 8 块 GPU(Tesla P100)与 4 块固态硬盘,并使用了英伟达 NVlink 连接技术。在深度学习训练上,单台 DGX 的性能相当于 250 台普通 x86 服务器。当然,它也很贵,单台售价 12.9 万美元。

会后,黄仁勋将第一台 DGX-1 赠送给了埃隆·马斯克。马斯克是 OpenAI 的联合创始人,OpenAI 就是从这台超级计算机开始,一步一步打造了今天的 ChatGPT。

图片来自网络

今天,DGX 超级计算机已经发展到第五代,前四代分别为 DGX P100、DGX A100、DGX H100,以及最新的 DGX GH200。

英伟达发布的 DGX Cloud,就是此前发布的超级计算机的云版本,一个 DGX Cloud 实例(云服务器中的虚拟计算机)配置了 8 张 A100 或 H100。

然而,DGX Cloud 的售价并不便宜,每个月 36999 美元,大约 26.4 万人民币。作为对比,含有 8 颗 A100 的微软 Azure ND96asr 实例与其同等规格,每个月费用为 19854 美元,只有 DGX Cloud 的一半。

为什么英伟达敢定如此高的价格?答案在于 DGX Cloud 是一款集成了软件与硬件的交钥匙解决方案。英伟达现在已经不再标榜自己是一家 GPU 芯片公司,而是定位一家计算平台公司。

DGX Cloud 除了硬件资源,还推出了两个配套软件平台,一是 NVIDIA AI Foundations,帮助企业创建定制模型,包括语言、视觉与生物医药模型等;二是 NVIDIA AI Enterprise,它包含了 4000 个不同的 AI 框架,帮助企业开箱即用。英伟达的 AI 产品与国内阿里云等云服务商推出的 MaaS 类似。

黄仁勋对这些新的软件收入来源非常乐观,并预计生成式 AI 领域的收入将从公司总收入的“个位数”部分增长到未来一年内“相当大”的一部分。“我们对新商业模式的拓展感到兴奋。”黄仁勋表示。

DGX Cloud 的推出客观上与云服务商形成了一定的竞争关系,但英伟达仍想继续与云服务商保持紧密合作。英伟达当前并不会从零开始构建完整的云基础设施,而是把 DGX Cloud 托管在各家云服务商的云平台上。

英伟达将基础硬件设施出售给云厂商,再向他们购买云计算资源,最后把云服务出售给企业客户并自留全部收入。客户仅通过浏览器,就可以访问英伟达的AI超级计算机,来使用英伟达的 AI 产品与 AI 模型服务。

但是,云服务商会买账吗?

对此,黄仁勋是这样解释的:“英伟达云服务与云服务商的合作将是一次双赢,双方将共同创建新的应用程序并开发新的市场。”黄仁勋表示,理想情况下,客户采购英伟达 DGX Cloud 与云服务商的云的比例为 1:9。

Oracle 是第一家宣布与英伟达合作的云服务商。这家软件巨头近几年正急迫地进行云转型,因此有充分的动力与英伟达组成同盟,以期在云计算市场打一张翻身仗。英伟达也正在与微软 Azure、谷歌云和其他云平台合作,预计也将很快推出。

英伟达的如意算盘打得响亮,但并不是所有的云服务商都会接受英伟达的要求。AWS 就拒绝与英伟达就 DGX Cloud 产品进行合作。

据路透社报道,亚马逊弹性云计算副总裁 Dave Brown 表示:“英伟达联系了我们,我们研究了商业模式。但对于 AWS 来说,这没有多大的意义。”他认为,AWS 在构建可靠服务器方面拥有长期经验,并且拥有现有的供应链专业知识。

AWS 在今年 3 月份开始购买英伟达的 H100 芯片,但仅作为其自研系统的一部分。AWS 还在考虑使用 AMD 最新的人工智能芯片 MI300,但尚未做出最终决定。

面对一个新兴的生成式 AI 市场,英伟达与云服务商的利益分配,还将会持续地变化。但相当明确的是,英伟达已经动了云服务商的奶酪。

釜底抽薪

推出 DGX Cloud 仅仅是第一步,英伟达对云计算市场的参与度还在进一步加深。这一步,英伟达没有选择亲自下场,而是选择扶持三大云巨头的竞争对手。

今年,一家名为 CoreWeave 的中小云厂商异军突起,成为了比三大云巨头更炙手可热的云服务商。CoreWeave 称自己是全球范围内唯一一家可以“大规模提供英伟达 H100”的云服务商。

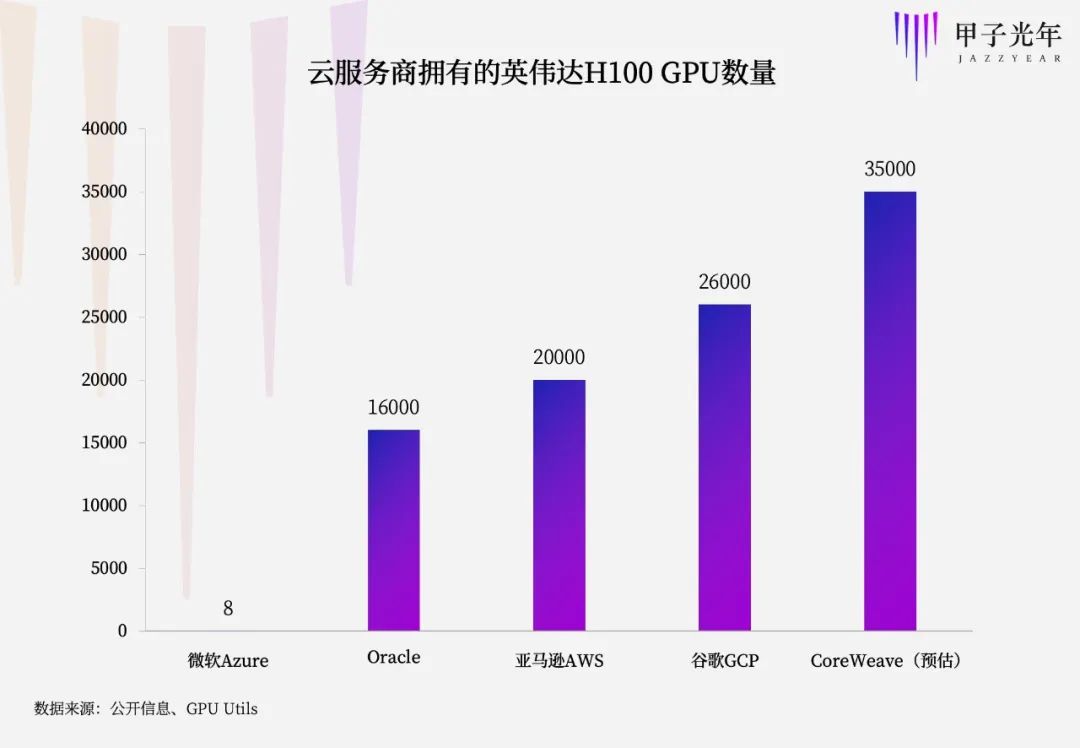

据 GPU Utils 网站预估,CoreWeave 向英伟达预定的的 H100 数量约为 35000-40000 张。对比来看,谷歌在今年 5 月发布的超级计算机 A3 拥有大约 26000 个 H100,亚马逊 AWS 在 7 月上线的 EC2 P5 虚拟机实例基于 20000 块 H100 构建,微软在 8 月上线的 Azure ND H100v5 虚拟机,仅仅包含 8 块 H100。不过,微软拥有大约 28.5 万块 A100。

CoreWeave 到底是什么来历?这家成立于 2017 年的公司,最初主要经营以太坊加密货币挖矿业务,在 2018 年干到了北美最大的以太坊矿工。当时的 CoreWeave 部署了超过 50000 个 GPU,提供了以太坊网络1%以上的算力。

在挖矿之外,CoreWeave 也开始尝试服务一些企业客户,比如人工智能、娱乐媒体与计算化学。2019 年,CoreWeave 从消费级 GPU 全面转向英伟达的企业级 GPU,因为企业级 GPU 可以全天候运行,让 GPU 的利用率提高到近乎 100%。

2021 年,CoreWeave 正式上线了基于英伟达的 GPU 云平台。2022 年第三季度,随着以太坊的合并,大规模显卡挖矿时代结束,CoreWeave 彻底转型成为一家云服务提供商,并在这一年 11 月宣布成为首批提供采用 NVIDIA HGX H100 超级芯片的云服务商之一。

与亚马逊、微软、谷歌这三大巨头相比,CoreWeave 并不打算自研 AI 芯片,这得到了英伟达极大的赏识。

2023 年 4 月,英伟达深化了与 CoreWeave 的合作,在业务合作之上又跟投了 CoreWeave 的 2.21 亿美元 B1 轮融资。最重要的是,英伟达向 CoreWeave 提供了稀缺的 A100、H100 的独特渠道。

在近期彭博社的采访中,CoreWeave 联合创始人&首席战略官 Brannin McBee 表示,英伟达今年的芯片已经卖光了,CoreWeave 的订单也排到明年 Q2 季度了。

CoreWeave 可能囤积了世界上最多的英伟达 GPU。在当下 GPU 短缺的背景下,芯片甚至比股权更值钱,CoreWeave 开创了一种创新性的融资方式。今年 8 月,CoreWeave 将手上的 GPU 芯片做抵押,以此获得了 23 亿美元的债务融资。此前,CoreWeave 的 B1 轮股权融资仅获得 4.21 亿美元。

凭借与英伟达组建的“云+GPU”战略联盟,CoreWeave 的业绩也一飞冲天。

在今年之前,CoreWeave 还只是一家名不见经传的公司。但现在,CoreWeave 准备通过其 GPU 从中赚取数十亿美元的收入。在接受 VentureBeat 采访时,CoreWeave 联合创始人兼首席战略官 Brannin McBee 透露,2022 年 CoreWeave 的收入为 3000 万美元,今年将达到5亿美元,明年已经签订了近 20 亿美元的合同。

CoreWeave 还宣布在德克萨斯州建立一个耗资 16 亿美元的新数据中心,并在年底之前将数据中心扩展到 14 座。目前,AI 明星独角兽 Inflection 正在使用 CoreWeave 的云来构建大约 22000 块 H100 的 GPU 集群,这家公司在今年 7 月宣布了新一轮 13 亿美元的融资。值得一提的是,Inflection 的投资人中也有英伟达的身影。

CoreWeave 是英伟达今年投资的第一家云计算公司,但不是唯一的一家。

据 The Information 报道,英伟达即将与另一家云服务商 Lambda Labs 达成投资协议,英伟达可能投资 3 亿美元,Lambda Labs 的估值将突破 10 亿美元。Lambda Labs 称能提供全世界价格最低的 NVIDIA A100、H100 算力资源。

而当前,凭借对 GPU 资源的“合理”分配,英伟达成为了实际意义上云计算市场的操盘手,从根源上拿捏了云巨头的把柄——微软就是一个很好的案例。

微软在最近一次财报中添加了一条新的风险因素:“如果无法为其数据中心获得足够的人工智能芯片,服务可能会中断。”

面对庞大的 AI 计算需求,微软的 GPU 负载供不应求,甚至不得不向自己的竞争对手中小云厂商求助。据 CNBC 报道,微软“已同意在未来几年内斥资数十亿美元购买初创公司 CoreWeave 的云计算基础设施”。在英伟达的操控下,微软不得不允许 CoreWeave 这样的中小云服务商从 GPU 中赚一层差价。

通过投资入股中小云服务商,英伟达的半只脚已经涉足云计算领域。虽然还没有尝试直接下场构建云基础设施与云巨头展开全面的、直接的竞争,但如果将来英伟达直接通过收购中小云服务商等方式入场,我们也不会感到惊讶。

无论英伟达最终是否会躬身入局,它都成了生成式 AI 浪潮中云计算市场最大的幕后玩家。

扫码关注公众号

获取更多技术资讯