最受欢迎开源大模型,为什么是通义?

HelloKitty • 2024-09-20 17:27

7351

本文由 AI科技评论 撰写/授权提供,转载请注明原出处。

文章来源于:AI科技评论

作者:张进

编辑:陈彩娴

开源与闭源之争早已非新奇的话题,但毋庸置疑的是,开源极大地促进了大模型技术发展和生态繁荣。

大模型被认为是最烧钱的技术,训练一个大模型往往需要大量的数据、计算资源,导致训练成本巨大,众所周知 GPT-3 的训练费用据说超过 4600 万美元,在大模型开源之前,大模型一直是那些有大量资金加持的大厂和明星创业公司才有资格碰的事情。

随着如 llama、Mistral、Falcon 这些开源先锋搅动了整个大模型竞争浪潮,那些没有 AI 积累的企业、大量中小公司团队,今天个人开发者,都能基于开源底座模型,用很低的成本训练、部署自己的专属模型,llama 这样的开源先锋也因此拥有一众拥趸。

回到国内,在 llama、Mistral 这样的开源先锋影响下,国产开源也经历了百家争鸣阶段,如 ChatGLM、Baichuan、DeepSeek、Qwen 也曾掀起一阵阵开源浪潮。

“百模大战”至今不过一年多,全球开源格局已几经变换,最出人意料的一件事,莫过于国产开源大模型先发后至,有了比肩全球顶尖开源模型的影响力。通义千问开源模型,就是“国模开源”的代表角色。

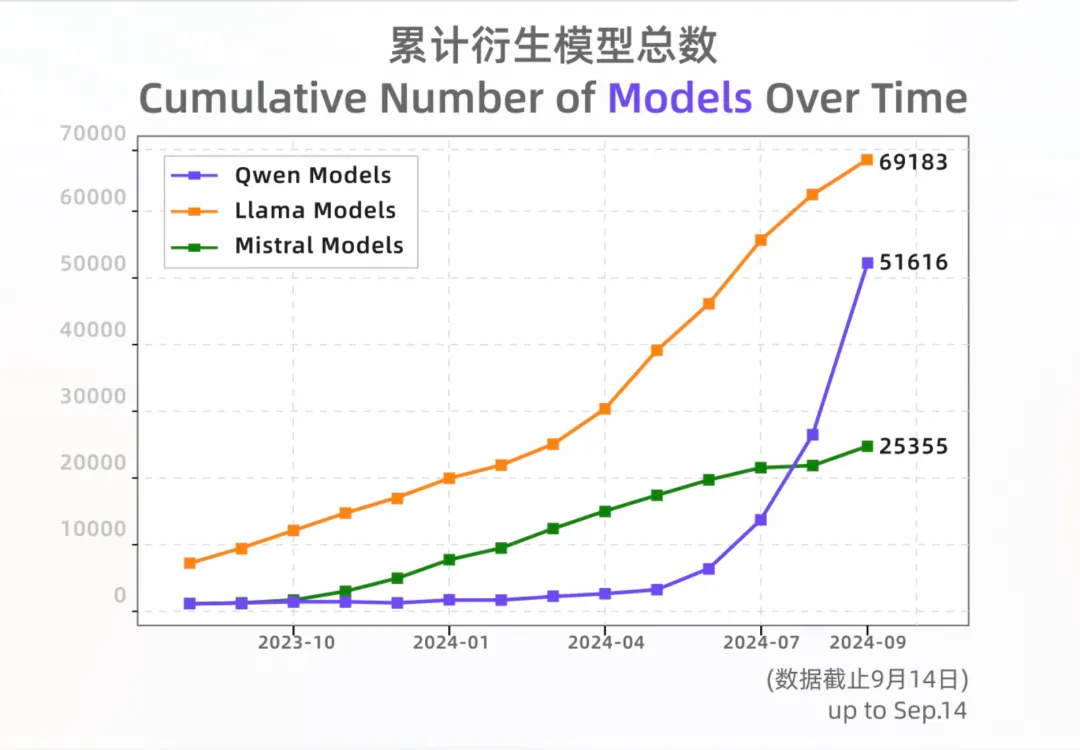

据AI科技评论了解,根据 Hugging Face 的数据,Qwen 系列血缘模型已经高达 5 万多个,也就是说,全世界的开发者,基于 Qwen 系列底座,已经二次训练出 5 万多个衍生模型,仅次于 Llama 系列的 7 万左右。这个数据,是判断一个模型生态影响力最有说服力的指标。

金沙江创投主管合伙人朱啸虎就曾在多个场合表示,国内开源模型已经不比闭源模型差,尤其是阿里的通义千问,很多创业公司都拿通义开源模型来训练自己的垂直模型。

据 AI 科技评论了解,Qwen 系列的衍生模型中,不乏出自面壁等明星大模型公司的微调模型,根据 GitHub 的介绍,面壁的 MiniCPM-V2.6 多模态模型就是基于 SigLip-400M 和 Qwen2-7B 作为基座。

在今天于杭州举办的 2024 云栖大会上,通义大模型再推全新开源系列 Qwen2.5,旗舰模型又秀出了屠榜式的强劲性能。在这之前,海内外开发者和开源社区早已跃跃欲试、反复催更。

如此场景,距离通义去年首次开源不过一年多。通义是怎么做到的?

(Qwen2.5开源后,国内外开发者的反应)

Qwen2.5 全球开源第一

2023 年 3 月15 日,OpenAI 发布了里程碑模型 GPT-4,同时智谱AI开源了ChatGLM模型,自此拉开了中国大模型开源序幕,紧跟着 6 月百川智能开源了Baichuan,8 月通义千问宣布开源,“百模大战”进入白热化……23 年整个行业经历了一场开源盛宴。

阿里通义千问开源相对晚,但胜在后劲足。23 年 12 月,通义千问第一款开源旗舰模型 Qwen-72B 问世,成为当时性能最强的开源模型,一举超越了开源标杆 llama 2-70B,在此之前,中国大模型市场还没有出现一个足以对抗 llama 2-70B 的开源模型。

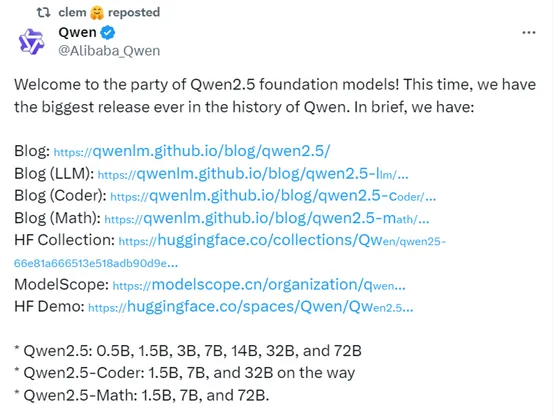

自此,通义千问在“全尺寸、全模态”开源路上狂飙。2024 年 2 月开源 Qwen1.5 系列、2024 年 6 月开源 Qwen2 系列,三个月之后的今天又火速放出 Qwen2.5 系列,开源模型横贯大语言、多模态、数学、代码多个类别、模型尺寸包含 0.5B 到 110B 的完整谱系。几乎可以说,只要开发者想要,Qwen 都能提供。

这种开源力度在国产模型中前所未有,阿里通义千问在大模型赛道的开源「人设」逐渐稳固,吸引了大波拥趸。

今天云栖大会发布的全新开源系列 Qwen2.5,模型性能一如既往火力全开。

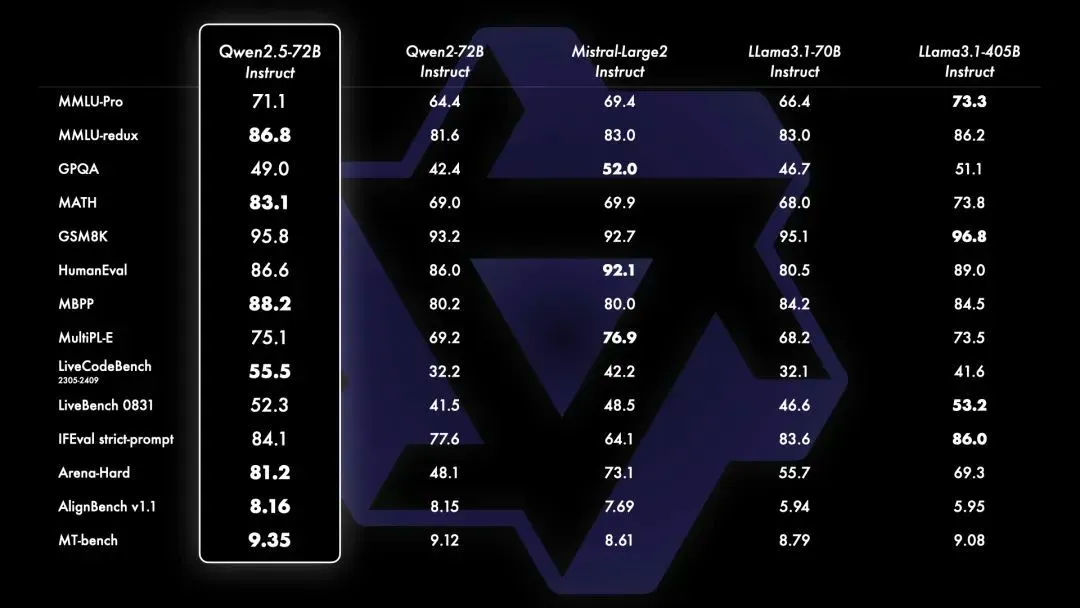

Qwen2.5 有两大特点,一是性能全球领先,稳居全球开源第一。根据阿里官方数据显示,开源旗舰模型 Qwen2.5-72B 在多个权威测评集中全面超越同尺寸开源模型,甚至“跨数量级”超越 Llama3.1-405B 模型,以不到 1/5 的参数规模,创下超越 Llama 4050 亿参数的整体表现。

根据上图,Qwen2.5-72B 在14 个关键基准测试中,8 项击败了 llama3.1-405B 指微调模型,11 项击败了Mistral最新开源的 Large-V2 指令微调模型,成为目前最强开源模型。

今年 7 月 Meta 发布了最新开源模型 llama3.1-405B 后,llama3.1-405B 便一举成为地表最强开源模型,甚至代表开源模型首次超越闭源模型。从基准测试结果来看,超大杯 Llama 3.1 405B 全方位碾压了 GPT-3.5 Turbo、大部分基准测试得分超过了 GPT-4 0125,面对 OpenAI 此前最强闭源大模型 GPT-4o 和第一梯队的 Claude 3.5 Sonnet,Llama 3.1 405B 依然有能力一战。

只是,405B 虽然强大,但模型参数实在太大、部署使用的硬件要求高出天际。对个人开发者和预算有限的中小企业来说,可望不可及。

Qwen2.5-72B 对 llama3.1-405B 的超越,不仅是国产开源模型与美国最强开源模型的一次硬刚,也狠狠削平了“天花板性能”模型的使用成本。

Qwen2.5 的第二个特点,开源模型数量史无前例,目的是为充分适配开发者和中小企业的需求。

Qwen2.5 延续了“全尺寸、多模态”路线,同步开源了多个尺寸的大语言模型、多模态模型、数学模型和代码模型,涵盖基础版本、指令跟随版本、量化版本,总计上架超过 100 个开源模型,刷新业界新纪录。

大语言模型共有 0.5B、1.5B、3B、7B、14B、32B、72B 七个尺寸,在等规模赛道全都创造了业界 SOTA,从这几个型号尺寸,我们可以看到通义团队应该是充分考虑了下游应用的不同场景需求、从而做出上述开源策略,大致对应了当下最火的三个场景:端侧模型、小模型、大模型。

比如,3B 是适配手机等端侧设备的黄金尺寸,业界认为 3B-4B 这个大小,意味着模型量化之后可以做到 2G 的体积,非常适合放在手机里面。端侧则也一直是英伟达、微软和各类手机厂商都非常看重的领域。

32B 是最受开发者期待的“性价比之王”,可在性能和功耗之间获得最佳平衡。最让开发者惊喜的,则是 140 亿和 320 亿两种参数模型的重新回归,14B 和 32B 是最适合本地单卡部署的模型大小。上一代 Qwen2 系列没有这两个尺寸,一直是开发者心中遗憾。

这还没结束,下一个类别是多模态模型。上个月通义团队开源了 2B 和 7B 版本的视觉理解模型Qwen2-VL,这次直接把720亿参数的Qwen2-VL-72B 也开源了,Qwen2-VL 能识别不同分辨率和长宽比的图片,能够理解 20 分钟以上长视频,还具备自主操作手机和机器人的视觉智能体能力。

Qwen2-VL 基于 Qwen2 打造,在多个视觉理解基准测试中取得了全球领先的表现,其中包括但不限于考察数学推理能力的 MathVista、考察文档图像理解能力的 DocVQA、考察真实世界空间理解能力的 RealWorldQA、考察多语言理解能力的 MTVQA。

通义千问从 6 个方面来评估 Qwen2-VL 分别在 72B、7B、2B 三种规模上的视觉能力,包括复杂的大学水平问题解决、数学能力、文档和表格的理解、多语言文本图像的理解、通用场景问答、视频理解、视觉智能代理(Visual AI Agent)能力。

整体来看,Qwen2-VL-72B 在大部分指标上都达到了最优,甚至超过了 GPT-4o 和 Claude 3.5 Sonnet 等闭源模型。

最后是主攻数学和代码赛道的两组专项模型,数学开源模型 Qwen2.5-Math 包含 1.5B、7B、72B,全部支持中文。Qwen2.5-Math 在精心设计的数学语料库上进行了预训练,可以处理大学和竞赛级别的数学问题。

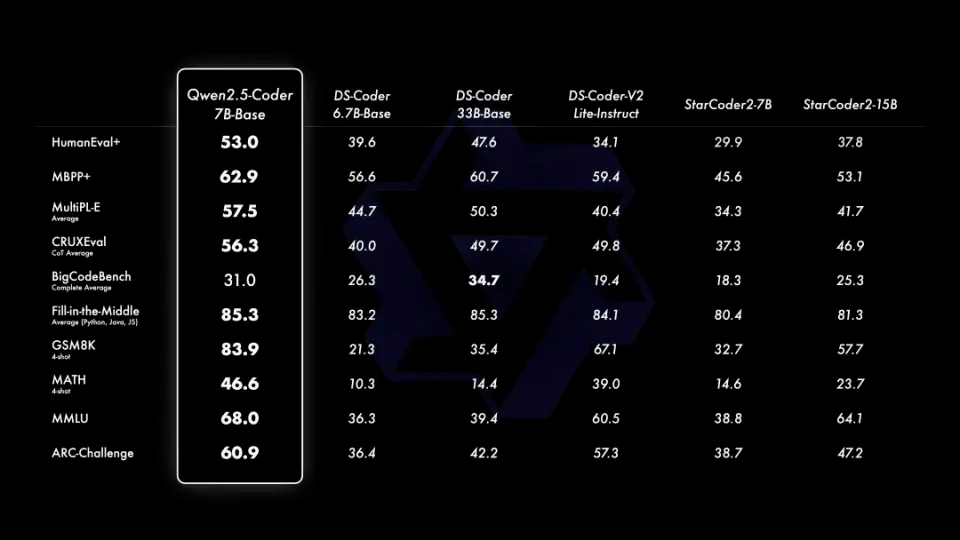

代码开源模型 Qwen2.5-Coder 是为编程特别设计的模型,包含 1.5B、7B 两个版本,通义团队还预告了 Qwen2.5-Coder -32B 也在开源的路上。这组模型最多支持 128K tokens 上下文,支持 92 种编程语言, 7B 版本打败了更大尺寸的 DeepSeek-Coder-V2-Lite 和 Codestral-20B,成为当前最强大的基础代码模型之一。

与此同时,一直免费对外提供服务的通义千问旗舰模型 Qwen-Max 也实现了全面升级,整体性能比前代有明显提升。通义千问官网和通义 APP 的后台模型均已切换为 Qwen-Max,继续免费为所有用户提供服务。

模型、生态两手抓

自 2023 年 8 月开源以来,通义千问不断在基座模型上发力,并将所有模型能力全部开放出来供业界使用。这背后是阿里云在 AI 大模型时代的开源开放策略在支撑。开源能够推动大模型的研发和应用,最终,作为AI基础设施的云计算厂商将是整个行业算力需求的最重要承接方。

路径纯粹、目标清晰,轻装上阵、方得致远。

不过,开源概念虽然美好,行动却毫无捷径可言。在所有模型都免费可用、所有用户都来去自如的开源社区,开发者的选择太多了。模型好,开发者会驻足,模型不行,开发者可以毫不犹豫选用别家。

通义团队总结了他们的开源经验,道理之朴素,几乎没有任何惊喜:性能上日拱一卒,不断训练和迭代模型,不断提升数据处理、模型训练方面的技能,始终跑在模型技术第一线。生态上从零起步、开疆拓土,与海内外的开源社区、生态伙伴、开发者共建生态网络,融入基模核心竞技场。

生态建设方面,通义团队做了几方面的“细活”:

一,努力实现生态兼容。自 Qwen1.5 发布以来,通义团队就与 Hugging Face 合作,把模型代码合并到HuggingFace transformers代码库,方便开发者直接使用 transformers 原生代码;通义团队还积极沟通生态伙伴,获得各类开源框架、开源工具对 Qwen 系列的兼容和支持,包括vLLM、SGLang、AutoAWQ、AutoGPTQ、Axolotl、LLaMA-Factory、llama.cpp、 Ollama 、LMStudio 等等。

二,做好开发者服务。模型开源并不是把模型放到社区就行,Qwen 团队注重从细节处提升开发者体验。准备模型文档(model card)时,除了主流的英文文档,还会准备中文甚至其他语种的文档;优化文档质量,让开发者一眼读懂模型的亮点、效果、demo;准备代码片段,帮助开发者快速部署和使用模型。Qwen 团队还非常重视与开发者的互动,积极处理开发者提交的问题和建议。

三、积极吸纳研究界和开源社区的创意。比如为了回应开发者对 14B 和 32B 模型的需求,本次 Qwen2.5 增加了 14B、32B 尺寸的开源模型。

今天我们可以看到通义大模型在开源届已经成功跻身一流之列,比肩国际最强开源模型 Llama,多次登顶 Hugging Face 全球大模型榜单。

通义千问开源模型 Qwen 的衍生模型数量已经超过 5 万,仅次于 Llama,数据来自全球最大的开源社区 Hugging Face

两个数据最能体现通义作为中国开源大模型的影响力,一是模型下载量,根据通义官方数据,截至 2024 年 9 月初,通义千问开源模型累计下载量已经突破 4000 万,这是开发者和中小企业用脚投票的结果;二是衍生模型数量,截至 9 月初,通义原生模型和衍生模型总数超过 5 万个,成为仅次于 Llama 的世界级模型群。

除了开源模型,通义也提供 API 服务。据官方透露,通过阿里云,通义大模型已经服务了30多万客户,他们涉及千行百业。尽管消费者市场的超级大模型应用还未出现,但在很多垂直领域,大模型正在人们看不见的地方,逐渐生根发芽。阿里巴巴最新季度业绩报告显示,阿里云的 AI 相关产品收入实现三位数增长。

后记

从去年百模大战中的普通一员,到如今拥有“万模同源”的模型族群,通义大模型的开源之路,也是中国大模型追赶世界一线水平的缩影。

回顾世界技术史,在每一次技术浪潮中,开源对一项新技术的推动和创新早已经过多次验证,开源的价值和意义毋庸置疑,站在大模型技术发展的角度可以说,在过去一年里通义大模型极大地推动了中国大模型的生态繁荣。

扫码关注公众号

获取更多技术资讯