季度AI观察1Q24:贪吃蛇与俄罗斯方块

杨冰心 • 2024-03-06 18:14

4211

本文由 共识粉碎机 撰写/授权提供,转载请注明原出处。

共识粉碎机从本季度开始推出新的季度文章系列《季度 AI 观察》,期望通过与行业内最前沿的一线创始人/从业者们交流了解每个阶段大家的所思所想。

本次作为观察者参与了 Whatif 组织的 AI Panel。WhatIf 季度研究线下会,是一个投研组织,季度会主要参与者为 AI 公司创始人、工程师、科学家和行业组织等。本期通过为期 3 小时的脑暴交流,感受到了 AI 行业第一年的变化。

1 贪吃蛇与俄罗斯方块

在《大模型未来三年的十个假设》中,我们提到了一个有趣的现象“为什么 LLM 第一年没有颠覆大玩家?”。

成熟的大公司在 LLM 元年,没有一家被弯道超车。

听完这次 Panel,如果用一句话总结:“AI 在现在更像 Consolidation,而不是 Disruption。”

Panel 中提出了一个有意思的观点,LLM 时代的大公司就像贪吃蛇:

全世界最大的公司们就像贪吃蛇,一直在尝试,尝试在哪个领域可以应用LLM。

在思考怎么在自己的生态里,用 LLM 去聚拢更多的人才:可能是公有云代表的软件生态,可能是内容代表的创意生态,也可能是端侧代表的供应链生态。

每家公司都在努力认领一个超级入口作为 LLM 时代的船票。

他们是 LLM 这场马拉松开始时候的种子选手,也大概率可能是决赛圈选手。

贪吃蛇们也正像我们熟知的游戏里一样,非常有规划的吸纳所有力量:

人才密度高的公司有引力,微软就投资 OpenAI,AWS 与 GCP 也打响了一次 Anthropic 争夺战,而在先前 Google 是上一家明星企业 DeepMind 的收购方。

围绕 AI 的收购争夺战在2023年也越来越激烈,MoSaicML、Neeva、G2K、OmniML 等一批最优秀的 LLM 企业都成为了被争抢的对象。

在过去的技术浪潮里,大公司们往往先尝试自有团队来试,但在 LLM 时代所有人都把时间和资本视为最宝贵的资源,收购甚至比自己来试走的更前。

而相比贪吃蛇们,剩下的 LLM 创业公司则更像再玩一场俄罗斯方块游戏:

要去找巨头们觉得很重要,但是现在还不能做的领域。

要么是巨头不想做的领域,要么是巨头因为架构和方向不能做的领域。

不断地在夹缝中寻找生存点和创新创业的方向。就像是寻找单点突破的方向,找到能嵌合进去的突破口。

在任何一个时代创业公司都像俄罗斯方块,但 AI 时代的难度看起来更大:

PC 软件时代,互联网时代,移动互联网时代,都是介质不同,所有业务天然有重塑需求,比如社交可以重做一遍,做移动原生的微信。

但 AI 本质是工具加强,不是介质创新,很多业务未必需要重做一遍。因此 AI 时代的俄罗斯方块难度更大。

2 贪吃蛇的存钱罐与触手

这一期的贪吃蛇们非常强劲,有很强的循环造血能力。

就像我们在讨论 LLM 时代最大的贪吃蛇微软时:

微软有着全世界最全的 SaaS 生态,是几乎所有软件公司的对手,这就像他的一对对触手,最有机会赋予先期极大投入的大模型商业价值。

微软躺在几乎所有客户公司的供应商列表里,省去了大量 POC 流程时间,产品出来就能很快用上。

微软总是能激发 1+1>2 的潜力。就像我们在讨论 Copilot 的时候,往往更多看到的 Copilot 作为 Seat 售卖提高生产力。却很容易忽略 Copilot 本身结合企业的 Domain Data 后还可以成为一个知识库产品,按照 Data Consumption 模式商业化可能比 Copilot 本身更具潜力。

Panel 有个有意思的话题:“为什么 Azure OpenAI API 卖得比 OpenAI API 还好”

Enterprise 客户非常看重安全,微软的安全做得最好。

微软已经是供应商了,不需要再走流程了,每家客户都想着越快越好。

初创 AI 客服公司很难卖进去几千人的 CallCenter,但被 CallCenter 大公司收购后很快就进入了很大的 CallCenter 项目。

Stability.ai 正在寻求收购,收购后可能才更容易在竞争激烈的文生图行业找到商业化机会。

“AI 超级个体”、“AI 小公司赚大钱”是最近常见的叙事,但 Pannel 上有一个惊讶的观点 LLM 可能会让大公司们打破壁垒变得更加庞大:

过去的大公司大到一定程度,边际收益就会越来越低。

每一次生产工具的进步,都会使得组织变得越来越大,交通、电话、互联网、移动互联网、云的出现都使得组织突破时间空间变得更大。

AI 也会使得组织有无限膨胀能力,大企业的资本投入效率变得更高,也会让边际收益的天花板再次提高。

3 贪吃蛇也没有秘密

在大模型时代最大的贪吃蛇是 OpenAI+微软的组合。

OpenAI 是大模型时代的登月者,在 OpenAI 登月的过程中,其中的 Knowhow 和技术思想也在不断向外扩散。

GPT4 在硅谷已经几乎没有秘密了:

算法层面上没有问题了,圈子内对各家有什么技术,以及重点研究方向都非常了解。

差别主要在数据和工程上,这里面可能有很多大大小小的卡点,可能中间会碰壁,但方向确定的情况下解决都是时间问题。

都已经摸索出门道,大概估算得出到达 GPT4 需要多少算力、人力和工程量。

硅谷层面没有秘密的时间点肯定比中国时间点要快,但两方信息差也在逐渐缩小。

虽然 OpenAI 代表的先进模型没有秘密,但我们仍然很难想象出下几代模型的含义:

到底什么样的才算 GPT5,是 Qstar、原生多模态、理解物理世界?

还有什么方向是最重要的,哪一个方向能够让模型更加智能?

相比先前的工程问题,这些更像是研究问题,OpenAI 的人才密度带来了充沛的想象力,以及算力资源带来了充沛的试错机会。

Scaling Law 大家坚信会走很久,但 OpenAI 在研发上敢于探索很多我们不敢想象的方向,差距不一定会缩小。

4 中国的方块与美国的方块

不同的土壤让创业者也出现了不同的方向。

移动互联网时代为中国培养了一批优秀的产品经理,产品经理定义需求和场景。

云计算时代为美国培养了一批优质的软件客户和擅长找到 PMF 的软件从业者,他们的入手点多从生产力提效开始。

美国有非常多 Niche 的小 AI 应用公司:

最早的 AI 应用网红公司 Harvey 和 Jasper,都来自于 Nitch 的商业场景。

除了这些场景,还有更小的场景一出现就能立刻拿到标杆客户,靠创始人的朋友圈资源就能快速商业化。

例如 Adobe CTO 出来做的 MarTech AI 公司 Typeface。

还有像比 Jasper 更加细分的 2B Jasper Writer,仅做 B2B 领域的文本生成服务,在没拿到融资前就已经有十几个客户。

但与美国不同,中国的AI企业一开始就面临困难模式:

美国很多小的垂直场景都能赚到钱,客户的付费意愿很好,愿意为 ROI 买单,最近四年剧烈的通货膨胀也让客户更加意识到提效的重要性。LLM 在这个时代也首先被定义成生产力提效工具。

但在中国截然相反,在中国将目标放在小事情上非常非常难赚到钱,必须要做大事情,或者可以从小事情开始,但必须有很大很大的梦想。

这也使得 AI 应用的方向与美国有很大的区别:

中国创业者非常看重 2C 场景,有跑出来迹象的像教育、陪伴、儿童相关,2C 场景有机会做很大

移动互联网形态也为中国培养了非常不错的产品经理,带着产品经理眼光寻找需求、创造需求。

除了 2C 场景外,Go Global 成为了 AI 创业者的必选途径。在 Pannel 上有一位创业者也提到他未来上线的几款产品都会先选择美国试水。对于 LLM 这样边际成本极高的创业,购买力对起步也非常重要。

Go Global 对 2C 创业者很重要,对 2B 创业者可能更加重要,相当多的场景可能只有 Go Global 才能成立。

5 模型公司的下一步

“OpenAI 做的是登月工程。跟着 OpenAI 后面走,会忘了还有开源社区,还有产品和客户需求。”

在与模型公司和创业公司的对话中,我发现模型的 SOTA 不是最重要的:

满足具体的应用场景和客户需求,对于使用效果更重要。

一位创业者在谈到做一款涂鸦产品的时候,在选择 Image Captioning 模型时,排名 Top2 的模型做出来不是最好的,反而第五、第六的模型做出来最符合他们的场景。

一位从业者在谈到做一款医疗产品的时候,第一版结合医疗数据的模型是效果最好的,后面学习了更多通用数据后,模型的幻觉比例反而提高了。

这也使得中国的模型公司更多开始考虑场景与需求的意义,理性看待自己定位:可能难以和OpenAI 登月人的角色,但可以做出最适合客户的模型。

Panel 中我还发现模型公司开始尝试做自己的应用产品:

要有做超级应用的能力,要能用自己的模型做应用。

进入应用层后,对模型的看法会比之前做模型有非常大的变化。

模型能力和用户需求不是天然一对一关系,会有非常大的GAP。

6 应用公司的下一步

为什么现在还没有看到令人兴奋的国内 AI 应用?在每一场讨论会中,都是最大的焦点。

我在这次 Panel 中听到了一线创业者的反思与尝试。

一位创业者反思了过去做语言模型中出现的问题:

现有模型的文本输出能力和智能能力都还没超过人类,所以在娱乐场景上非常难超出用户预期,但是娱乐场景只会选择 99 分的产品。

如果无法靠模型做到 99 分,就需要在模型外构建非常复杂的系统,这需要耗费大量的时间。

所以他将创业方向更多的转向图像和海外。

也看到了生产力提效创业者爱设计/AI PPT 赵充的初步成功:

22 年开始做在线 PPT 编辑器,然后很快就看到了 SD 上线。

爱设计团队在 PPT 编辑器基础上加了一层AI,迅速看到了ARPU提高。

相比全球巨头 Office 和国内巨头 WPS,爱设计找到了自己的方块路线,面向最大众的普通人群,他们不会是专业服务从业者,更像是帮助小孩写家庭作业的家长。

面向普通人群,AI 的能力也从 Office 专注的执行细节、公式,变成了美化、模版,以及面向企业端的 AI 定制模版。

一款优秀的 AI 产品,在专注 AI 的同时,可能不需要将 AI 挂在嘴边:

以市面上一款优秀的 AI 相机产品为例,其从没有提过 AI 概念,更多的是产品呈现和满足客户需求。

但用户会自然而然地想到,这样的 AI 效果就是我要的效果。

在未来不止是相机产品,短视频产品也会很快融入 AI。

相比 23 年看到的很多 Model as Product 产品,找场景的意义远大于秀肌肉:

23 年见到了太多因为要展示模型能力而做出来的产品,他们面向的不是客户需求。

模型在应用中的比重会逐渐降低,从一个单一大模型,到引入大模型+多个小模型,再到引入 RAG,单一模型的重要性在降低的同时,系统匹配的要求逐渐提高。

这也使得应用更像应用,不像模型。

有一位希望打造 AI 原生应用的创业者提到了一个问题:

现在的大模型都是基于公域可得数据,基于互联网。

但还有非常多的数据没有被压缩进大模型。同时,AI 原生应用也会生成更多的数据,并圈在自己的应用生态里。

AI 原生应用从解决小问题的小智慧慢慢长大,以后可能变成大产品。

那内生数据,能不能长出来新的智慧?

在这次 Panel 中,我听到了非常多的点子。

诚然说还没有听到一个非常大场景,非常令人震撼的创业方向。

但就像前面说的,中国的 AI 应用创业者,就算从小事情起步,也都在想属于自己的大事情。

7 教育领域是国内最大的方块

在这次 Panel 上提到的最多应用想法是教育。

教育作为一个天然的存量大市场同时兼具 2C+AI 属性,并且已经在很多领域看到了 AI 尝试。

首先看到了录播课、作业批改等形式正在被 AI 改造:

新时代的录播课产品,可能是 K12+多邻国形式。

看视频的时候可以随时点 AI Tutor,回答学员的问题。有了 LLM 后,AI Tutor 很容易结合正在观看的视频内容,定位到理解学员的问题。而且比人类老师更有耐心,更会夸奖。

作业批改的产品也很快,OpenAI 就刚投资了一家 2B 教育公司,批改偏文科的作业。

而中国教育公司在进入全球 AI 市场时候也有自己独特的优势:

中国教育公司涉足的领域特别多,了解如何协调产品、品牌、运营,带来的整体优势。

教育的链条又特别长,老师、内容、交付、获客、品牌、服务、续费,这么长的链条只有中国教育互联网公司走过的。

中国教育公司也在 LLM 上投入了大量的数据,并且有丰富的 Domain 数据可供训练。

除了教育产品,与会还有创业者正在探讨应用 LLM 做学生的知识储备测评,阅读能力测评,进而可能帮助到书本等内容定级、内容匹配。

8 Sora 如何改变世界

OpenAI 对这个时代最大的贡献是领路人,通过最多的人才、钱和资源将 AGI 的方向指出来。

如果说当 GPT4 刚出来的时候,因为没有足够的公开信息,大模型追赶者们可能还不确定能否复现。但当 Sora 出来后,第一反应已经是可以复现,更多是资源和工程问题。

Sora 复现的方向和难点:

技术上最直观的变化是应用 Transformer 代替 U-net,再通过时间自编码器(OpenAI 自主训练)把视频拆分成不同的 Patch。

难点一是调节压缩率,场景需求不同,需要不同的策略,Sora 用很多训练数据学习特定视频的表示方式,在压缩之后仍然能保留关键信息。

难点二是语义理解,Sora 的诞生也依靠 OpenAi 自身的语言模型。

难点三是数据量,Sora 所用到的训练数据可能比其他文生视频模型大两个数量级,这里面也用到了大量的 Synthetic Data。

难点四是数据标签的方式,Sora 用于打标签的模型本身优于市面上的其他模型,也会直接影响追赶者复现的进度和质量。

难点五是用卡,现在估算下来卡的用量在小几千级-大几千级,在海外可能比较充沛,但在国内仍然是非常珍贵的资源。

难点六是怎么控制参数和生成成本,短期更可能会选择做一个参数更大的模型来尽可能保证效果。

到复现节点来看,克服以上难点并且成功复现可能需要 6-8 月时间,但 OpenAI 快速迭代的能力也非常强,可能届时已经有 Sora 2 出现。同时尽快开放给 2C 用户,也会收集更多的用户反馈。

Sora 也同时带来了模型公司排期的变化,过去都会优先训练大模型,或者先做 LLM 再做多模态。但现在更可能同时做,同样重要。

训练 LLM 模型需要基于 Scaling Law,效果提升遵循对数指标,边际提高越来越困难。但在多模态的早期更像是直接取得线性效果,提升更加明显。

Sora 的出现也可能对内容生态有很大冲击:

文生图到现在还没有对社会产生巨大影响,因为图片不是社会消费的最主流内容形态,但视频的消费重要性远远高于图片。

内容的生产供给速度会迅速提高,这可能会改变现有的 MCN 内容生态。

甚至在产品趋势上,会出现生成代替推荐,生成代替搜索的趋势。

字节可能是全世界最重视文生视频的公司,张楠负责剪映业务,蒋路加入字节,剪映未来可能会改变生成视频的方式,这对 Adobe 代表的专业视频制作工具也会有长期影响。

9 我们在 1.0,即将进入 2.0

现在的我们更像是站在 LLM 时代的 1.0 阶段,1.0 阶段反馈在算力芯片和模型自身。这次的 Panel 也更多是在探索和讨论 1.0 阶段国内外最前沿 AI 从业者的思考与见闻。

进入 2.0 阶段,将是以应用为代表的叙事。

在这次 Panel 中,OpenAI 的前研究员,现 Leonis Capital 的合伙人 Jenny Xiao 也分享了自己的看法:

2023 年的应用生态仍然面临很多技术难点,包括 Dataset 准备、熟悉向量数据库/RAG 工具用法、Finetune 模型、实时推理、针对场景用户反馈的调整,这也使得搭建一个 Native LLM App比最初想的要困难得多。

同时开发者企业的管理架构也需要适应 LLM 开发流程改变,职能需要精简,需要有更多研究人才,比起像运营一个 App 工厂更像是运营一家研究机构。

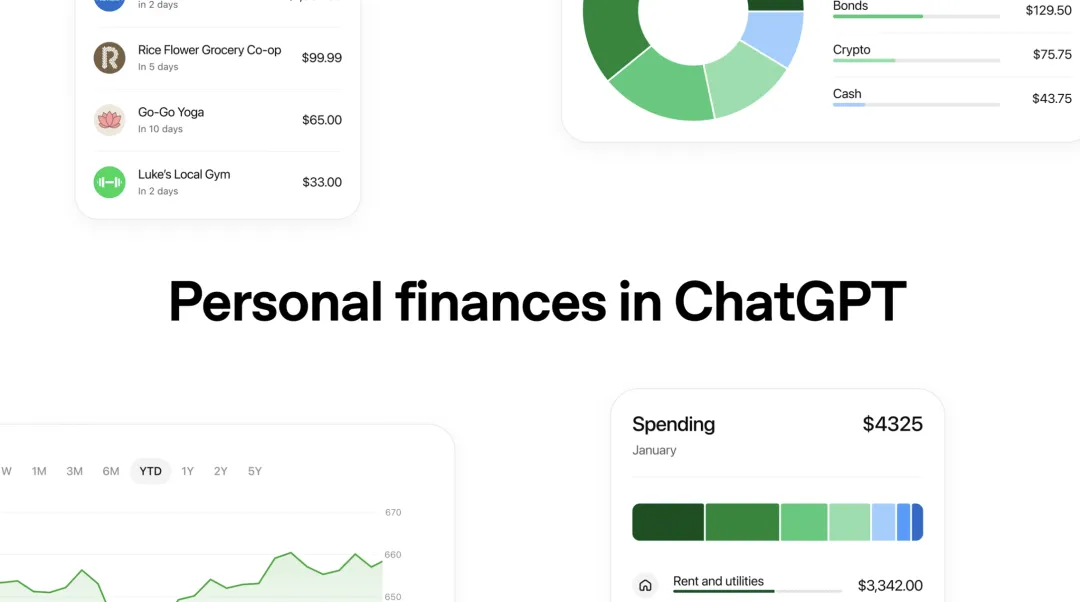

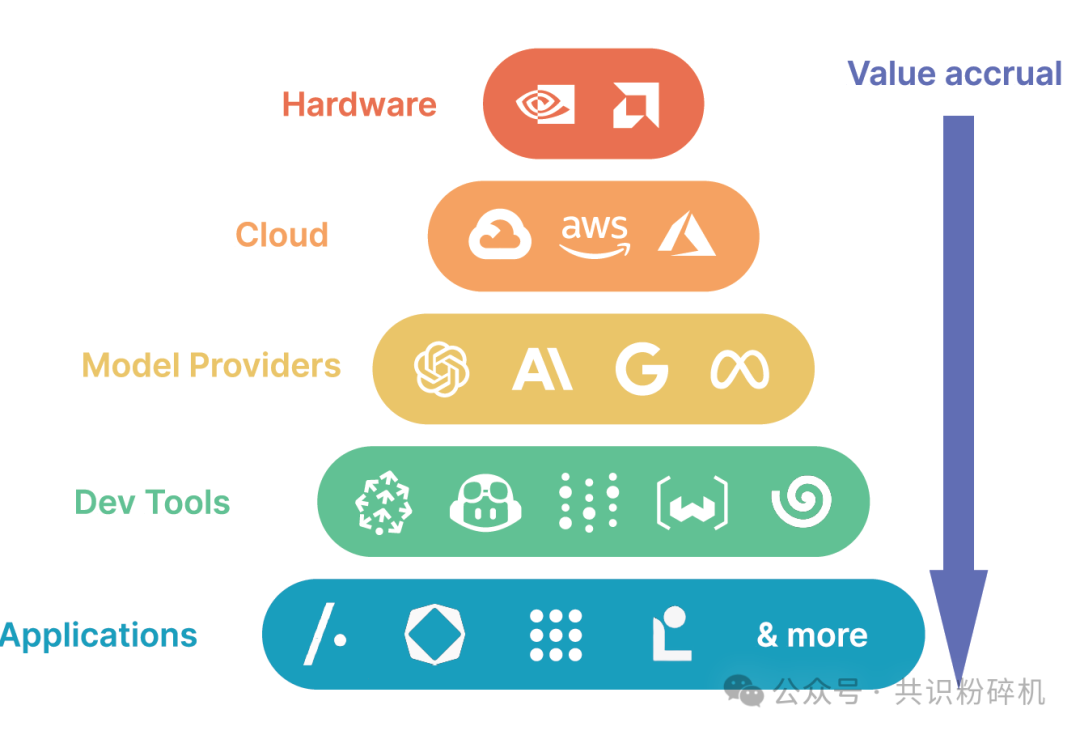

但随着 LLM 开发者生态越来越易用,以及更多先进 LLM 开发者的开发案例成为学习案例,也会看到应用生态的开发加速,我们有机会看到 LLM 的价值像下图一样自上而下拓展。

扫码关注公众号

获取更多技术资讯