AI还没玩明白,反AI工具已经来了

HelloKitty • 2023-09-22 17:14

5599

本文由 头号AI玩家 撰写/授权提供,转载请注明原出处。

文章来源于:头号AI玩家

作者:阿虎

编辑:张洁

快问快答!下面哪一张图是 AI 生成的?

先卖个关子,结尾公布答案。

如今,由 AI 生成的内容逐渐充斥我们的生活,随着 AI 技术的迭代,更是让人感到真假难辨。

今年 6 月,欧盟执法机构 Europol 的一份报告显示,到 2026 年,互联网上约 90% 的内容或由 AI 产生或者编辑。

为了提高内容的透明度和可信度,国内外各平台陆续上线内容创作者声明功能,给 AI 内容打“标签”。

9 月 20 日,短视频平台 TikTok 全面启动平台 AIGC 内容的监管,推出了“标记 AI 生成内容”的新功能。如果创作者未标记涉及的 AI 工具,内容可能会被删除。

9 月 13 日,B 站发布《关于“主动添加内容标识”的公告》称,将在 9 月 20 日上线“创作者声明”功能,允许 UP 主为其视频添加标识,比如人工智能生成、虚构内容等。

9 月8 日,微信发布关于规范“自媒体”创作者内容标注的公告,要求“自媒体”创作者应主动对发布内容进行规范标注。利用深度合成技术生成内容时,要遵守法律法规及平台规则,显著标注内容为技术生成。

图片来源:微信珊瑚安全公众号

更早一些,今年 5 月,抖音、小红书等平台均要求创作者在人工智能生成的内容上显着标注,根据实际情况勾选“内容由 AI 生成”。抖音发布了《关于人工智能生成内容标识的水印与元数据规范》通知,帮助用户区分虚拟内容和真实内容。

各平台对于 AI 生成的内容都需要进行明确的声明,无疑为内容添加了一层水印保护。

那么,为什么我们需要数字水印?AI 水印该如何添加?AI 泛滥的时代,或许最终还是需要科技来提供可行解法。

DeepFake 造假泛滥,难辨真伪

深度伪造(DeepFake)指的是一种基于人工智能合成某个人的长相或声音的技术,名人和公众人物通常是此类造假行为的受害者,比如此前的 AI 孙燕姿以及“时尚教皇”。

教皇穿着巴黎世家风格羽绒服,走在街道上;AI生成的虚假图像

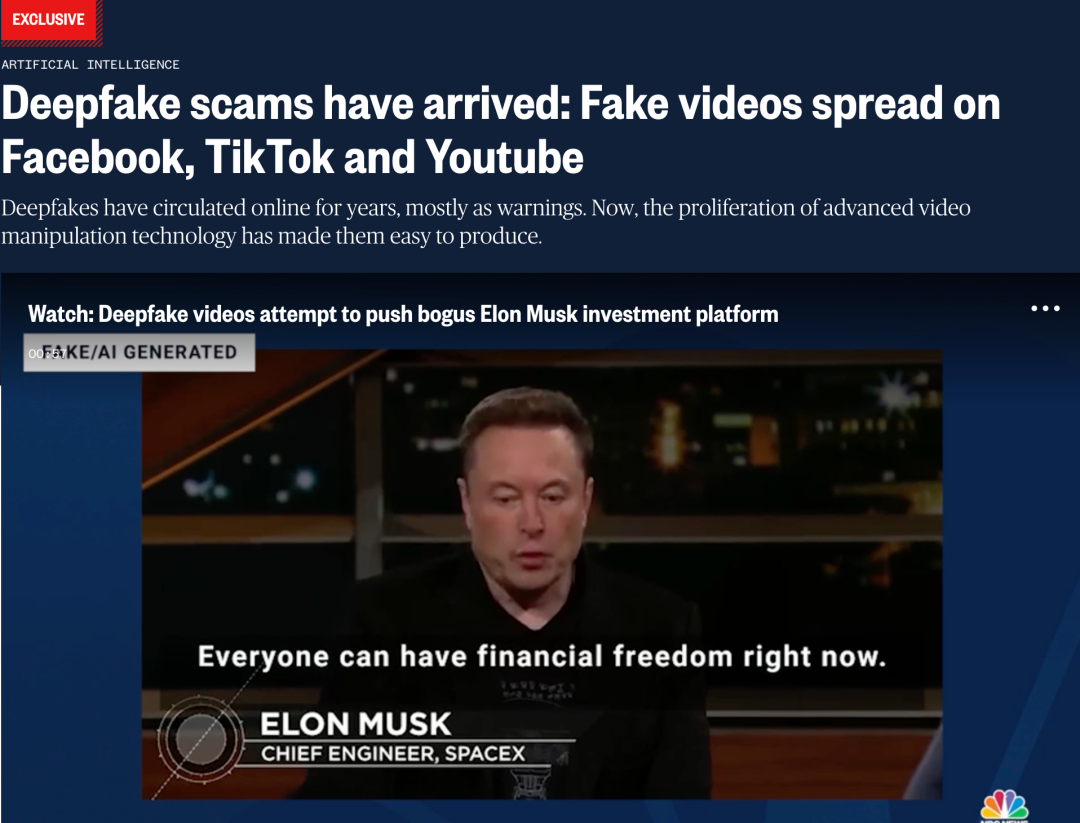

最近,一系列利用深度伪造技术制作的虚假视频在 TikTok、YouTube 等主流社交媒体平台上引起关注。

这些虚假视频往往由大众熟悉的人物合成,例如全球首富马斯克在视频中推荐自己看好的投资机会,让人难以判断其真实性。

AI 不光被用来恶搞名人明星,娱乐大众,也被拿来捏造国际新闻大事,撼动股价。

5 月底,一张五角大楼着火的照片在社交平台上疯传,这张图片一度导致标普 500 指数明显走低,由涨转跌。最后,有媒体报道称该图片是由人工智能生成的。

而在互联网时代,几乎每个人都可能成为 AI 的受害者。(相关阅读《你的自拍照可能被收入“不雅图素材库”,AI 作恶其实离你很近!》)

某知名 AI 文生图的网站平台允许用户进行高度自定义创作模型,生成多种风格的图像,当然也包括生成一些擦边向的内容。

这些模型大多数情况下都未经当事人的同意,在互联网上擅自抓取照片,进行模型训练,生成特定风格、甚至软色情的人物图片,以博取下载量和关注。

今年 7 月,德国广告代理商 DDB 发布了一则关于社交平台儿童数据安全的公益广告,向人们展示儿童面部数据有多大可能会被用于创作成人内容,呼吁家长尽量少在网上分享儿童照片。

在早期,识别深度伪造技术并不具有挑战性,因为它们大多数都存在着明显的缺陷,例如不自然的面部表情或眼睛不眨眼。但随着时间的推移,深度伪造技术逐渐消除了缺陷,使造假更加接近现实,达到“无中生有”的效果。

除了 AI 生成图像,让人分不清真假之外,在音视频领域的伪造技术则更为泛滥。

比如近日,浙江警方侦破一起造谣牟利案,作案团伙利用 AI 生成 1.8 万余个虚假视频后发布,非法获利 4 万余元。

此前发生了一系列的 AI 诈骗事件,由于诈骗金额过大,速度之快,也引起了不少讨论。安徽有受骗者接到“朋友”在开会的视频,9 秒被骗 245 万;包头有人被换脸和拟声的亲友迷惑,10 分钟内被骗 430 万。

可见,DeepFake 技术已经深入多模态的各个方面,而水印的添加可以在“真假”、“虚实”之间构筑起一道屏障,以防混淆视听。

AI 水印,该怎么加?

无论教皇是否真的变装走在了大街上,还是听到的歌曲并非孙燕姿演唱,我们都需要知道内容是否被 AI 篡改过或者压根由AI生成的。

7 月 27 日,Open AI 团队悄然下线了自己推出的“AI 生成内容识别器”,理由是该识别器对 AI 生成内容的检出成功率仅为 26%,AI 检测工具准确率已经无法满足实际操作中的需求。

在这个背景下,数字水印成为了平台和工具提供方一致认为可行有效的解决方法。

它是一种隐藏在数字内容中的特殊标识信息,用于标识内容的来源和真伪,类似于隐形的“防伪标记”,例如在文章中隐秘添加“由AI生成”的文字样式。

起初,国外创意平台 Shutterstock 最先宣布用 C2PA 协议(类似区块链的加密技术)为 AI 生成内容打上标签,用来区分是否为人类创作。

C2PA 通过数据加密技术给每个像素进行编码,以便之后查看创作源头、历史修改记录等等,让作品可以溯源,降低生成式人工智能导致的“误传内容”。

这便是数字水印最初的表现形式,微软、Adobe、索尼等科技企业都将其集成在了自己旗下的产品中,为 AI 生成内容打上水印标记。

8 月 31 日,谷歌上线了一个名为 Synth ID 的新工具,能够在 AI 生成内容中嵌入肉眼不可见的水印,并且不会影响图像本身的质量和体验。

谷歌 DeepMind CEO Demis Hassabis 表示,SynthID 是为了解决深度伪造潜藏的危机而开发的,同样可以应用在音频、视频、文本等其他形式的 AI 生成内容上。

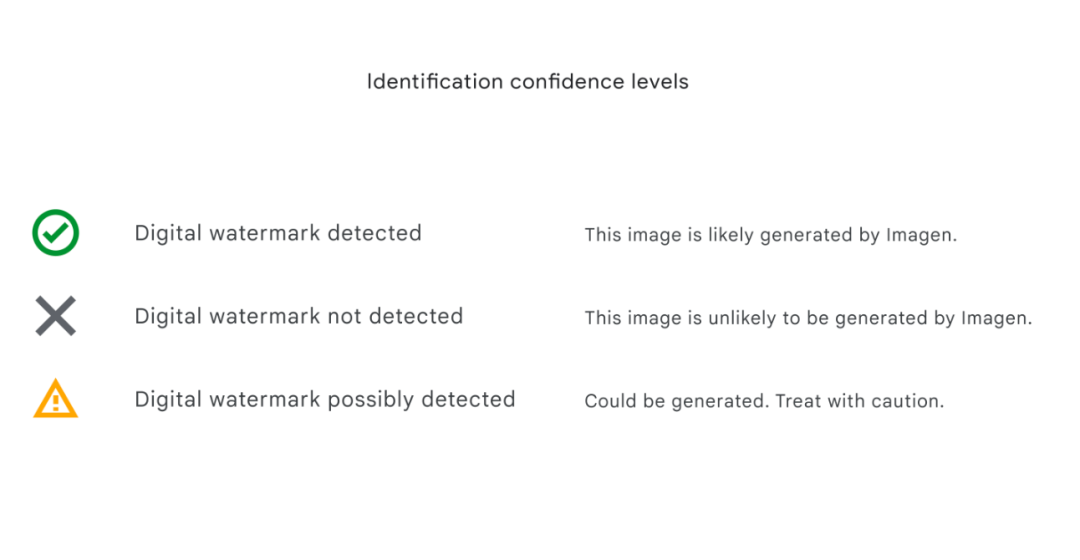

SynthID 目前仅为谷歌文生图工具 Imagen 生成的图片添加水印,并且识别图片是否为该模型生成。

改变亮度、颜色、噪点等信息元素,水印依旧存在

该工具提供了三个程度级别来解释水印识别的结果。如果检测到数字水印,则图像的一部分可能是由谷歌绘图工具 Imagen 生成的。和传统水印不同的是,即使图像被裁剪、编辑、或者旋转,水印依然可以被检测到。

SynthID中水印检测的不同结果

SynthID 不仅能够为图片添加防伪标记,同样也能够识别图片的真假,一定程度上提升 AI 产品的安全性。

同样,8 月 21 日,商汤科技推出可信 AI 基础设施 SenseTrust,上线数字水印技术,并将其服务于旗下的“商汤秒画”等产品中。

具体应用上,用户可在 AIGC 相关产品发布时加入,并且只有通过特定的解码器和专属密钥才能提取,能够支持多模态数据。

不过除了隐蔽的数字水印之外,商汤秒画同样在 AI 生成图片上加入了传统的显性水印。

除了给图像内容添加标记外,有研究团队正在为 AI 生成文字工具开发水印版本。

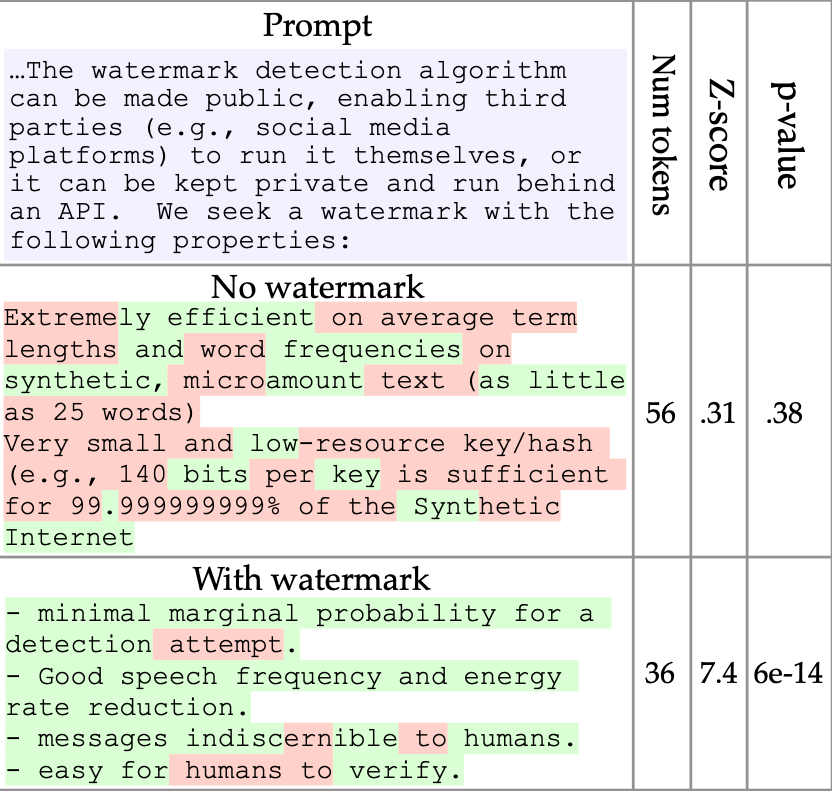

此前,马里兰大学研究人员发表了一篇《A watermark for Large Language Models》的研究论文,详细描述了如何给文本内容加上数字水印。Open AI 系统安全性部门负责人 Jan Leike 在接受采访时曾表示,Open AI 正在探索的水印方法就类似于此种。

图片来源:论文《A watermark for Large Language Models》

这个方法的大概意思是,在生成的句子中增加一些特定单词出现的概率,就可以给句子添加一个“数字水印”,方便检测句子是否由 AI 生成。值得一提的是,这种办法的“水印”只有从一开始嵌入到大语言模型才有效。

比如,研究人员让 ChatGPT 生成句子“今天的天气很好,小明在_____”,为了给它加上水印,需要先随机选择一部分单词,像“公园”、“学校”、“天气”作为系统偏好词表。

有水印的版本是“今天的天气非常好,小明在公园打网球”,而无水印版本可能是“今天的天气很好,小明准备去打网球”。

生成的句子对于普通人来说看起来没有区别,但通过统计句子中出现的偏好词汇的数量,就可以检测出这个句子是否被加上了数字水印。当偏好词汇的数值高于一定比例,水印检测器可以判定文本由 AI 生成。

当然,以上的例子只是根据原理做的简单模拟,实际论文中的系统生成词表更为复杂。

在图像中稍微改变某些像素的颜色来嵌入信息,或是在文字内容中改变个别单词出现的频率来插入信息,都是数字水印的添加方式,并且这样的隐藏水印由 AI 在输出时自行添加,用户难以察觉。

除了平台为 AI 生成内容自动添加水印,来保证生成内容的安全性外,内容创作者还会利用水印来对抗 AI 复制技术的应用。

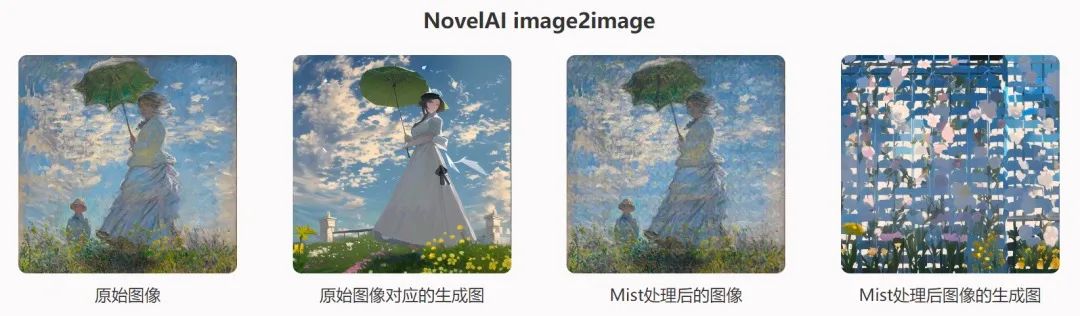

今年 4 月,上海交通大学研究团队上线“Mist”开源工具,通过在图像上放入看不见的“水印”,使图像无法识别,防止 AI 进行学习和模仿。

它能够对图像进行“噪声处理”,使得图像生成工具的算法难以辨认原始图片的特点,从而难以生成与原图风格类似的新图片。

比如,原图是莫奈的《撑伞的女人》,图二是给 AI 喂图后生成的 AI 版本。如果我们对原图加入 Mist 数字水印,那么 AI 处理的图片效果就会如第四张图片一般。这样就能避免创作者作品被拿去随意生成类似图像。

用户也可以根据实际需求对水印进行设置和调整。在设置水印信息时,需要确保信息的唯一性,以确保水印的有效性。

社交平台上有很多创作者表示,“愿意上传图片,不代表愿意将作品献祭给 AI”。

B 站 UP 主“虚幻的生物”分享了开源软件 Glaze,教网友如何防止 AI“白嫖”自己的作品。UP 主“-边火-”投稿了一条“赛博偏方加噪点加水印,是否能躲过 AI 识别”视频,评论区“卷”起了添加 AI 防伪标识的办法。

打标记能防止 AI“滥用”吗

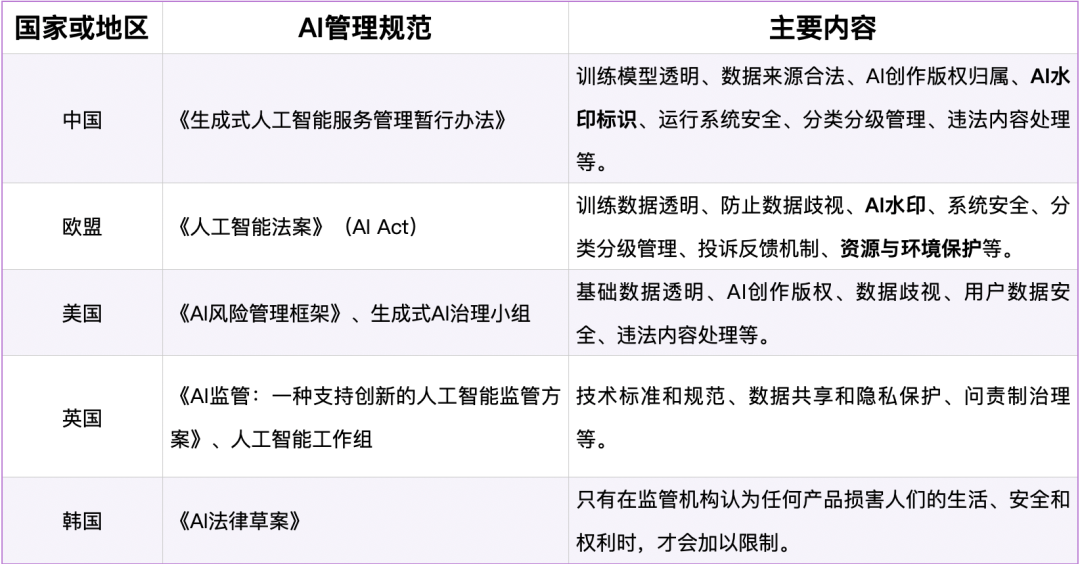

在生成式 AI 带来的挑战下,中国、美国、英国等各国政府都积极推出 AI 管理规范,不过,目前在以下五个国家或地区中,仅欧盟和中国对于生成内容 AI 水印等标识提出了要求。

6 月 14 日,欧盟正式批准通过《人工智能法案》草案,要求 AI 生成的内容应该被标注,旨在提高对 AI 生成内容的透明度。目前,该法案尚未正式生效。

8 月 15 日,我国落地生效的《生成式人工智能服务管理暂行办法》,针对生成内容的准确和可靠性提出了新要求,服务提供者需要采取相应的技术和管理措施,以确保生成的内容符合事实,并且能够提供透明的信息来源。

对于谷歌、Adobe、微软等科技公司和平台来说,AI 生成内容引发的假消息和假新闻的传播,相应平台需要承担起监管不当的责任。

如果一张图片显示有数字水印,那么平台可以相应地打上标记“内容由 AI 生成,谨慎甄别”,以便网友能够更容易地将其识别为虚假内容,一定程度上降低其传播的速度。

另外,对于内容创作者来说,打上数字水印,意味着将内容版权声明为自己所有,防止被 AI 随意拿去训练模型。

无论是创作者声明或是隐形水印标记,都正在树立起一道保护知识版权和内容安全的数字防线。

然而,就像 Open AI CEO Sam Altman 所说,不存在一个完美的 AI 生成辨别工具。目前,这些标记 AI 生成内容的新工具仍处于起步阶段,并未完全面向公众开放。

另一方面,并非所有 AI 生成工具都愿意给自己的内容打上 AI 水印。如何在水印的实施标准上达成共识,对于人工智能领域的企业来说还是个未知数。

不过,这些水印标识至少能够帮助降低虚假信息诞生的风险,实现对内容的溯源和确认版权。

回到最初的两张图,不知道各位猜对了吗?左图是 AI 生成的,右图是真实拍摄的。

扫码关注公众号

获取更多技术资讯