国产类ChatGPT密集开测,单卡能跑大模型,生成式AI热潮爆发

HelloKitty • 2023-03-16 16:30

3249

本文由 智东西 撰写/授权提供,转载请注明原出处。

文章来源于:智东西

作者:ZeR0

编辑:漠影

智东西 3 月 15 日报道,最近几天,大模型和生成式 AI 领域可谓是群英荟萃,进展连连。上周,国内首个可供体验的类 ChatGPT 模型海豚 AI 助手上线(http://zhimachat.com/),邀请公众参与测试。本周又有多项重要进展令人应接不暇。

本周二,由清华技术成果转化的公司智谱 AI 推出了基于千亿基座模型的 ChatGLM,初具问答和对话功能,现已开启邀请制内测,并将逐步扩大内测范围。(内测申请网址:chatglm.cn)

同期,智谱 AI 还开源了 GLM 系列模型的中英双语对话模型 ChatGLM-6B,支持在单张消费级显卡上进行推理使用。

Georgi Gerganov 最近也做了个能在苹果 M1/M2 芯片上跑 Meta 开源大型语言模型 LLaMA 的项目 llama.cpp。此前 Meta 声称 LLaMA-13B 在大多数基准测试中的表现优于 GPT-3(175B)。

斯坦福大学亦于周二发布了一个由 LLaMA 微调的全新开源模型 Alpaca,训练 3 小时,性能媲美 GPT-3.5,而训练成本不到 600 美元。其中在 8 个 80GB A100 上训练了 3 个小时成本不到 100 美元,生成数据使用 OpenAI API 的成本不到 500 美元。

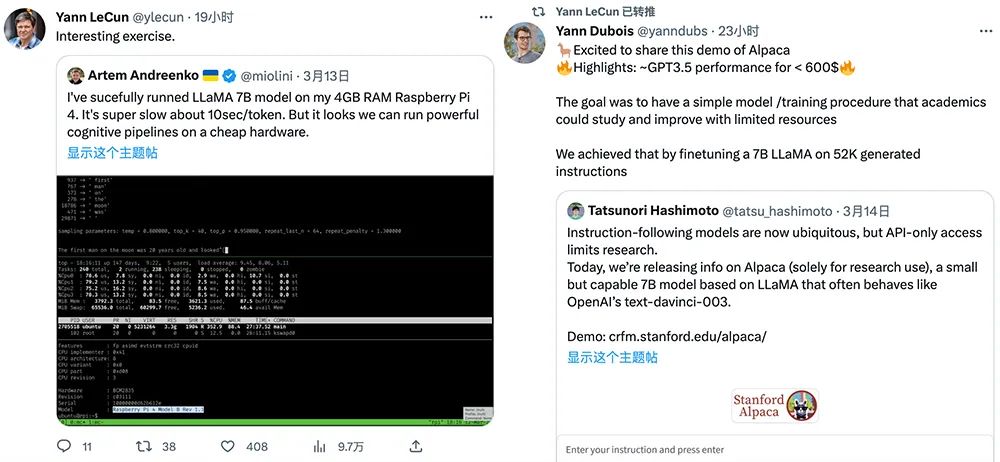

这两个项目都得到了图灵奖得主、深度学习三巨头之一、Meta 首席 AI 科学家杨立昆(Yann LeCun)的转发支持。

同日,谷歌宣布开放大型语言模型 PaLM 的 API,帮助企业“从简单的自然语言提示中生成文本、图像、代码、视频、音频等”。谷歌还推出了一款与 PaLM API 搭配使用的新应用 MakerSuite,用户可以用它迭代提示、使用合成数据扩充数据集、轻松调整自定义模型。

大模型及生成式 AI 的研发与应用,正肉眼可见地热闹起来。

01. 类 ChatGPT 产品海豚AI助手上线公开可体验

上周,海豚团队宣布已成功开发了国内首个可供体验的类 ChatGPT 模型,并将其发布到了公开平台,欢迎公众参与测试。

体验直达:http://zhimachat.com/

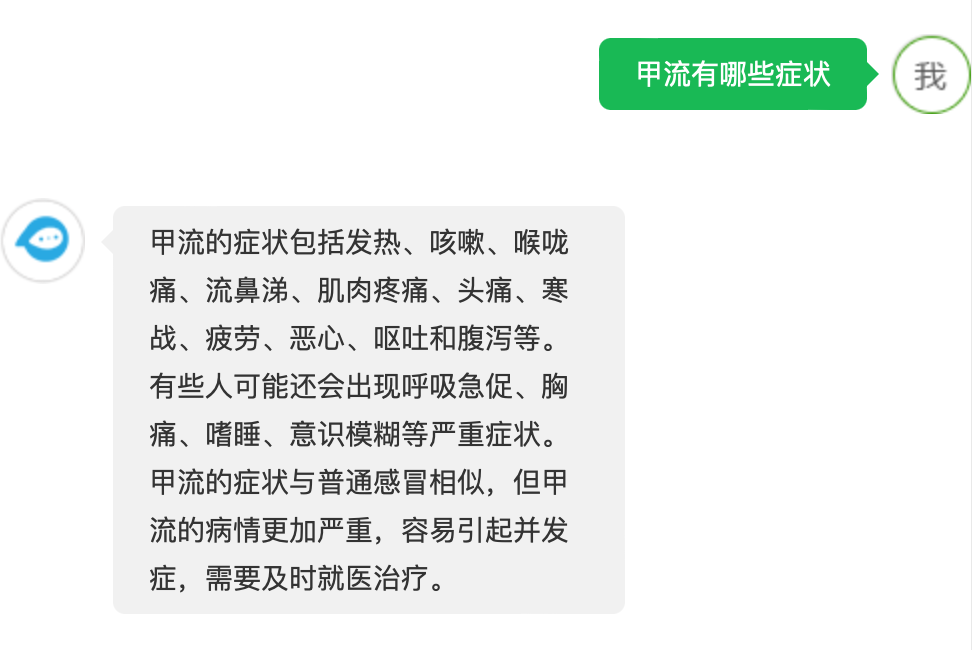

海豚团队介绍道,海豚 AI 助手是一款类似于 ChatGPT 大语言模型的AI产品,具有帮助用户获取知识、高效写作、辅助决策的功能。智东西分别对三项功能进行了体验。

获取知识方面,海豚会根据用户的提问,自动搜索相关文献并提供详细的解释和解答,相比传统搜索引擎更加快捷和准确。海豚还支持对于一些特定领域的深度探索,比如医疗、法律、金融等。比如你可以问它疾病的症状、法律条文的解释、金融产品的分析等等。

高效写作方面,海豚能够自动生成文本,帮助用户撰写作文、论文、邮件、演讲稿等,并能够为用户提供写作建议和优化方案,还可以为用户提供各种写作模板和格式化工具。

辅助决策方面,海豚可以自动为用户提供相关的数据和分析结果,并为用户提供决策建议和优化方案;还可以为用户提供各种决策模型和工具。下图是海豚 AI 助手针对“6 岁小孩怎么学习计算机编程”问题给出的回答。

据介绍,海豚团队拥有自主研发的 NLP 大模型,对话机器人等核心技术,并通过软硬结合的方式,将AI助手融入到“手机”、“机器人”、“车载”、“家居”四大场景中,为用户提供日常生活所需的全方位服务。

其团队成员主要由毕业于清华大学、南京大学、加州大学伯克利分校、香港中文大学等知名高校,以及工作于 IBM、腾讯、华为等国内外IT公司的资深员工组成。

02. 千亿参数对话模型启动内测

多轮聊天流畅,能写稿能编程

由清华大学计算机系技术成果转化而来的公司智谱 AI,现已开启 ChatGLM 线上模型的内测。用户需要使用邀请码进行注册,也可以填写基本信息申请内测。

ChatGLM地址:chatglm.cn

智东西也对 ChatGLM 的多轮对话、内容生成、辅助编程等能力进行体验。

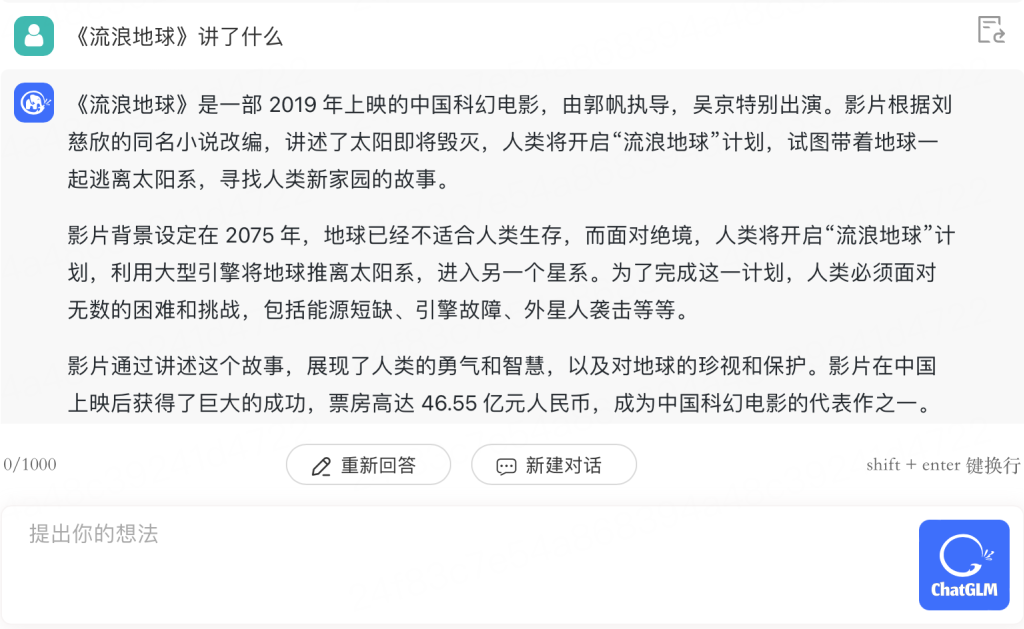

问它《流浪地球》讲了什么,回答基本无误。

在提供建议上,它也是个合格的助手。

让它给 AIGC 创新峰会写个开场白,成文速度飞快,指出错误后能迅速修改。

写一个能在 MacBook 上跑的贪吃蛇游戏程序也不在话下:

ChatGLM 线上模型的能力提升主要来源于独特的千亿基座模型 GLM-130B。它采用了不同于 BERT、GPT-3 以及 T5 的 GLM 架构,是一个包含多目标函数的自回归预训练模型。

智谱 AI 致力于打造新一代认知智能通用模型,提出了 Model as a Service(MaaS)的市场理念,于 2021 年合作研发了双语千亿级超大规模预训练模型 GLM-130B,主导构建了高精度通用知识图谱,把两者有机融合为数据与知识双轮驱动的认知引擎,并基于此千亿基座模型打造 ChatGLM。

GLM 开源地址:https://github.com/THUDM/GLM

2022 年 11 月,斯坦福大学大模型中心对全球 30 个主流大模型进行了全方位的评测,GLM-130B 是亚洲唯一入选的大模型。在与 OpenAI、Google Brain、微软、英伟达、Meta AI 的各大模型对比中,评测报告显示 GLM-130B 在准确性和恶意性指标上与 GPT-3 175B(davinci)接近或持平。

GLM 团队在博客文章中坦言,ChatGLM 距离国际顶尖大模型研究和产品还有一定差距,他们将持续研发并开源更新版本的 ChatGLM 和相关模型。

博客文章:https://chatglm.cn/blog

智谱 AI 也推出了认知大模型平台 Bigmodel.ai,形成 AIGC 产品矩阵,包括高效率代码模型 CodeGeeX、高精度文图生成模型 CogView 等,提供智能 API 服务。

03. 62 亿参数对话模型已开源,支持单卡推理

除了开启 ChatGLM 内测外,智谱 AI 还将支持中英双语问答的对话语言模型 ChatGLM-6B 开源,并针对中文进行了优化。

该模型基于 General Language Model(GLM)架构,具有 62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。

ChatGLM-6B 使用了和 ChatGLM 相同的技术,针对中文问答和对话进行了优化,具备较好的对话与问答能力。以下是其对话效果的一些示例:

开源地址:https://github.com/THUDM/ChatGLM-6B

经过约 1T 标识符的中英双语训练,辅以监督微调、反馈自助、人类反馈强化学习等技术的加持,62 亿参数的 ChatGLM-6B 虽然规模不及千亿模型,但大大降低了推理成本,提升了效率,并且已经能生成相当符合人类偏好的回答。

具体来说,ChatGLM-6B 具备以下特点:

(1)充分的中英双语预训练:在 1:1 比例的中英语料上训练了 1T 的 token 量,兼具双语能力。

(2)优化的模型架构和大小:吸取 GLM-130B 训练经验,修正了二维 RoPE 位置编码实现,使用传统 FFN 结构。62 亿的参数大小,使研究者和个人开发者自己微调和部署 ChatGLM-6B 成为可能。

(3)较低的部署门槛:FP16 半精度下,需要至少 13GB 的显存进行推理,结合模型量化技术,这一需求可以进一步降低到 10GB(INT8)和6GB(INT4),使模型可部署在消费级显卡上。

(4)更长的序列长度:相比 GLM-10B(序列长度1024),序列长度达 2048,支持更长对话和应用。

(5)人类意图对齐训练:使用监督微调、反馈自助、人类反馈强化学习等方式,使模型初具理解人类指令意图的能力。输出格式为 markdown,方便展示。

不过由于 ChatGLM-6B 模型的容量较小,不可避免的存在一些局限和不足,包括:

(1)相对较弱的模型记忆和语言能力:在面对事实性知识任务时,可能会生成不正确的信息,也不太擅长逻辑类问题(如数学、编程)的解答。

(2)可能会产生有害说明或有偏见的内容:ChatGLM-6B 只是一个初步与人类意图对齐的语言模型,可能会生成有害、有偏见的内容。

(3)较弱的多轮对话能力:上下文理解能力还不够充分,在面对长答案生成和多轮对话的场景时,可能会出现上下文丢失和理解错误的情况。

感兴趣的开发者可以下载 ChatGLM-6B,基于它进行研究和(非商用)应用开发。GLM 团队希望能和开源社区研究者和开发者一起,推动大模型研究和应用在中国的发展。

04. 在苹果 M1/M2 芯片上跑 LLaMA

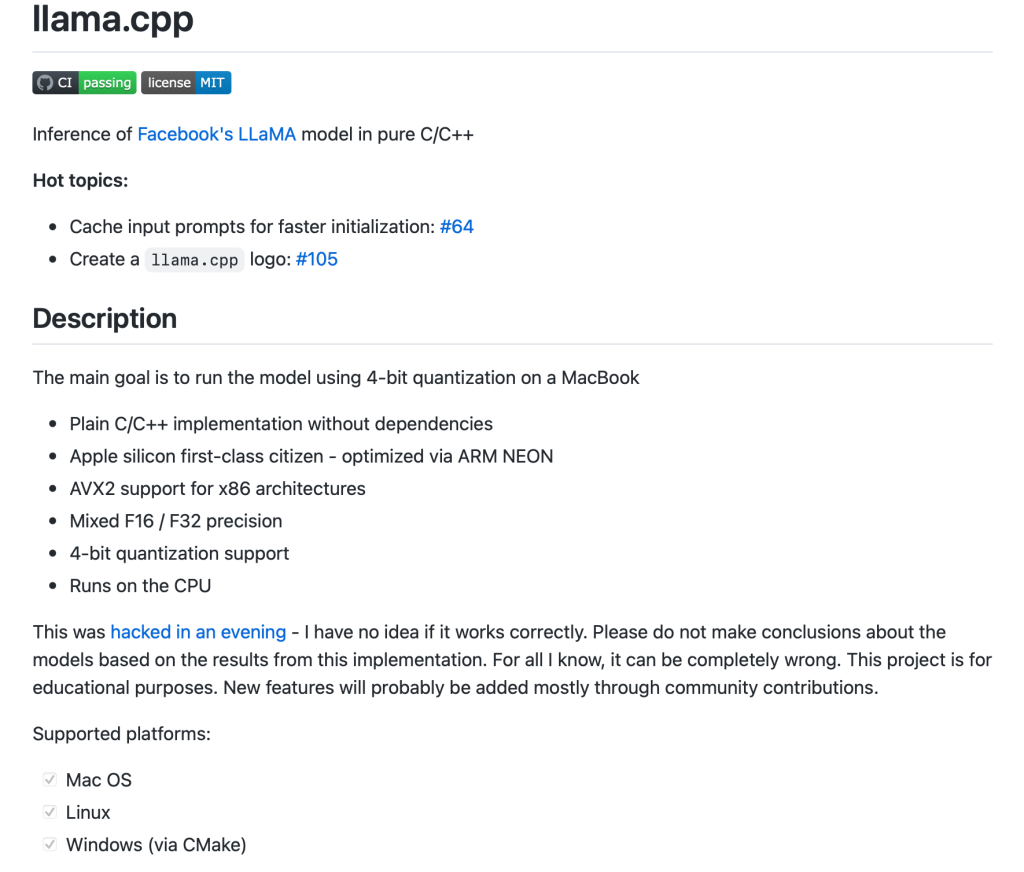

Georgi Gerganov 近日公布了一个没有专用 GPU 也能跑 Meta 大模型 LLaMA 的项目 llama.cpp。

https://github.com/ggerganov/llama.cpp

在基于苹果 M1 芯片的 Mac 上运行 LLaMA 涉及多个步骤,感兴趣的朋友可以参见教程( https://dev.l1x.be/posts/2023/03/12/using-llama-with-m1-mac/)。

在基于 M1/M2 芯片的 64GB MacBook Pro 上跑拥有 70 亿参数和 130 亿参数的 LLaMA 大模型可参见(https://til.simonwillison.net/llms/llama-7b-m2)。

如图所示,在 M1/M2 MacBook 电脑上跑 LLaMA 70B 大模型,输入提示词“登月第一个人是”,得到上述结果,从阿姆斯特朗登月的年龄、中间名和日期来看,没有出现明显的事实性错误。

研发人员 Artem Andreenko 说,他已在 4GB RAM Raspberry Pi 4 上成功运行 LLaMA 7B 模型。尽管速度很慢,大约 10 秒/token,但这展现了在便宜的硬件上运行强大认知 pipelines 的可能。

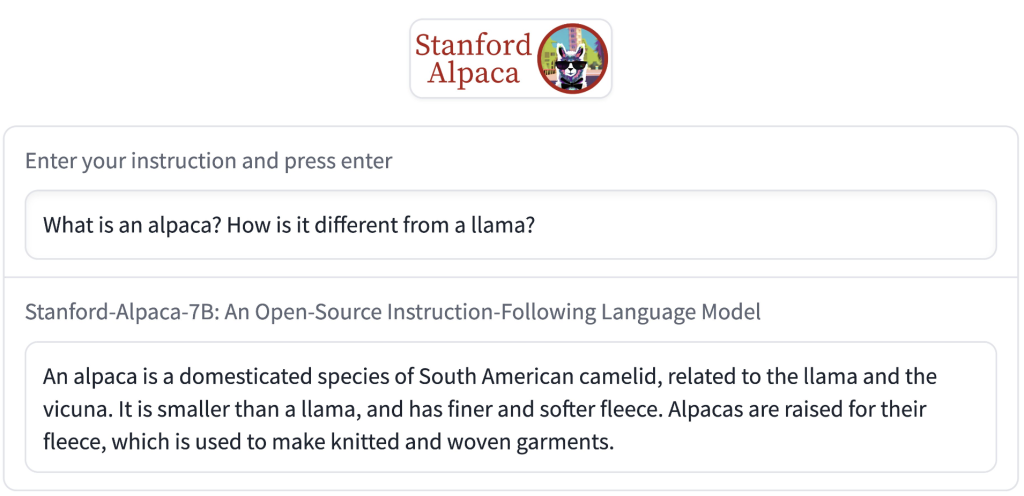

05. 斯坦福开源模型 Alpaca:性能媲美 GPT-3.5,成本不到 600 美元

斯坦福大学在本周二发布了一个由 LLaMA 微调的全新开源指令跟随模型 Alpaca,仅供研究使用,禁止用于任何商业用途。

该模型通过在 52k 生成指令上对 LLaMA 7B 进行微调实现,性能表现得像 OpenAI GPT-3.5(text-davinci-003),而训练成本不到 600 美元,因此便于复制及广泛部署。

https://crfm.stanford.edu/2023/03/13/alpaca.html

模型:

https://crfm.stanford.edu/alpaca

GitHub地址:

https://github.com/tatsu-lab/stanford_alpaca

该团队的目标是构建一个简单的模型/训练程序,让学者们可以用有限的资源进行研究和改进。

具体而言,Alpaca 模型使用来自 LLaMA 7B 模型的监督学习进行了微调,基于来自 OpenAI text-davinci-003的52K 指令跟随示例。

该团队从自生成指令种子集中的 175 个人工编写的指令-输出对开始,然后提示 text-davinci-003 使用种子集作为上下文示例生成更多的指令,通过简化生成 pipeline 来改进自生成指令方法,并显著降低了成本。

其数据生成过程产生了 52K 独特指令和相应的输出,使用 OpenAI API 的成本不到 500 美元。

在配备了这个指令跟随数据集之后,该研究团队使用 Hugging Face 的训练框架,利用完全分片数据并行和混合精度训练等技术,对 LLaMA 模型进行了微调。在 8 个 80GB A100 上对 7B LLaMA 模型进行微调需要 3 个小时,这在大多数云计算供应商上花费的成本不到 100 美元。

Demo:https://crfm.stanford.edu/alpaca/

Alpaca 团队正在发布其训练配方和数据,并打算后续发布模型权重。

06. 谷歌开放 PaLM API 推出生成式 AI 新平台

本周二,谷歌宣布开放大型语言模型 PaLM API,帮助企业“从简单的自然语言提示中生成文本、图像、代码、视频、音频等”。下图是生成式 AI 在谷歌文档中帮助撰写职位描述的示例。

谷歌还推出了一款与 PaLM API 搭配使用的新应用 MakerSuite,用户可以用它迭代提示、使用合成数据扩充数据集、轻松调整自定义模型。

计算密集型的训练和部署工作由谷歌云处理。同时,谷歌在其帮助企业训练和部署机器学习模型的 Vertex AI 平台中扩大对生成式 AI 的支持,允许用户访问由 Google Research 及 DeepMind 构建的更多模型,未来还将能利用开源和第三方系统。

此外,谷歌推出一个生成式 AI 新平台 Generative AI App Builder,允许开发人员快速发布新体验,包括机器人、聊天界面、自定义搜索引擎、数字助理等。开发者可以通过 API 访问谷歌的基础模型,并可以使用开箱即用的模板在几分钟或几小时内快速启动生成式应用的创建。

博客文章:https://blog.google/technology/ai/ai-developers-google-cloud-workspace/

07. 结语:生成式 AI 热潮正汹涌而来

毋庸置疑,大模型及生成式 AI 领域正变得越来越热闹,相关的研发与创意正喷涌而出。

我们既看到科研团队站在开源模型的肩膀上,研发出更廉价易得、能跑在消费级硬件上同时性能媲美 GPT-3.5 的大模型,又看到谷歌等科技巨头试图将更多 AI 工具及服务供给企业级用户。

生成式 AI 时代的大幕已然拉开,尽情享受吧!

扫码关注公众号

获取更多技术资讯