云厂商,掀起涨价潮

HelloKitty • 2026-03-24 14:32

1758

本文由 猎云精选 撰写/授权提供,转载请注明原出处。

以下文章来源于:猎云精选

作者:邵延港

有人说:“想搞垮一家 AI 公司,只需要让他调用的 API 接口涨价就行”。尽管这种现象还没有出现,但作为 AI“卖铲人”的云计算巨头与大模型厂商已经开始涨价了。

近日,阿里云与百度智能云两家巨头同时宣布涨价,对 AI 算力、存储等相关产品价格上调,最高涨价幅度超过 30%。让两家云巨头在过去持续的“价格战”中选择逆行的主要原因,是算力需求持续攀升对核心硬件及相关基础设施成本造成了巨大压力。

这并非特例,在此之前,腾讯云智能体开发平台就已经宣布,将对部分模型的计费策略进行优化调整,大模型厂商智谱也对旗下大模型的 API 调用价格上调。再往前,今年亚马逊云、谷歌等国际巨头已经悄悄涨价。

归根结底,在 AI 市场疯狂活跃的“小龙虾们” 难辞其咎。

2026 年,市场称为“AI 应用元年”,自今年年初以来,一个本地部署的 AI 智能体 OpenClaw,让用户看到了 AI 在工作中的强大能力,普通用户争先尝试,大厂们也陆续跟进,这一轮冲击不亚于几年前的 ChatGPT。

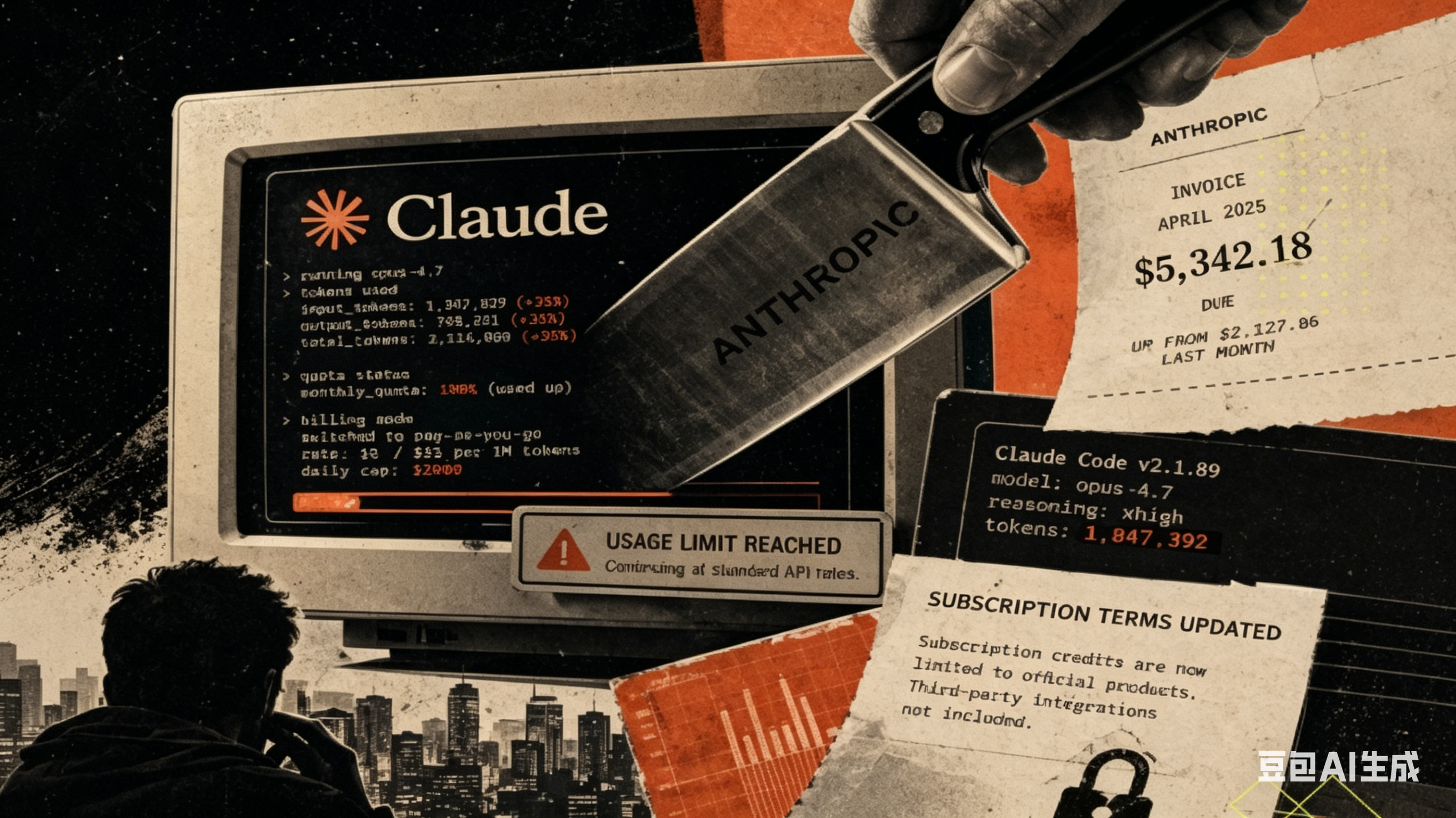

而 AI 应用爆发背后,是对云服务器与大模型调用的高度依赖,指数级增长的 Token 带来的成本账单,让此前靠免费或低价维持用户的大模型厂商最先感受到压力,然后传导致 AI 算力核心的云服务厂商和大模型服务商。

当前的涨价主要来自短期算力缺口,表象背后是 AI 逐渐成为刚需生产力,未来不只是企业用户,专业个人用户也要为 Token 买单。

云厂商与 AI 厂商启动涨价周期

3 月 18 日,百度智能云官网发布 AI 算力、存储等产品调价公告。公告称,自 4 月 18 日起,AI 算力相关产品服务价格上调约 5%-30%,并行文件存储等价格上调约 30%。

原因是受全球人工智能应用快速发展影响,算力需求持续攀升。核心硬件及相关基础设施成本出现显著上涨。为保障平台长期稳定运行与服务质量,百度智能云对部分产品价格进行结构性优化。

同一日,阿里云官网也发布涨价公告,平头哥真武 810E 等算力卡产品上涨 5%—34%,文件存储 CPFS(智算版)上涨 30%。原因是全球 AI 需求爆发、供应链涨价,行业核心硬件采购成本显著上涨。

感受到算力成本压力的,还有腾讯云。

腾讯云此前宣布自 3 月 13 日起调整智能体开发平台部分 AI 模型的计费策略,本次调整主要涉及两类变更:模型价格调整与公测模型结束免费。

根据公告,具体安排,一是公测模型结束免费,GLM 5、MiniMax 2.5、Kimi 2.5 模型将于 3 月 13 日结束免费公测,转为正式商用服务;二是变更为对混元系列模型 Tencent HY2.0 Instruct 与 Tencent HY2.0 Think 服务进行涨价,部分模型涨幅超 4 倍。

来源:腾讯云公告

此外,腾讯云还宣布将于 3 月 18 日起将视频处理、视频转码、综艺视频片段拆分等3款插件启动商业化计费,将从免费提供转为采用套餐付费模式。

看来在小龙虾智能体爆火后,Token 消耗翻了四倍多,腾讯云也扛不住成本,此举也是为了把价格拉回合理区间。

自此,国内三大云巨头都已经启动涨价策略,在今年 1 月,亚马逊 AWS 也宣布对用于大模型训练的 EC2 机器学习容量块实施15%的价格上调。同月,谷歌云对 CDN Interconnect、Direct Peering 等数据传输服务价格进行了大幅调整。这与云厂商“价格战”的市场印象,多少有些出入。

与此同时,大模型厂商也已经调高大模型 API 调用费用。3 月 16 日,智谱在发布最新大模型的同时,上调了 GLM-5-Turbo 的 API 价格,幅度为 20%。而在一个月前,智谱也在正式推出新一代旗舰模型 GLM-5 的第二天上调 GLM Coding Plan 套餐价格,其中中国区涨价 30%,海外版涨价超 100%。一个月两次涨价,让智谱新一代大模型较上一代产品的涨价幅度达到 83%。

自云计算商用以来,不断降价在用户看来是物理规律和边际成本等共同作用的必然结果。大模型也类似,早期凭借低价甚至免费来吸引用户,在算力效率提升的同时来降低边际成本。

两年前,包括阿里云、百度云以及腾讯云等国内主要云厂商纷纷卷入价格战,行业进入了“以价换量”阶段。尤其是彼时大模型正在爆发前期,云厂商需要用价格战来吸引开发者及企业用户入驻。

但云厂商的这种默契,被智能体应用突然打破。

AI 应用,狂吞算力

一切的元凶就是那只小龙虾掀起的 AI 应用普及浪潮。

过去几年,AI 的能力升级有目共睹。从 ChatGPT 起,市场对人工智能的想象力便逐渐放纵了起来。国内科技产业界也卷入大模型开发中,想要从这个聊天机器人中发掘更多可能,机器人、工作助手、智能搜索等行业都开启变革。如今 OpenClaw 的出现再次为人类思维搭上一根筋,AI要真的开始介入普通人的工作了。

据了解 OpenClaw 可部署在本地设备(如电脑、服务器),支持通过通讯软件(如微信、Telegram)下达指令,实现自动化任务,如文件管理、邮件发送、网页操作等。用户可自定义技能模块(Skills),赋予 AI 特定能力,如数据分析、内容创作等。

从技术原理上来看,OpenClaw 本身不依赖特定大模型,需接入外部大模型完成指令理解和任务执行。通过“规划-执行-观察”循环模式,结合大模型能力实现复杂任务自动化。

这也意味着,以 OpenClaw 为代表的智能体和众多 AI 应用,将大模型带到推理时代。

与之前的对话式通用大模型不同的是,OpenClaw 以任务为导向,通常涉及多轮理解、任务拆解、工具调用、状态衔接、时间触发和持续执行的长链路工作流。这也让智能体在实际场景中反复消耗 token。

有数据显示,OpenClaw 用户的单日人均 Token 消耗量是传统聊天用户的 20-50 倍。小龙虾爆火后,国内 AI 模型调用量自春节后持续飙升,阿里云百炼平台在 1-3 月创下了历史最高增速。目前中国主流大模型日均 Token 从 2024 年初 1000 亿飙升至 2026 年 180 万亿,谷歌月处理超 1300 万亿,字节、阿里等平台调用量同比增 10 倍以上。

因此,以“开源免费”吸引用户的 OpenClaw,实际使用成本却远比想象中的要复杂,AI 应用的运转也打开了 Token 时代的新格局。

AI 全民化普及,猛推巨头策略转向

在 AI 应用引发的暂时性算力缺口影响下,云厂商与大模型厂商被迫转变。

Token,在新一轮的 AI 潮流中站上了浪尖。Token,即词元,是大语言模型处理信息的基本单位,即数据进入模型前,经由切分、编码或量化得到的基本处理单元,如文本子词和图片像素方块。AI 每一次接收和处理人类信息,都是背后 Token 在燃烧。

如今,AI 产业已经将 Token 置于前所未有的地位。

3 月 16 日下午,阿里巴巴宣布成立 Token 事业群,由 CEO 吴泳铭直接负责,阿里将全面进军智能体 AI 时代。ATH 事业群的核心目标就是“创造 Token、输送 Token、应用 Token”为核心目标。

数小时后,英伟达 CEO 黄仁勋在 GTC 2026 上也提出了一套 Token 经济学,他指出在 AI 产业中,数据中心正在从训练模型的地方,变成生产 Token 的工厂。

若移动互联网时代数据流量是晴雨表,而 AI 时代,Token 就是风向标。

小龙虾爆火的背后是专业看到了智能体“干活”的新奇与对高效率渴望。OpenClaw 也在中国带火了一个“虾圈”,云端、移动端各类虾层出不穷,腾讯甚至在半个月内将旗下 QQ、微信、企微和元宝都作为龙虾部署渠道,打造了智能体矩阵。

由智能体普及带来的算力供不应求开启涨价周期,似乎成为了云厂商新一波红利的开始。但事实上,这也只是云厂商暂时性的供需错配。早期大模型产品新品不断,“训练”成为云厂商卖的最多的铲子。而到了 AI 应用阶段,推理成为了主角,云厂商早期因部署大量训练芯片而在推理环节的冗余面临巨大挑战,这才导致小龙虾们“不够吃”。

当 Token 效率问题暴露后,接下来要做的是从大模型底层的进化升级,以及新时代 Token 经济的新商业模式。

此前,智谱推出基于 GLM-5-Turbo 的龙虾 Claw 套餐,就包含个人版和 Team 版。企业可通过龙虾套餐的 Team 版,按照实际员工规模灵活订阅,以可预期的成本实现 tokens 的充分保障以及 AI 员工的稳定在线。

随着智能体应用的真正落地,成熟的 AI 生态也在形成,未来当上游云厂商看到下游活跃的无数只“龙虾”,或许已经重新定义了自己的角色。

扫码关注公众号

获取更多技术资讯