Anthropic,装糊涂的高手

HelloKitty • 2026-02-25 15:05

2912

本文由 硅星人Pro 撰写/授权提供,转载请注明原出处。

以下文章来源于:硅星人Pro

作者:周一笑

北京时间 2 月 24 日,Anthropic 在官方博客发布了一篇措辞强硬的文章,指控三家中国 AI 公司 DeepSeek、月之暗面(Moonshot)和 MiniMax(稀宇科技)通过约 24000 个虚假账户,与 Claude 产生了超过 1600 万次交互,目的是"非法提取"Claude 的能力来训练自己的模型。

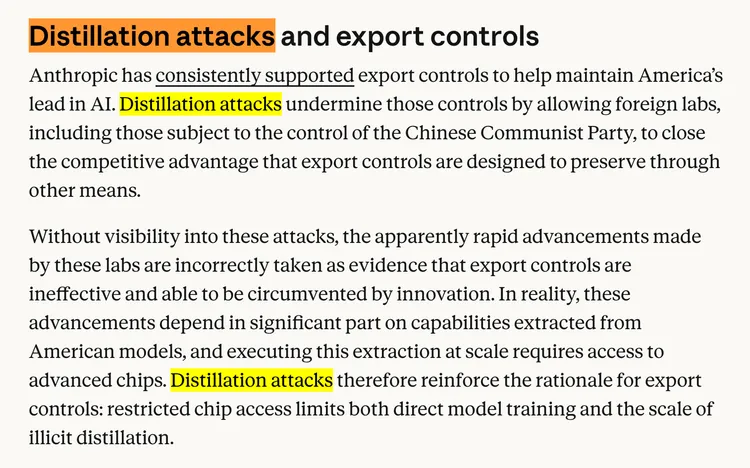

Anthropic 称这种行为为"蒸馏攻击"(distillation attacks),并将其上升到了国家安全的高度,声称这些行为不仅违反了服务条款,还"强化了出口管制的合理性",甚至可能帮助"部署前沿AI用于进攻性网络行动、虚假信息运动和大规模监控"。

博文还声称,Anthropic 通过 IP 地址关联、请求元数据和基础设施指标,将这些行为"高置信度"归因到了具体实验室,甚至追踪到了具体的研究人员。

这篇博文的技术证据看起来是扎实的,但细看经不起推敲,一个技术上最强的 AI 公司,发如此漏洞百出的大字报,其实是目的明确,如果仔细阅读,你会发现它真正想说服的对象不是技术社区,而是华盛顿。那些技术上的模糊,都是它装糊涂的一部分。

不到 1% 的 DeepSeek,100% 的标题位

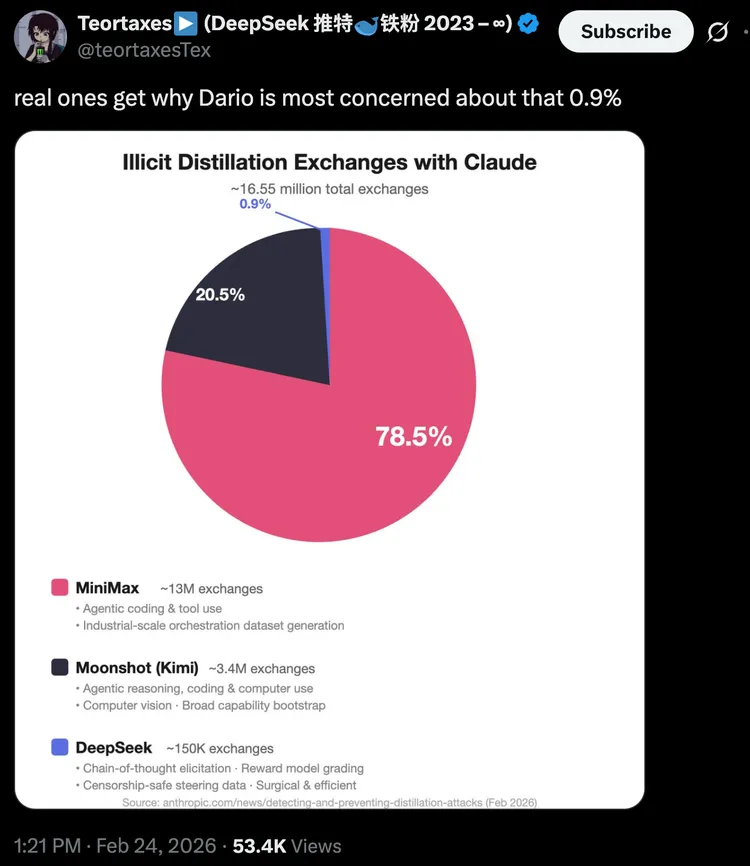

先看数据。三家公司的蒸馏规模差异巨大,MiniMax 超过 1300 万次交互,月之暗面超过 340 万次,而 DeepSeek 只有约 15 万次。换句话说,DeepSeek 在这 1600 万次交互中占比不到 1%。

然而在 Anthropic 的博文标题、推文,以及随后所有英文媒体的报道中,排序都是“DeepSeek、Moonshot和MiniMax”。

Anthropic 博文中对三家公司的描述也颇有玄机。MiniMax 的蒸馏规模最大,策略最具适应性,Anthropic 发布新模型后,MiniMax 在 24 小时内就将近一半流量转向了新系统,重点提取编程和工具使用能力。月之暗面的操作最具技术野心,不仅针对智能体推理、编程和计算机视觉能力,后期还试图提取和重建 Claude 的推理链(reasoning traces)。相比之下,DeepSeek 的 15 万次交互在技术层面几乎微不足道,但 Anthropic 对它的描述却着墨最多,因为它包含了华盛顿最能感知到杀伤力的细节。

Anthropic 的排列方法,就是按它们在华盛顿的政治知名度排序。DeepSeek 是自 2025 年初以来美国AI政策辩论中最具标志性的名字,它象征着出口管制争议、中美 AI 竞争焦虑,以及“中国AI是否真的只靠自主创新”的核心疑问。把 DeepSeek 放在第一位,整篇博文自动激活了这套完整的政治叙事框架。在 Anthropic 选择单独拎出来讲的细节里,对 DeepSeek 的“指控”也包括“安全替代回答”等,这些细节的技术意义非常有限,但能精准命中地缘政治里的敏感点。在这方面,Anthropic 懂得很。

“蒸馏攻击”:一个被武器化的术语

蒸馏(knowledge distillation)是机器学习领域一项成熟且普遍的技术,最早可以追溯到康奈尔大学 Rich Caruana 等人的研究,核心思路是用一个强大的“教师模型”的输出来训练一个较小的“学生模型”。所有主要 AI 实验室都在使用这项技术,Anthropic 自己也在博文中承认,“前沿 AI 实验室会定期蒸馏自己的模型,以为客户提供更小、更便宜的版本”。

用竞争对手的 API 输出来训练自己的模型?这在行业内接近于公开的秘密。2025 年初 DeepSeek R1 模型发布时,Databricks CEO Ali Ghodsi 就直言,蒸馏技术“极其强大,极其廉价,而且对任何人都可用”。Google 的威胁情报团队两周前刚发布报告,称在 2025 年期间“识别并阻断了来自世界各地研究人员和私营企业的模型提取活动”。这不是 Anthropic 独有的遭遇,而是整个行业面临的结构性现实。

甚至不少开发者也多次展示过,在 Anthropic 的模型交互中,显示出它对 DeepSeek 的蒸馏痕迹。

违反服务条款?确实成立。不只是 Anthropic,各大厂的服务条款里现在都会明确禁止使用其服务来训练或开发“与它竞争”的 AI 模型。

但需要指出的是,AI 模型的输出即便在美国法律框架下都并不享有版权保护。美国版权局 2025 年 1 月确认,版权保护要求人类作者身份,“仅提供提示词不使输出受版权保护”。这意味着从法律角度看,这只与合同违约事件相似,而非知识产权盗窃。

然而 Anthropic 在博文中完成了一次概念偷换,它把这种本质上的合同违约行为,重新定义成了“攻击”。

“蒸馏攻击”这个术语把一个中性的机器学习概念与军事化的攻击一词绑定在一起,配合博文中反复出现的“国家安全”、“生物武器”、“威权政权”、“出口管制”等关键词,一起商业行为被升级为一起国家安全事件。博文甚至还使用了“hydra cluster”(九头蛇集群)这样的军事化措辞来描述其中使用的网络架构,整篇文本的语言选择是刻意且系统性的。

为什么是现在:一条被忽视的时间线

要理解这篇博文,需要将它放回它发布时的更大背景中。

2 月 16 日,Axios 报道称五角大楼警告 Anthropic 将“付出代价”,并威胁将其列为“供应链风险”。这个标签通常是给外国对手的,意味着所有与五角大楼合作的公司都必须证明自己没有使用 Claude。矛盾的核心在于,Anthropic 不希望 Claude 被用于大规模监控美国公民或开发完全自主武器,而五角大楼要求所有 AI 模型开放“所有合法用途”,不附加任何条件。

2 月 18 日,CNBC 报道双方合同谈判陷入僵局。2 月 20 日,NBC 报道称 Anthropic 因质疑 Claude 在 1 月美军突袭抓捕委内瑞拉总统马杜罗行动中的使用方式,与五角大楼的关系“达到沸点”。据报道,一名 Anthropic 高管向合作方 Palantir 询问 Claude 是否被用于该行动,引发了军方的强烈不满。五角大楼发言人随即宣布“正在审查与 Anthropic 的关系”。

2 月 23 日,Axios 报道国防部长 Hegseth 将于次日召见 Dario Amodei,国防部官员对媒体形容这是一场摊牌会面,一位高级官员直言,“Dario 的问题在于,对他来说这是意识形态。我们知道我们在跟谁打交道。”同一天,Elon Musk 的 xAI 与五角大楼签署了协议,接受“所有合法用途”条款,等于在 Anthropic 面前树了一个听话的标杆。

也是在 2 月 23 日,Anthropic 发布了这篇蒸馏博文。

一篇通篇强调国家安全、出口管制、中国威胁的技术报告,恰好在 CEO 被五角大楼召见的前一天发出,恰好在 2 亿美元国防合同悬而未决之际发出,恰好在五角大楼威胁要将自己列为“供应链风险”的一周之后发出,恰好在竞争对手 xAI 刚刚向五角大楼“表忠”的同一天发出。如果这是一次纯粹的技术披露,为什么不在检测到蒸馏行为时就公布?为什么要等到与五角大楼的关系降至冰点的这一刻?

博文发布后,据报道,2 月 24 日,Dario Amodei 已前往五角大楼赴会。若最终谈成改变“初衷”的合同,这篇通篇威胁论的“技术报告”,就可以是支持它如此决策的依据。

“我可以蒸馏全世界的知识,但你不能蒸馏我的输出”

Anthropic 的道德立场还面临另一个尴尬。

就在一个月前,法院解封的 4000 多页文件揭露了 Anthropic 的巴拿马计划(Project Panama)。这家公司花费数千万美元,从二手书商大量购买实体书,用工业液压切割机切掉书脊,高速扫描每一页,然后将纸质书销毁回收。内部文件显示,项目的目标是“破坏性扫描全世界的书”,计划在六个月内处理 50 万到 200 万本。在此之前,Anthropic 联合创始人 Ben Mann 还曾从盗版网站 LibGen 下载了数百万本书用于早期模型训练。去年,Anthropic 以 15 亿美元和解了相关版权诉讼,但未承认任何不当行为。

一边是蒸馏全世界人类作品来训练自己的模型,一边是指控别人蒸馏我的模型输出并将其定性为国家安全威胁。这种双标并未逃过社交媒体上的审视。科技评论人 Gergely Orosz 在 X 上写道,“Anthropic 在网上抓取受版权保护的材料,创建一个收费模型,不支付补偿,这显然是公平的?

现在 Anthropic 抱怨其他公司付费使用模型,来创建任何人都能免费使用的模型,这就不公平了?”

也有评论人士指出,“蒸馏不是攻击,没有影响你服务器任何性能。蒸馏如果有问题,它的问题绝对不大于你破坏版权、蒸馏全世界人类作品。”

从法律角度看,这两件事的性质确实不同。前者涉及版权法下受保护的人类创作作品,后者涉及法律上不受版权保护的 AI 输出。有法律分析指出,即便 Anthropic 能证明蒸馏确实发生了,它也不太可能拥有被提取数据的版权。合同法(即 ToS 违约)可能是比知识产权法更有效的诉讼路径。但从道德叙事的角度看,一家靠“蒸馏”人类知识起家的公司,指控别人“蒸馏”自己的输出是“攻击”,这中间的说服力落差是显而易见的。

这也导致了在这篇博文发布后,在 X 等平台上,批评 Anthropic 的声音甚至大过了所谓蒸馏指控的讨论。

Anthropic 自己不会没意识到,但显然它决定装糊涂。因为这篇博文的目的,从来不只是技术披露。

这是一次在五角大楼关系危机中的战略表态,用真实的技术证据,包装了一个服务于自身利益的国家安全叙事。它的受众不是技术社区,而是华盛顿的政策制定者。这并非没有先例。特朗普政府的 AI 顾问 David Sacks 早在去年 10 月就公开指控 Anthropic 在搞“基于恐惧贩卖的精密监管俘获策略”。蒸馏博文的发布时机和修辞策略,恰恰印证了这一判断。

Anthropic 一直试图在“AI 安全领导者”和“国防承包商”之间维持一种微妙的平衡。它以安全为核心品牌叙事,对模型的军事用途设置限制,但它同时又是第一家将模型部署到军方机密网络的 AI 公司,拥有价值 2 亿美元的国防合同。当这两个身份发生冲突,当五角大楼要求它在安全限制上让步,它需要一个故事来重新证明自己对国家安全的价值。指控中国公司蒸馏 Claude,恰好就是这样一个故事。

一家公司学会了把商业竞争包装成国家安全叙事,把合同违约包装成“攻击”,把行业普遍存在的灰色地带包装成单方面的受害者故事,我们也许需要问的不只是“谁在蒸馏 Claude”,还有“Anthropic 在蒸馏什么”。它正在从真实的技术事件中,蒸馏出一套服务于自身政治生存的叙事。

扫码关注公众号

获取更多技术资讯