MiniMax和Kimi为了“注意力”,隔空交手

HelloKitty • 2025-11-03 11:39

2409

本文由 硅星GenAI 撰写/授权提供,转载请注明原出处。

以下文章来源于:硅星GenAI

作者:周一笑

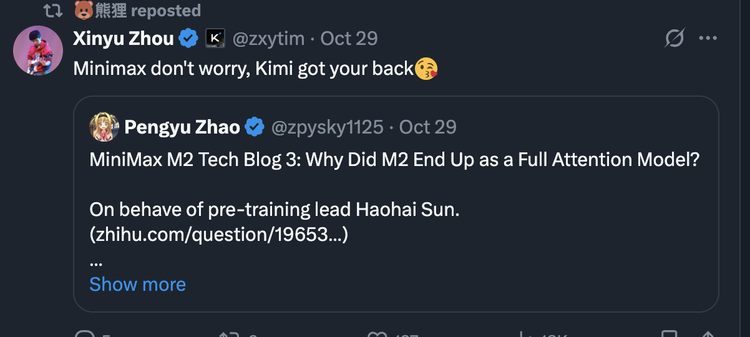

10 月 29 日,月之暗面研究员周昕宇(Zhou Xinyu)在 X 上转发了 MiniMax M2 Tech Blog 的推文,并评论道:“Minimax don't worry, Kimi got your back ”。不仅如此,他还在知乎的同一篇博文下留下了同样的评论,这种带有调侃意味的公开“示好”,既像挑逗,也像挑衅。

在 M2 发布两天后,MiniMax 的预训练负责人孙浩海(Haohai Sun)在知乎和 X 发布了一篇技术博客,罕见地坦诚地说明了团队为什么放弃 efficient attention,“为什么不做 linear/sparse attention”?“一直在做,但是在工业系统里真的打过 Full Attention 还有些距离”

周昕宇的评论显然有所指,但“got your back”究竟是什么意思?答案在 24 小时后揭晓。10 月 30 日,月之暗面发布了Kimi Linear,一个 48B 参数的混合注意力模型,声称在长上下文任务中 KV Cache 减少 75%,吞吐量提升 6 倍。

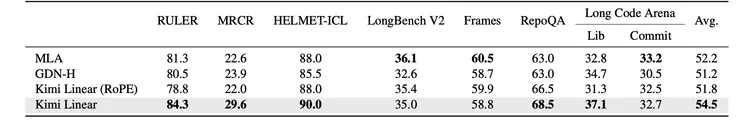

技术报告的 Abstract 写道:“for the first time, outperforms full attention under fair comparisons across various scenarios”(首次在公平对比下全面超越全注意力)。

从 MiniMax M2 发布到 Kimi Linear 发布,恰好 72 小时。这种技术路线扽差异是大模型行业在效率与性能之间的路线探索,争论仍未尘埃落定。

MiniMax M2:回归 Full Attention

MiniMax 此前的 M1 Lightning 采用 Softmax + MoE 的混合式架构,支持百万级上下文。到了 M2,MiniMax 选择了回归 Full Attention。

M2 的定位是 Agent 和代码生成,强调"大巧若拙"的产品哲学。在价格上,M2 仅为 Claude Sonnet 4.5 的 8%(每百万 Token 输入 0.3 美元),推理速度快近 2 倍(TPS 约 100)。MiniMax 在官方发布文章中表示,这是通过"高效的激活参数设计"实现的"智能、速度与成本的最佳平衡"。

《为什么 M2 是 Full Attention》这篇文章在知乎和 X 都获得了不少好评。X 上的评论者认为这是“难得的工程视角分享”,“对行业非常有价值”。一位名为@TensorTemplar 的评论者说:“难得见到如此详尽公开分享模型架构的整体工程视角。关于稀疏注意力尾部风险的论述非常精彩!在复杂多轮使用场景中尚未证明其等效性前,我暂不愿称之为‘高效’。”

Haohai 详细阐述了三个核心困难。第一个是工程链路复杂性爆炸。用他的话说,“需要同时满足 code/math、agent、多模态、Long CoT、RL、低精度运算、缓存、speculative decoding 等众多场景”。翻译成人话就是,现代大模型不只是做一件事,而是要同时支持十几种不同的应用场景。每增加一种 efficient attention 机制,就要在所有这些场景下验证,工程复杂度呈指数级增长。

第二个困难是评测体系局限。“小规模实验的结论无法外推,复杂多跳推理任务的缺陷只在大规模时暴露。”在小模型上测试效果好,不代表在大模型上也好。很多问题只有在训练到一定规模时才会暴露,但那时候已经投入了大量资源,来不及调整。Haohai 在评论区补充说,复杂多跳推理任务可以参考 KorBench、BBEH 等榜单,以及 BBH 里的 dyck language 任务。

有评论者问“你们是否尝试过其他线性注意力变体,比如门控 Delta Net 或 Mamba2?"Haohai 回复:”GDN 混合模型表现尚可,Mamba2 < Mamba2 + qknorm ≈ GDN。但与全注意力模型相比,这些模型在推理密集型基准测试(如 BBH)中表现相对较弱。“MiniMax 在实际测试中发现了问题。

第三个困难是基建不完善。“Linear Attention 的训练是访存 bound,推理需要解决低精度存储、Prefix Cache、投机解码等问题。”即使理论上 linear attention 更快,但实际工程中需要解决很多基础设施问题。训练时内存带宽成为瓶颈,推理时需要支持各种优化技术,这些都还没有成熟的解决方案。

这篇博客的评论区也透露了一些重要信息。一位名为 silicon 的开发者评论道:“我自己都开发了近百种 Transformer 变体了,但‘验证新变体是否先进’所花的时间远远大于开发算法的时间”。Benchmark 困境不只是 MiniMax 的问题,而是整个行业的痛点。

另一个问题是关于成本和时延的澄清。当有网友问“Agent 场景下 Full Attention 会成为瓶颈吗”时,Haohai 回答是:“GPU 的进步非常快,对 Full Attention 来说目前只有成本问题,没有时延问题。”也就是说核心矛盾不是速度慢,而是成本高。MiniMax 的策略是等待 GPU 进步解决成本问题,同时通过工程优化(如“高效的激活参数设计”)来平衡性能和成本。

月暗的“挑逗”和 Kimi Linear 的发布

Zhou Xinyu 是月之暗面的研究员,也是 MoBA(Mixture of Block Attention)论文的核心作者之一,他的“挑逗”背后藏着一个大招。10 月 30 日晚,月之暗面发布了 Kimi Linear,一个 48B 总参数、3B 激活参数的 MoE 模型,训练数据达 5.7T tokens,支持 1M tokens 的上下文长度。模型权重、代码和技术报告全部开源。从 M2 发布到 Kimi Linear 发布,72 小时。

Kimi Linear 有三个值得注意的点。

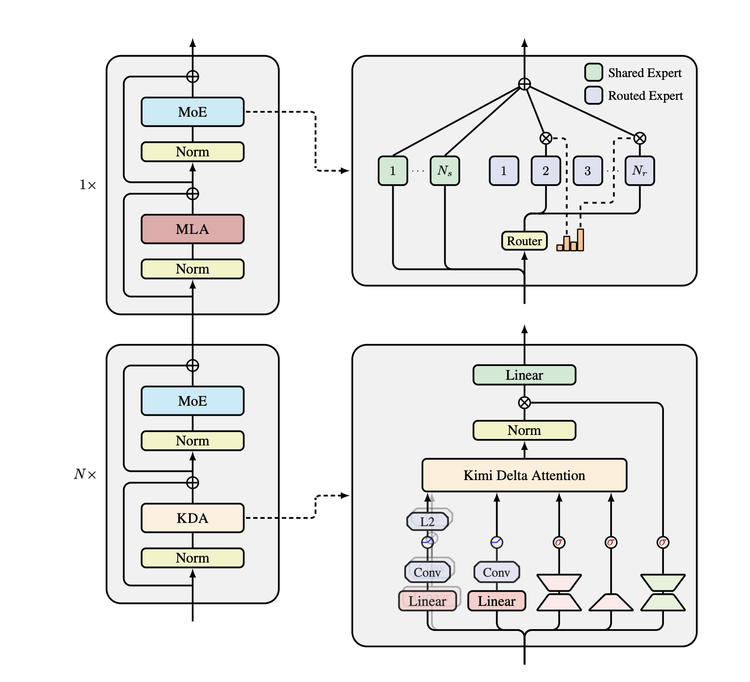

第一个是 Kimi Delta Attention (KDA)。KDA 基于 Gated DeltaNet,引入了 fine-grained gating 机制。具体来说,它从 scalar gate(标量门控)升级到 channel-wise gate(通道级门控),让每个特征维度都有独立的遗忘因子。用人话说,就像给模型装了更精细的"记忆开关"。传统的门控机制是一个总开关,要么全记住,要么全忘记。而 KDA 可以针对不同类型的信息分别控制记忆强度,比如对代码语法记得牢一点,对临时变量忘得快一点。这个改进带来了显著的性能提升,相比标准 DPLR 实现,KDA 的计算效率提升了约 100%。

第二个是 3:1 的混合比例。Kimi Linear 采用了 Hybrid 架构,将 KDA(线性注意力)和 MLA (Multi-head Latent Attention)混合使用。MLA 是 DeepSeek 在 V2/V3 中使用的技术,通过将注意力输入压缩成低维潜在向量,然后在需要计算注意力时映射回高维空间,显著减少了内存需求。关键问题是混合的比例应该是多少?Kimi 团队通过系统性的 ablation study 找到了答案:3:1,也就是每 3 层 KDA 配 1 层 MLA。

实验结果显示,3:1 是平衡性能和效率的最佳点。纯 MLA(0:1)的validation PPL 是 5.77,3:1 是 5.65,1:1 是 5.66,7:1 是 5.70,15:1 是 5.82。太多全注意力(1:1)浪费资源,太少(7:1、15:1)影响性能。

Kimi Linear 模型架构示意图。该模型由一系列堆叠的模块组成,每个模块包含一个 token 混合层(token mixing layer),其后接一个 MoE 通道混合层(channel-mixing layer)。

第三个是 No Position Encoding (NoPE)。Kimi Linear 的 MLA 层不使用位置编码(如RoPE),所有的位置信息完全由 KDA 层负责。这个设计带来三个好处:推理效率更高(MLA 可以转换为更高效的 MQA)、训练更简单(避免了 RoPE 参数调整)、长上下文泛化更好。

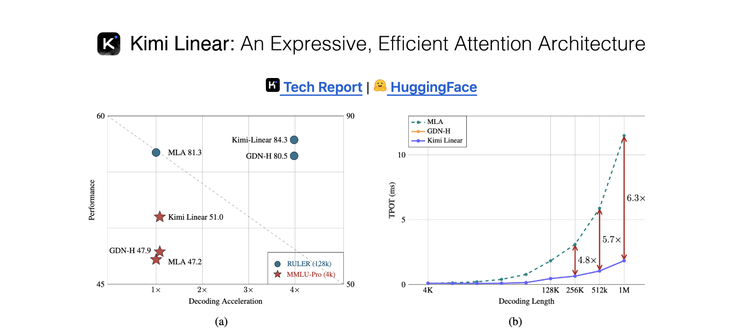

Kimi Linear 的性能数据很亮眼。技术报告显示,Kimi Linear"显著减少了高达 75% 的 KV cache 需求",这意味着内存占用降低 4 倍,直接降低了部署成本。在 1M tokens 的长上下文场景中,Kimi Linear 的解码吞吐量比 MLA(全注意力)快 6.3 倍。具体数据是 TPOT(Time Per Output Token)从 11.48ms 降到 1.84ms。

在 RULER 基准测试(128k context)上,Kimi Linear 达到 84.3 的性能,同时速度是 MLA 的 3.98 倍。技术报告称这是"Pareto-optimal",性能和速度都是最优,没有 trade-off。

Kimi 团队用 1.4T tokens 的训练验证了 scaling law。MLA 的 Loss 是 2.3092 × C^(-0.0536),Kimi Linear 是 2.2879 × C^(-0.0527)。技术报告总结:“Kimi Linear achieves ∼ 1.16× computational efficiency”。大规模训练中,Kimi Linear 仍然优于 Full Attention。

为了验证理论正确性,Kimi 团队在三个合成任务上测试了 KDA:Palindrome(回文任务)、MQAR(多查询关联回忆)、Stack(栈追踪)。KDA 在所有任务上都达到 100% 准确率,而 GDN 和 Mamba2 在长序列上失败。这些任务测试的正是复杂多跳推理能力。

这也是 Linear attention 首次在公平对比下全面超越 Full Attention。不是特定任务,而是"across various scenarios"(各种场景),包括 short-context、long-context、RL scaling。

Kimi Linear 的工程化成熟度还体现在 vLLM 集成上。vLLM 是 UC Berkeley 开发的开源 LLM 推理框架,是全球最主流的推理引擎之一。Kimi Delta Attention(KDA)算子已被 vLLM 官方整合进主代码库。这意味着 vLLM 用户只要升级到最新版本,就可以直接使用 Kimi 的注意力实现。

MiniMax 向左,Kimi 向右

MiniMax 和 Kimi 的选择,代表了两种不同的技术路线。整个行业也都在探索,DeepSeek 用 MLA 改造/压缩 KV-cache,Mistral 引入滑动窗口稀疏模式,OpenAI 与 Anthropic 的具体注意力实现未公开,业内普遍认为其以 Full Attention 的工程化加速为主。

不同选择反映了效率与性能的不同权衡。MiniMax 选择 Full Attention,核心逻辑是等待 GPU 进步解决成本问题,同时通过工程优化来平衡性能和成本。Full Attention 是经过多年验证的技术,不需要担心在某些场景下的隐藏弱点。

Kimi 选择 KDA + MLA,核心逻辑是主动优化架构降低成本,系统性解决工程化问题。这种选择的优势是效率更高、成本更低、长期可能竞争力更强,但也面临更大的工程挑战,需要在多个场景下验证稳定性。Kimi Linear 的发布证明,至少在月之暗面的技术体系中,他们找到了可能的解决方案。

两种选择都有其合理性。MiniMax 的策略是时间换空间,赌 GPU 进步会解决成本问题。Kimi 的策略是空间换时间,通过技术创新主动降低成本。哪种路线更好?目前还没有定论。

不过,这种不同路线的探索和公开的技术讨论,对整个行业都是一件好事。它让外界看到了大模型技术演进的真实图景,没有正确答案,而是多条路径的并行探索。MiniMax 和 Kimi 的坦诚和创新,都在推动行业进步。

但在技术探讨之外,两家公司在实际层面的竞争也不容忽视。月之暗面和 MiniMax 都定位于中国头部通用大模型,在长上下文、代码/Agent、开源推理生态等方面同场竞跑。技术路线的选择不仅关乎技术本身,也关乎资本市场的认可和长期竞争力。

这是 Full Attention 和 Efficient Attention 两种技术路线的较量,也是 MiniMax 和 Kimi 两家公司的角力,两件事情都会持续下去。这场关于 Attention 机制的技术之争,本身也成了一场“注意力之争”

扫码关注公众号

获取更多技术资讯