Gork-3语音功能上线!马斯克手把手教学搭建10万GPU超算中心

HelloKitty • 2025-02-28 11:14

3857

本文由 硅兔君 撰写/授权提供,转载请注明原出处。

以下文章来源于:硅兔君

作者:Cora

编辑:Evan

今天,由 xAI 开发的 Grok APP 推出了实时语音模式,共支持 10 种模式,用户可通过语音与 AI 对话甚至电话式沟通,进一步提升 Grok 系列大模型信息交互体验。

就在前不久,2 月 20 日上午,Grok 3 宣布向 x 用户免费开放。xAI 发帖称,世界上最聪明的 AI Grok3 现在免费提供(直到我们的服务器崩溃)。

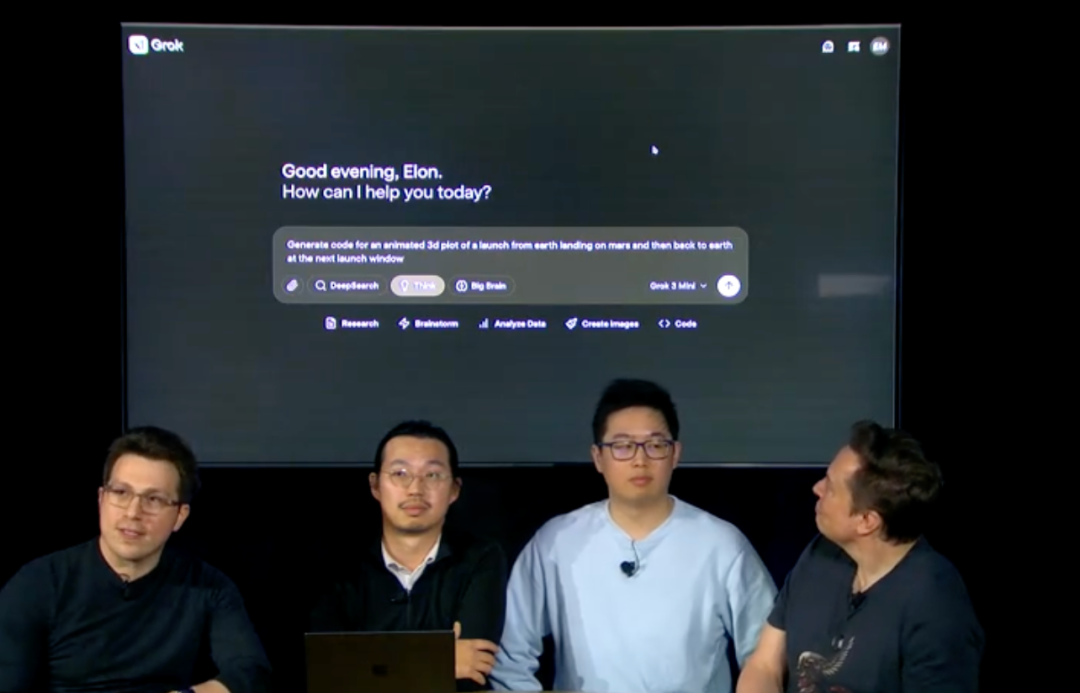

此前,马斯克带着 xAI 首席工程师 Igro、研究工程师 Paul、推理工程师 Tony 在社交媒体 X 上直播发布最新 AI 大模型 Grok-3,引发 700 万人次观看。

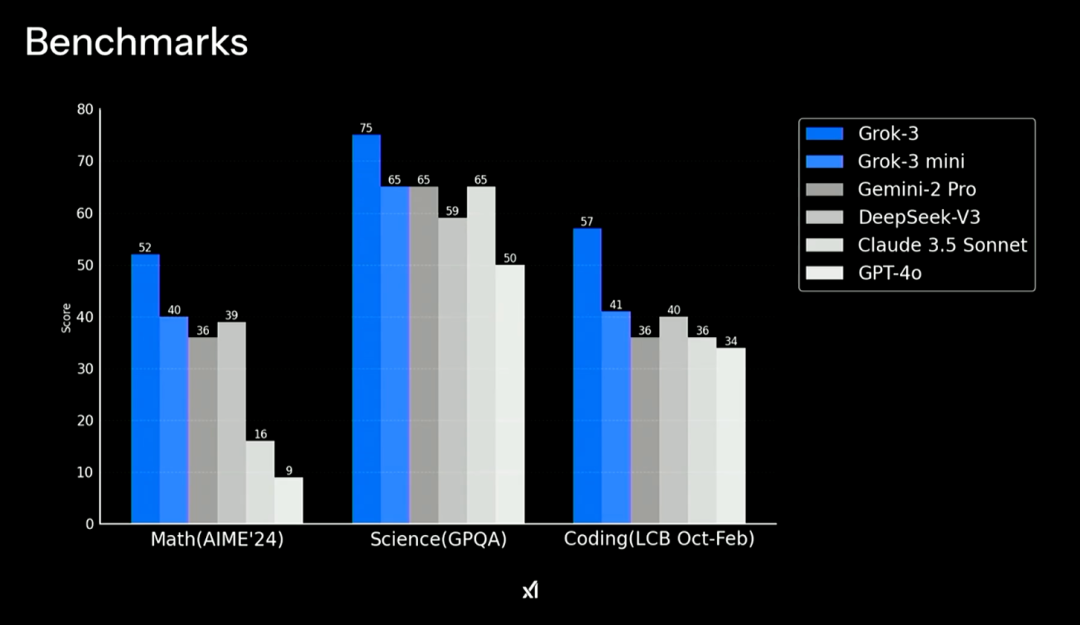

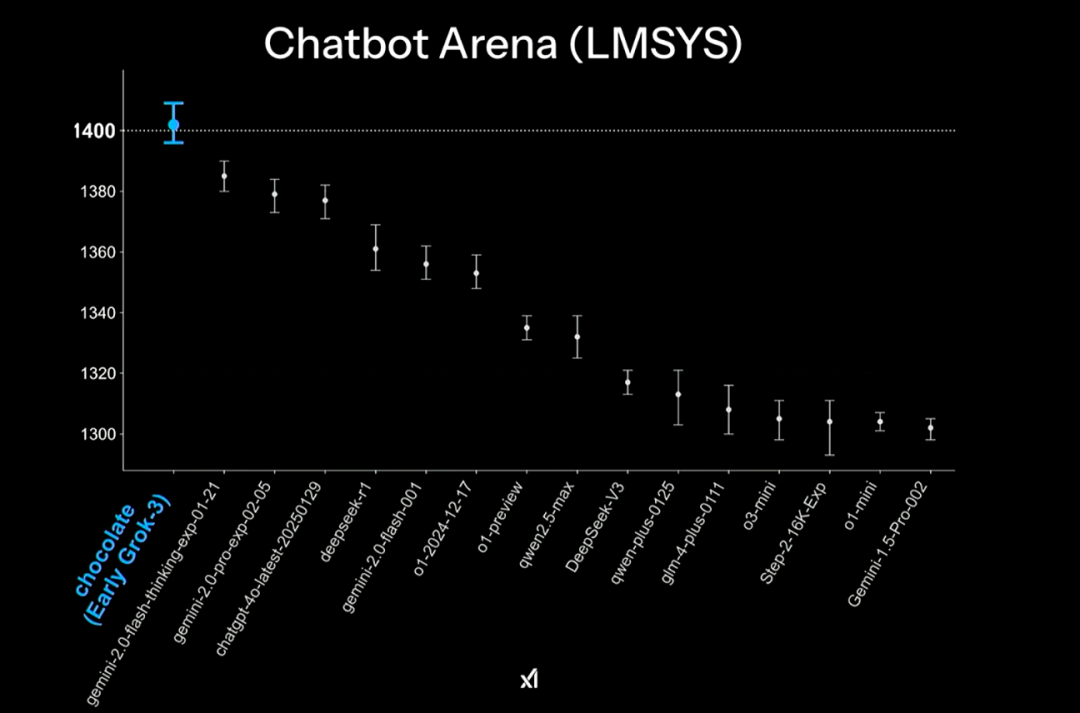

发布当天,xAI 称在数学、科学和编码基准测试中,Grok-3 击败了 OpenAI 的 GPT-4o、谷歌的 Gemini、DeepSeek 的 V3 模型和 Anthropic 的 Claude。

马斯克称 Grok-3 在很短的时间内比 Grok 2 性能提高了一个数量级,为“地球上最智能的 AI”。

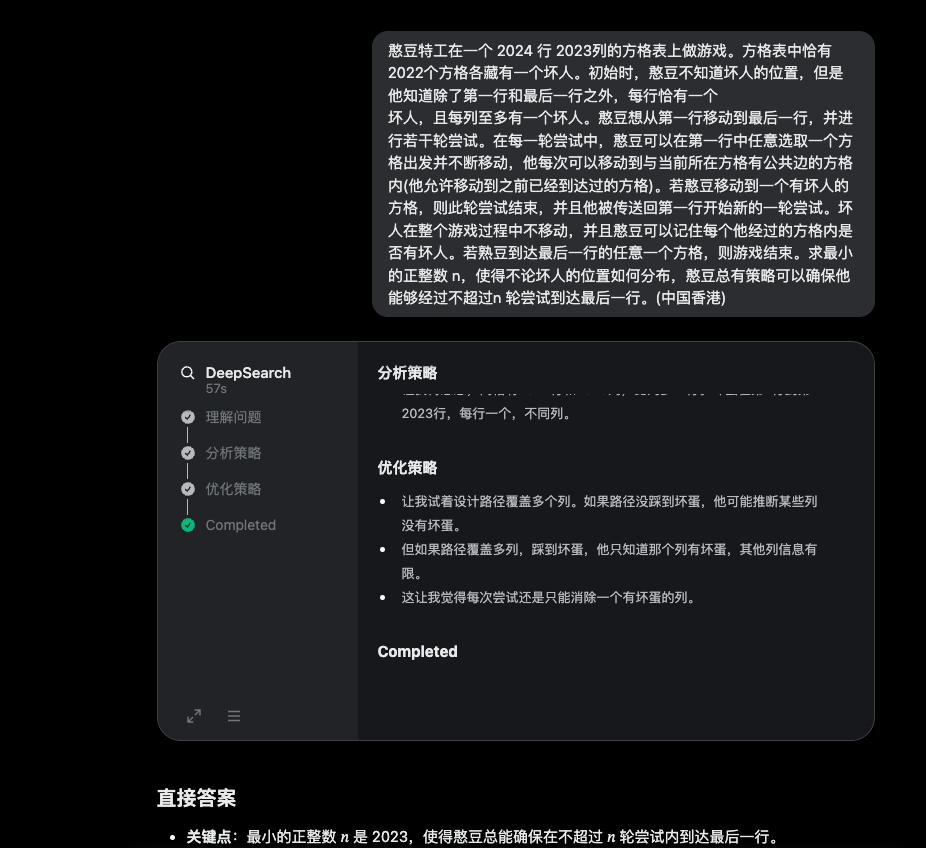

此次,xAI 还通过 Grok-3 推出了一款新的智能搜索引擎 DeepSearch,可以直观展现自己理解题目,表达其理解查询的过程以及计划响应的方式。马斯克特别强调到目前该模型只是测试版本,后续将不断改进模型。“几乎每 24 小时,你就能看到改进版本。”

据悉,马斯克的 xAI 正洽谈一轮融资,筹资约 100 亿美元,估值约为 750 亿美元。据 PitchBook 数据,目前该公司的最新估值约为 510 亿美元。同时,马斯克旗下社交媒体 X 正洽谈以 440 亿美元的估值筹集资金。

现在,X Premium+和 SuperGrok 用户将享有更高的访问权限,并可抢先体验语音模式等高级功能。

Grok3 体验地址:https://x.com/i/grok

马斯克如何在 122 天内

打造最大数据中心集群?

马斯克在 40 分钟的直播中花费了十几分钟详细介绍了自己是如何搭建起建数据中心集群。

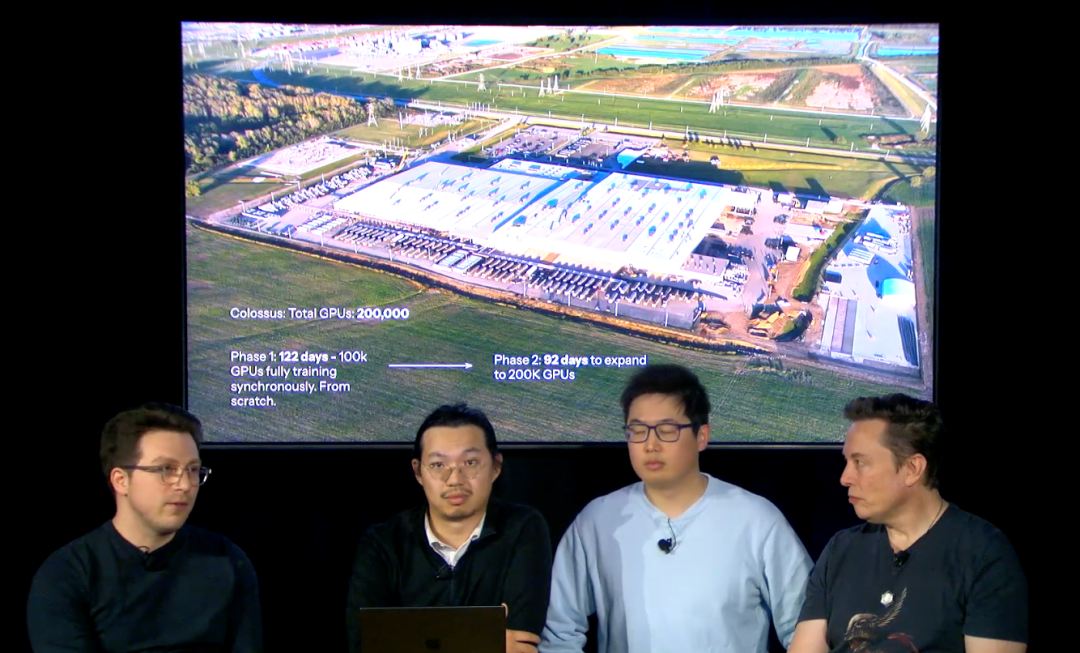

马斯克提到训练 Gork-2 时,大约花费了 6500 张 H100 处理器,他们为 Gork-3 准备了 10 万 GPU。尽管马斯克能够在极短的时间内筹备出 10 万张 GPU,但是,xAI 团队仍需要解决能源、场地等一系列问题。

“在 122 天内,我们能够让 10 万个 GPU 处理器运转起来。我相信,这是同类中最大已经投产的 H100 集群。”Igro 补充道。在随后 92 天时间里,xAI 又投入了 10 万个 GPU,并加速推出了 Gork-3。

首先是他们急需寻找一个工厂。因为新建工厂时间肯定来不及,所以他们优先选择一些已有的,且废弃的工厂。最后,他们选择了马斯克数据中心集群主要位于美国田纳西州孟菲斯市。

围绕着工厂,他们接下来需要解决数据中心的能源问题。为了赶进度,xAI 马不停蹄地推动数据中心运转,甚至一开始租借了非常多的发电机,以及一些发电车来保证数据中心的运转,直到整个工厂的电力系统搭建完善,接入公共电力体系。

在试运行电力阶段,xAI 发现超算中心的电力时十分不稳定的,GPU 集群所承载的电力会非常波动,会经常造成发电机故障。为了解决这一难题,xAI 特别借用了特斯拉的团队,最后选择采用了 Megapacks 方式来平滑整个电力使用,形成较为稳定的电力运载系统。

现在数据中心的电力并不维持在某一两个开关上,xAI 团队对整个数据中心集群重新设计。“具体而言,我们现在数据中心厂房构建方式相对特殊,走进我们厂房里,你拉掉几个电缆线,数据中心仍然能够正常运行。这可能是大多数数据中心团队并不会关注的。”Paul 说道。

解决了电力,就要开始管理网络的事情。在数据中心搭建阶段,马斯克提到团队曾在凌晨四点去解决网络连接设备不匹配等问题。

数据中心运作的时,为了解决冷却问题,马斯克谈到自己几乎租用了 1/4 的美国移动冷却设备,来保持厂房内温度正常,并设立重新搭建了完善的液冷系统。

马斯克在 122 天内迅速搭建成了一个集成 10 万 GPU 的超算中心。同时,在 92 天时间内又将该数据中心扩大了一倍。从马斯克的讲述中,我们可以看到打造一个真正的数据中心,并不容易,但其强大的资源整合能力,实现这一目标。

马斯克旗下的 xAI 在落后微软、Meta、OpenAI 几个月时间内,仍然能够推出 Gork 系列模型,并且迅速训练出 Gork-3 赶上 AI 大模型第一梯队。可以看出,快速的响应能力、强大的资源支持,优秀的人才团队都是 xAI 在 AI 大模型竞争中的优势所在。

亲自体验 Grok-3!

9.11 还是比 9.9 大?

据直播透露,Grok-3 在所有性能、所有分类上均比 Grok-2 高上 10 倍。

尽管目前模型还在测试阶段,但在数学、科学和编码基准测试中,Grok-3 得分高于 OpenAI 的 GPT-4o、谷歌的 Gemini、DeepSeek 的 V3 模型和 Anthropic 的 Claude。OpenAI 联合创始人、AI 大牛 Andrej Karpathy 曾在 X 上发布了对模型的初步感受,并写道“感觉它堪比 OpenAI 最强大模型的领先水平”。

直播中,首席工程师 Igro 回应了此前的网友猜测,chocolate 模型正是 Grok-3 的原型,在盲测过程中获得了 1400 分,受到不少用户的喜爱。

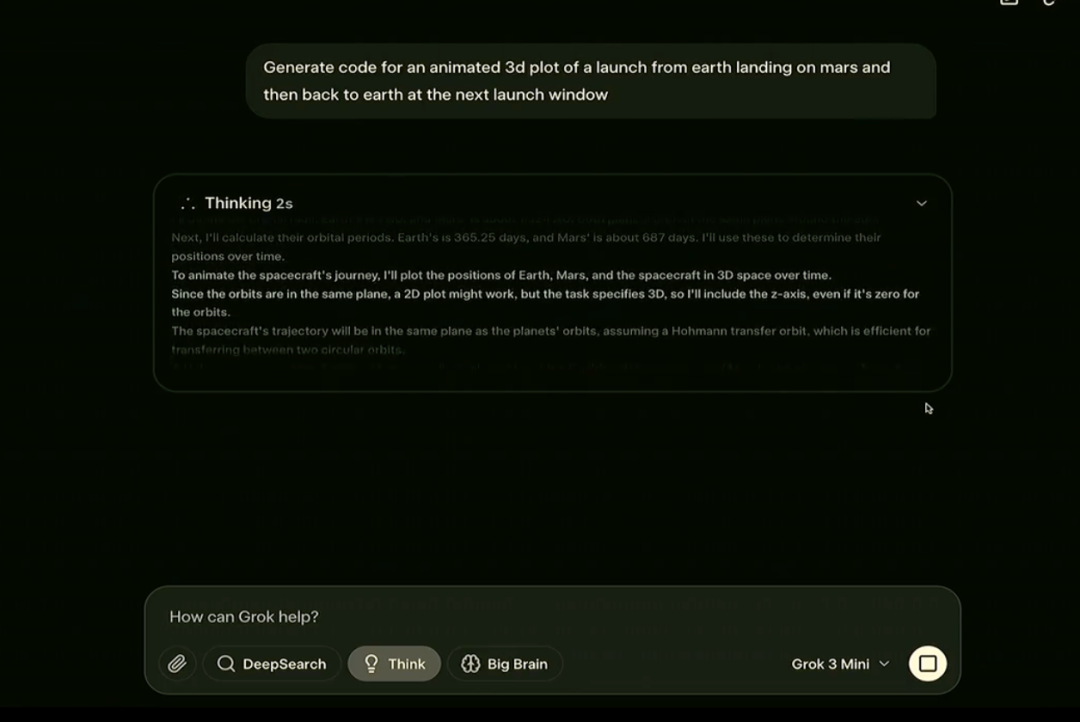

为了体验 Grok-3 的推理能力,xAI 让 Grok-3 做一份火星移民计划,问其人类如何能从火星到地球,并从地球回火星,并形成 3D 动画图。Grok-3 收到指令后马上开始了思考,作为最新具有推理能力的模型,Grok-3 同样能够将思考的过程展现给用户。

但这并非完全展示,马斯克提到为了避免核心逻辑被“抄袭”,他们也将思考的过程做了一部分屏蔽。

同时,xAI 还给了 Grok-3 另一个新的指令,也是 xAI 内部成员最喜欢 xAI 做的事情之一——创造一个颇具创新的游戏,要求集合连连看和俄罗斯方块两种玩法。大约十几分钟后,我们也看到了相关的游戏生成,并且成功运转。

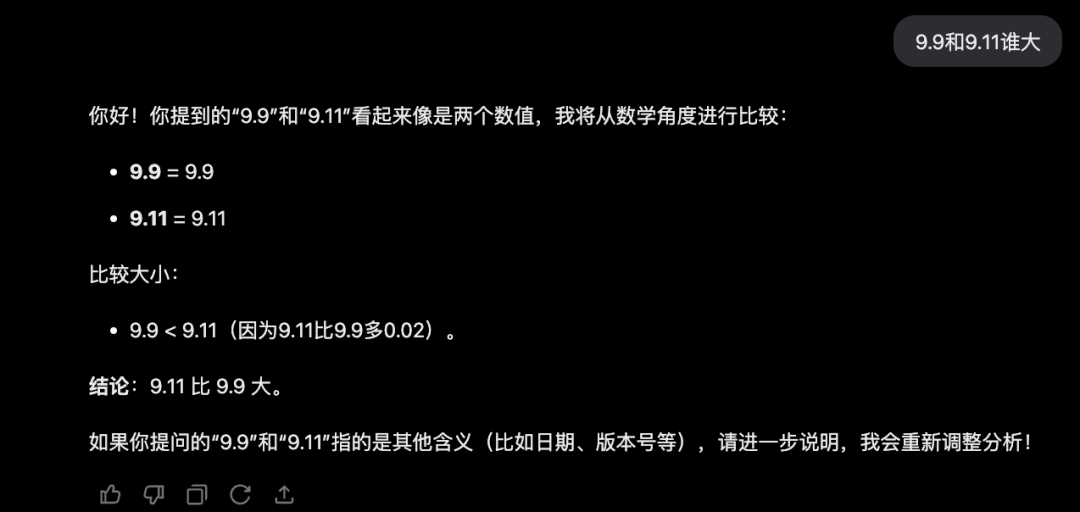

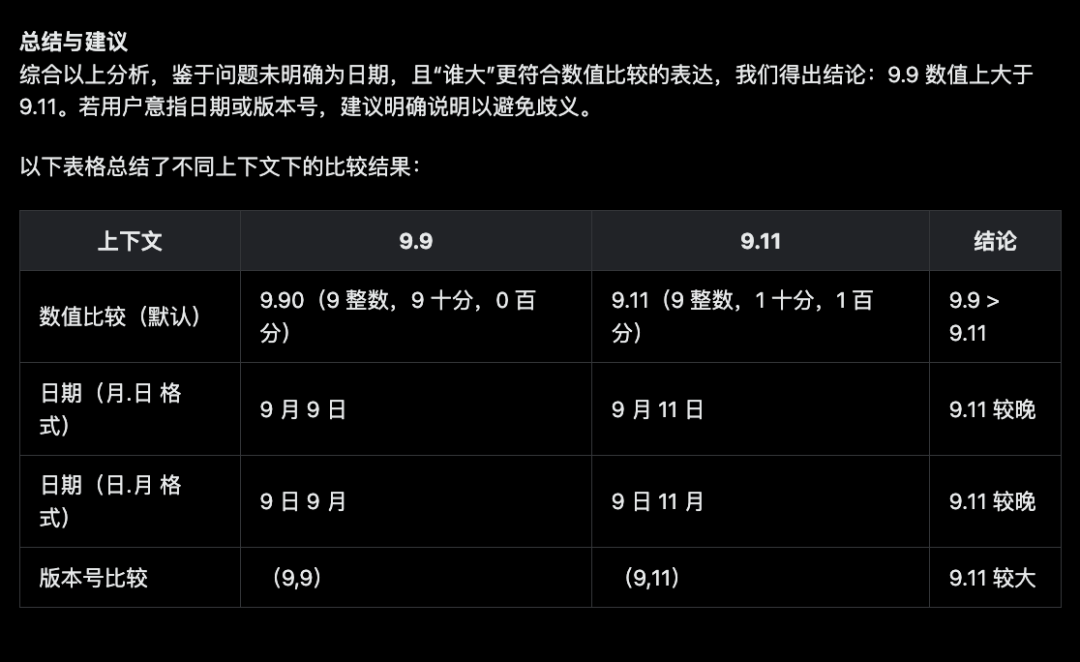

在我们实际测试中发现,Grok-3 的数学水平忽上忽下。比如说,在我们 2 月 20 日体验的时候,Grok-3 仍然分不清 9.9 和 9.11 谁大谁小。

但是,如果你在 Grok-3 中选择 DeepSearch 的话,Grok-3 则会从数十个页面中选择各种信息综合分析,最终给出更为全面的答案。

Grok-3 最为出名的则是其数学、科学等领域的思考能力。我们选择了一道全球奥林匹克竞赛题提问 Grok-3。很遗憾的是,无论是 Grok-3,还是 DeepSearch 版本,答案均错误。

Gork 大模型将冲击图灵奖?

xAI 首次发布 AI agent

正当首席工程师 Igro 想要介绍 Grok-3 时,马斯克颇有闲心谈起来 Grok 的取名由来。Gork 原来是一本小说《Strange Land》里的一个火星人的名字,Gork 本身也代表着深刻理解某件事。看起来,老马在哪里都不忘他的火星梦。

研究工程师 Paul 提到,距离 Gork-1 发布时间刚刚过去 17 个月,但 Gork 系列模型的性能却已经追上全球第一梯队大模型的水平,与 OpenAI 的 4o 模型不相上下。

“我们 17 个月前发布 Gork-0 基本什么都不懂,17 个月后我们终于有一个孩子终于从高中毕业了。现在我们的孩子终于要准备上大学了。”Tony 说道。马斯克说到未来 AI 能够获得一些大奖,如图灵奖或者诺贝尔奖等。这或许也能较为真实反映出 Grok-3 目前的数学水平,和高考生相似。

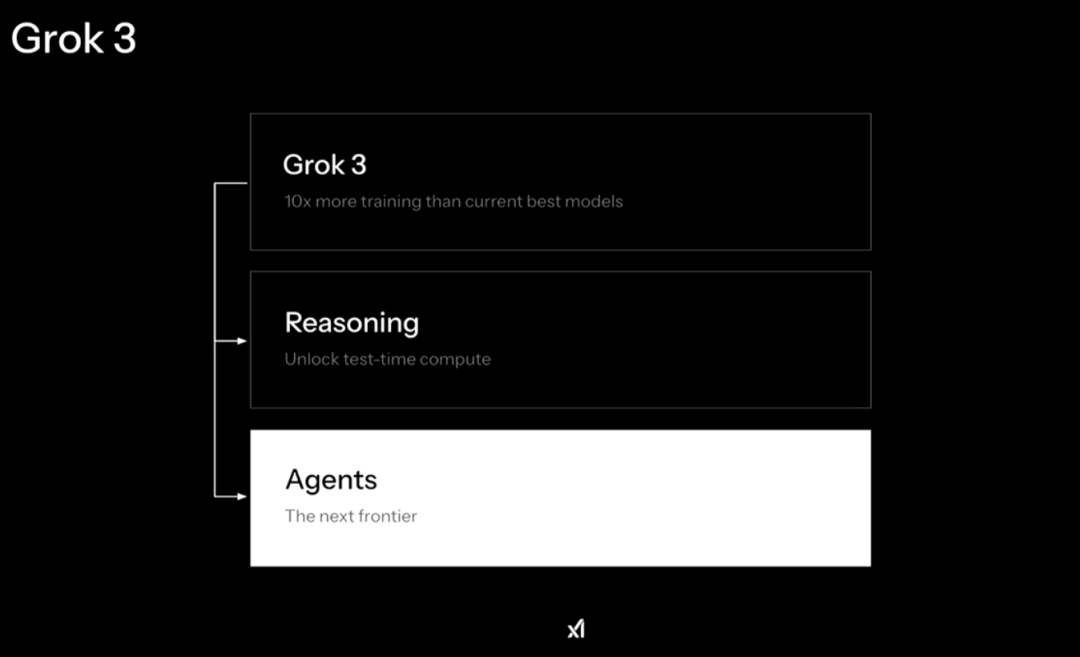

xAI 认为,仅仅有最强的预训练模型,也不足以建立最佳 AGI。“最佳的 AGI 需要像人类一样能够思考,能够自我批判,验证所有的解决方案,且还要从第一性原则中思考。”Igro 说到。

为了达到目的,xAI 将预训练模型和强化模型放在一起训练,激发模型本身的强化推理能力。同时,在 xAI 内部还有一个被称为“Big brain”的模式,能够激发 Grok-3 拥有更多思考能力。

Grok-3 目前有 Resoning Beta 和 mini 两种型号,其中小模型 mini 模式下,能够更快反应,同时其回答质量也能和 Resoning Beta 在同一水准内。

Gork-3 是 xAI 在推理模型上走出的第一步,尽管该模型仍处在完善阶段,但 xAI 仍凭借 Gork-3 赶上了推理模型第一梯队。同时,在直播中 xAI 将 Agent 列为自家大模型系列的下一步,并推出了 Deep Search 产品。

该产品主要帮助工程师、科学家、程序员们进行代码编辑。“有点像是下一代搜索引擎,你可以向其发出提问。”Paul 介绍道。

此次直播最后回到用户提问环节,xAI 谈及了开源问题。一般来说,xAI 会在正式推出下一代大模型时候,会选择开源上一代模型。xAI 在直播时也回应到,当 Gork-3 正式推出后,同样会开源 Gork-2。

扫码关注公众号

获取更多技术资讯