被战争部点名的Anthropic,如何成长为硅谷大模型第三极?

HelloKitty • 2026-03-03 15:57

1775

本文由 数智前线 撰写/授权提供,转载请注明原出处。

以下文章来源于:数智前线

作者:徐鑫

编:任晓渔

过去两个月,Anthropic 正成为硅谷最炙手可热也最具话题性的大模型公司。

几天前,特朗普罕见下令所有联邦机构立即停止使用 Anthropic,战争部长随即将这家公司列为“供应链风险“。这是美国本土大模型公司首次遭遇此类限制,特朗普本人在社交媒体上直言:“他们想要不受约束的权力,我们不能允许。”

而在周末发生的美对伊军事打击中,根据华尔街日报报道,虽有高层禁令,但美军指挥部仍然使用了 Anthropic 旗下的大模型产品 Claude 进行情报评估、目标识别和模拟战斗。

在此之前的一个月,这家公司又在美股市场引发了一场 SaaS 股大流血。投资者担心 AI 正直接蚕食传统企业软件市场而形成“SaaSpocalypse”恐慌,导致 Salesforce、HubSpot 等 SaaS 巨头股价集体暴跌。

同期,Anthropic 还卷入了与当下最火的 Agent 开发框架 Openclaw(最初名为 Clawdbot,也是中文社区的小龙虾)的纷争中。Anthropic 以商标和安全为由封禁了 Openclaw 却意外将这一项目及其创始人 Peter Steinberger 推向 OpenAI 怀抱。

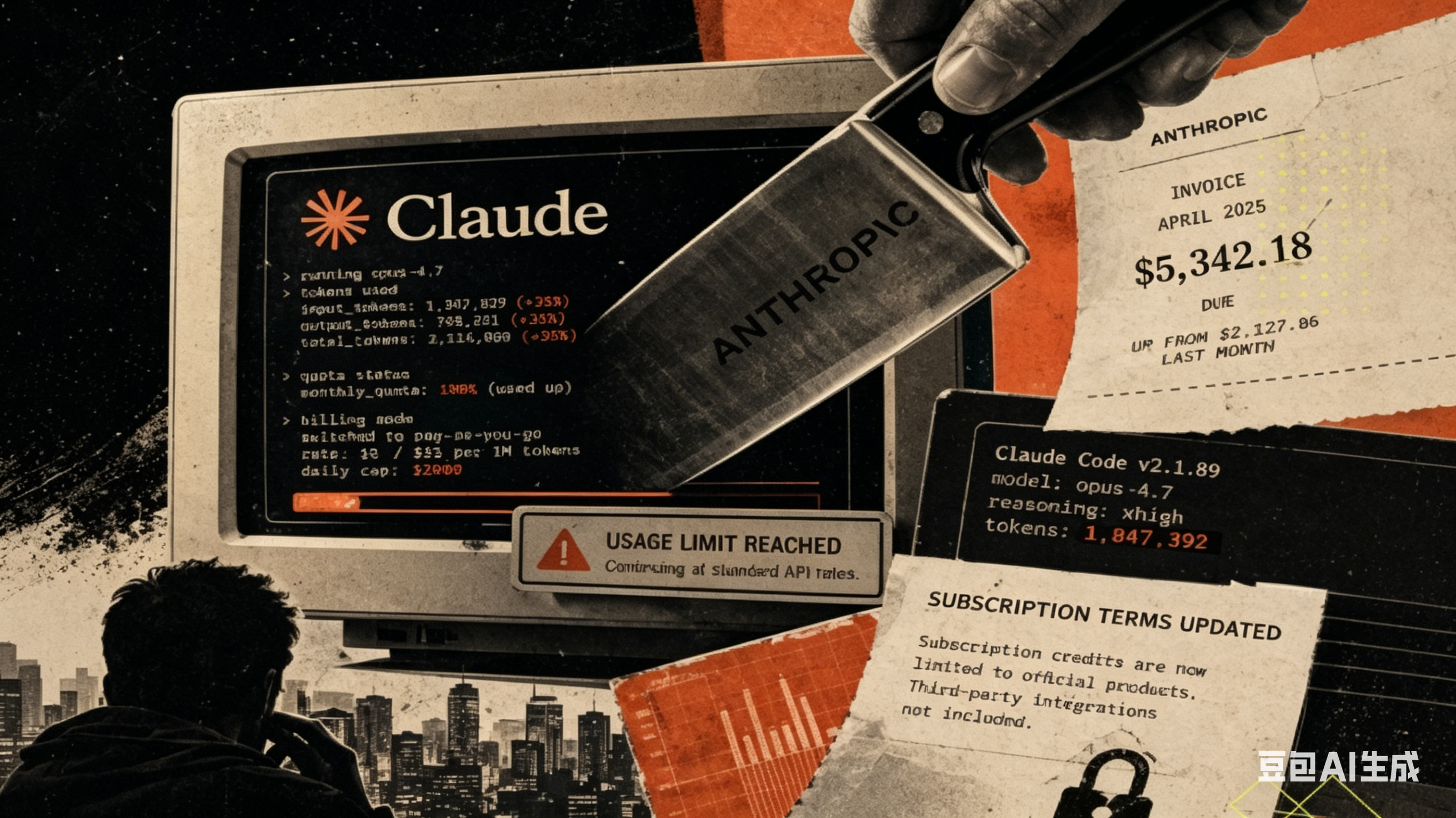

与纷争和风波不断同步的是,风暴眼中的 Anthropic 还在持续增长。根据其在今年 2 月 12 日官网发布的 G 轮融资公告披露,Anthropic 的 ARR 数据已经达到 140 亿美元,尤其是编码工具营收在 1 月以来翻了一番。

国家安全、金融恐慌、巨幅增长,Anthropic 无疑已经成为了硅谷大模型市场里的重要一极。一些机构的统计里,这家公司甚至超过了 OpenAI,悄然引领企业级 AI 市场增长。

那么,这家硅谷大模型第三极到底如何炼成?一家创业公司如何在过去三年成为营收增长最快的软件公司?它为什么受到特朗普及美国国防部门的严厉批评,它又如何在 OpenAI 统治的大模型世界走出与 OpenAI 及谷歌不同的差异化道路?

脱胎于 OpenAI,迥异于 OpenAI

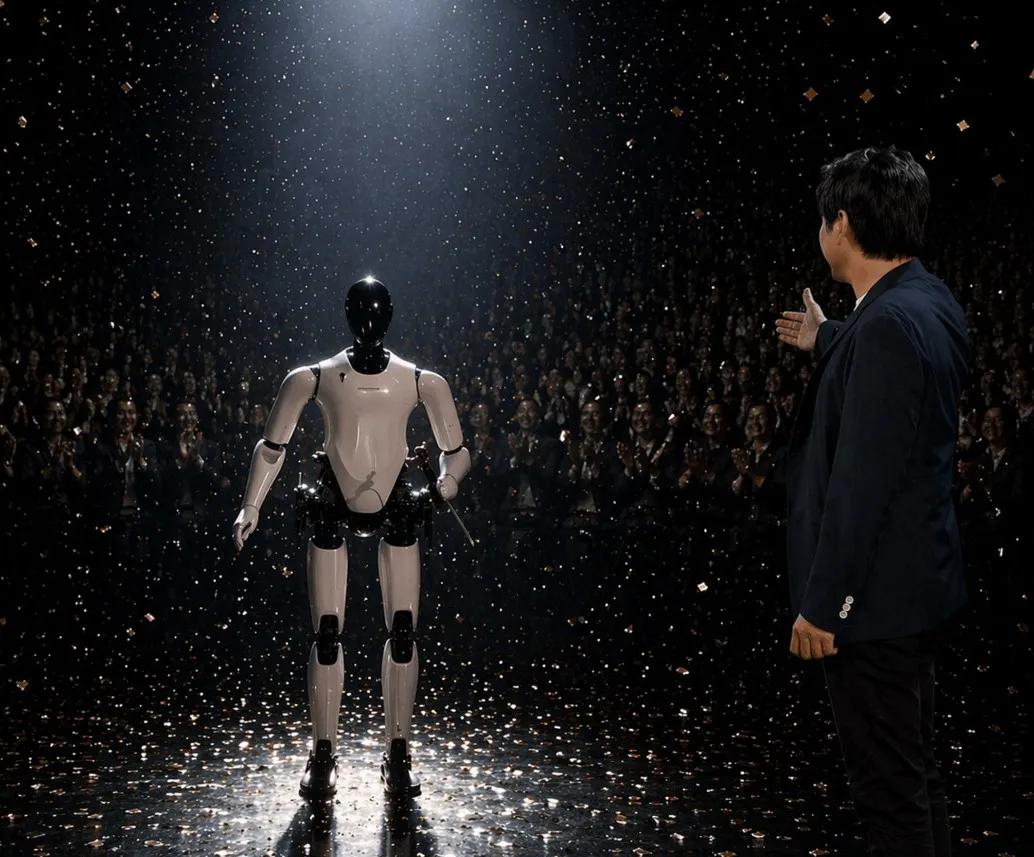

2026 年 2 月 19 日,印度新德里举行的AI影响力峰会上的一个瞬间被全球媒体定格。印度总理莫迪组织科技领袖们手拉手合影时,站在一起的 OpenAI CEO Sam Altman 和 Anthropic CEO Dario Amodei 拒绝握手,而是各自举起拳头。

这一幕迅速在社交媒体上疯传,被称为“AI 冷战”的标志性画面。它也能作为观察 Anthropic 发展历程的极为鲜明的切入口。毕竟,如果把 Anthropic 称为大模型第三极,那么这个第三极的诞生和成长历程与大模型第一极 OpenAI 息息相关。

在 Dario Amodei 与 AI 产业建立联系之前,他的求学经历看起来颇为精英范儿。Amodei 很早展露出出色的物理学天赋,2000 年入选美国物理奥林匹克国家队,随后在加州理工学院和斯坦福大学攻读物理学。

2006 年因父亲罹患罕见疾病去世,他将研究方向转向生物学希望解码人类疾病,最终于 2011 年 获得普林斯顿大学生物物理学博士学位。之后他又在斯坦福医学院从事博士后研究,开发高通量蛋白质分析的计算方法。

横跨物理学、生物学和计算方法的学术训练,使他对复杂系统的量化分析产生浓厚兴趣,可能也为他 2014~2015 年加入百度在吴恩达的麾下从事大模型规模定律的早期研究奠定了基础。

也是在那一时期,埃隆·马斯克和 Sam Altman 等人担心即将爆发的人工智能革命只被谷歌掌握,因而决定成立一家非营利组织 OpenAI。筹备初期,马斯克邀请 Sam Altman, Ilya Sutskever 等一众人士举办过一个晚餐,Dario Amodei 当时也受邀参与。

不过这个晚宴后,Dario Amodei 并没有加入 OpenAI 而是加入了谷歌大脑项目。他在谷歌的十个月如陷泥潭,进展缓慢,于是很快他重做选择,在 2016 年加入 OpenAI 并主管 AI 安全工作。

接下来直到 2021 年二人分道扬镳前,Sam Altman 和 Dario Amodei 共同见证了一个研究实验室向商业巨头的转型。

在这期间,Amodei 主导开发了 GPT-2 和 GPT-3,并与团队共同发明了“基于人类反馈的强化学习”(RLHF)技术,后来所有主流大语言模型都应用了这一技术。而 Altman 则在 2019 年正式接任 CEO,推动 OpenAI 接受微软 10 亿美元投资,并将组织架构从非营利转向“有上限利润”模式。

裂痕也在同期埋下,围绕着产品推出及商业化的进度如何平衡 AI 安全的问题,Amodei 与 Altman 之间存在分歧。

2020 年底,Dario Amodei 带着包括妹妹 Daniela 在内的 14 名核心研究员集体出走。2021 年 2 月,Anthropic 创立。

用 Amodei 的话说,从 OpenAI 出走是因为对 OpenAI 在微软投资后的方向转变感到担忧,他担心 OpenAI 偏离了其原始使命,而微软的加入让非营利组织属性发生变化,AI 技术有可能被大型公司垄断,最终掌握在少数公司手中。在今年 2 月的一次播客访谈里,Amodei 提到了分歧在于他主张更审慎的发布节奏和更严格的安全测试,而 OpenAI 在微软投资后加速商业化。

海外的媒体对其出走的原因也有诸多报道分析。一篇采访了二十多位 Amodei 身边人士的深度报道中写到,Dario 在 OpenAI 中的地位提升,围绕他的争议也随之增加。他是一位多产的写作者,撰写了大量关于价值观和技术的长篇文档,一些同事认为这些文档富有启发性,而另一些人则认为这些文档是在树立旗帜、态度强硬。甚至有人认为他对安全的关注是控制公司的途径之一。

不管怎样,Anthropic 在这时脱胎自 OpenAI,并在成立之初就设计了一套安全优先的治理结构。

一是注册为了 PBC 公司(公共利益公司),这种公司必须同时平衡股东的经济利益以及章程中明确的特定公共利益。Anthropic 章程里明确指出,要“负责任地开发和维护先进 AI,为人类的长期利益服务”。

其次是,设立长期利益信托,由独立受托人监督公司决策,确保不因短期商业压力而牺牲 AI 安全。

时代杂志 2024 年点评称 OpenAI 2023 年的治理危机恰恰验证了 Anthropic 对新型治理结构必要性的判断。

除了发展理念和治理结构,此后 Anthropic 在技术和产品的策略上也沿袭了这种对 AI 安全的重视,最终开启了一条迥异于 OpenAI 的大模型创业之路。

同时,Anthropic 选择把模型调到企业可验证的任务上,让商业客户更有信心。安全性与企业可信度成为核心竞争力,而不仅仅是性能指标。这条路线使 Anthropic 在企业 AI 市场受到关注。

相比而言,谷歌在大模型世界里直到创始人谢尔盖·布林回归,Gemini3 发布,谷歌才凭借着此前积累的全栈能力而重回大模型竞争的头部行列。

与谷歌相比,Anthropic 将 Sonnet 4. 5定位为全球最强的企业级大模型。从 Claude 3 到 Claude 4.5,Anthropic 的迭代速度超过 Google 的 Gemini 系列。

企业级市场的发展战略,如何形成?

上个周末美对伊的军事行动被不少人士界定为一场 AI 战争,Anthropic 和 Plantir 被视作美军成功实施打击的秘密武器。当然之后又有分析文章称 AI 自动化打赢战争的情况并不属实。

但这些新动向都发生在特朗普及五角大楼对 Anthropic 禁令之后的几小时里,也让 Anthropic 所聚焦的 AI 安全问题有了真实的锚点。而这场对持,也向大众提供了一个观察视角,从中能看到 Anthropic 的 AI 安全观以及它与 OpenAI 之间的差异。

起因在上个月五角大楼要求 Anthropic 移除 Claude 模型上的安全护栏,以便在“所有合法用途”中使用该模型。Amodei 明确拒绝,称即使在美国国防部施压的情况下,也不会移除其前沿 AI 模型 Claude 的安全措施。“我们无法在良心上同意他们的要求”,Amodei 在一封 800 词的声明中写道。

这份声明里还提到一个点,“Anthropic 是首个将模型部署到美国政府机密网络、首个在国家级实验室部署模型,以及首个为国家安全客户提供定制模型的人工智能公司。”但 Amodei 警告说,国防部提出的“任何合法使用”的要求将迫使公司跨越两条红线,即大规模国内监控和完全自主武器。

就在 Anthropic 被威胁列入供应链风险名单的几小时后,Sam Altman 宣布 OpenAI 与国防部达成协议,允许其模型部署在军方机密网络中。

两相比较,能看到两家公司在 AI 安全上的不同态度。

Anthropic 主张在技术层面来限制需求,而 Altman 则更倾向于选择通过合同条款和政策框架来约束,最终 OpenAI 选择与美国国防部合作。Altaman 在达成协议后称,协议里包含了“技术保障措施”和“红线”限制,如不用于国内大规模监控和完全自主武器。

这种态度差异呼应了 Anthropic从 OpenIA 出走的原因。某种程度而言,它反映出两家公司对安全及商业利益的不同排序,最终又与两家公司所服务的市场形成了相互强化的闭环,OpenAI 更重视t oC,追求增长,而 Anthoropic 追求安全和稳定最终走了 ToB 路线。

Anthropic 从 2023 年发布 Claude1 以来的技术产品布局,也都一步步朝向打造企业级市场影响力而推进。

2022 年 12 月 1 日,OpenAI 发布 ChatGPT 时一开始就面向全球公众,而 2023 年 3 月,Claude 1 和 Claude Instant 发布时仅面向经审核的企业用户。

今年 2 月 Amodei 还在接受播客采访时说,它们早在 2022 年就有一个早期版本的 Claude 1,早于 ChatGPT 的发布,但他们选择当时不公开发布,因为担心会"引发军备竞赛,没有足够时间安全地构建这些系统"。这些动作给人一个印象是,比起安全,Claude 并不十分在意在消费者市场占得先机。

更强的长上下文窗口的支持能力,也在让 Claude 比 ChatGPT 更贴合企业级市场的复杂工作流。

追溯 Claude 的更新换代历程能看到,它在 2023 年 5 月开始将上下文支持能力从 9K 扩展到能支持 100K tokens 的上下文。而 2023 年 3 月 GPT-4 发布最高 32K Tokens 的上下文,之后直到 2023 年的 11 月 GPT-4 Turbo 发布时才支持 API 调用时可达 128K,ChatGPT Plus 用户实际只能用 32K。

2024 年 3 月,Claude 3 发布又全线支持 200k,重新拉开了与 OpenAI 的差距。

如今,二者在企业市场的上下文支持能力都达到了 1M tokens,但外界认为,在 2023 年到 2024 年,长上下文能力是 Anthropic 在企业市场的核心卖点之一。正如 Anthropic 官方提到,“企业客户有高达 50% 的知识库以 PDF、流程图、演示文稿等形式存在,长上下文能力让 Claude 可以一次性处理整个代码库、数百页法律文档或销售记录”。

2024 年之后,Anthropic 的产品矩阵也明显更重视企业级市场的应用。

比如,2024 年 7 月推出的 Artifacts 将 Claude 从"对话工具"转变为"协作工作区",有投研机构认为它解决了"如何让 AI 智能无缝融入现有工作流"的核心挑战。2024 年推出的 Projects 也增强了面向团队的知识管理和协作能力。

更大的向开发者及企业市场渗透的动作当属 2025 年 2 月发布的 Claude Code。作为一款可直接在终端运行的 agentic 编程工具,它完成了从代码补全到给 AI 委托完整任务的进化。

AI Code 是当下 Tob AI 应用渗透率最高赛道,Anthropic 目前已经在市场上形成了代码能力强的认知,这无疑能强化它在企业级市场的优势。

它还有其他动作,如发布 MCP 协议作为底层标准,进而开发 Skills 工具集,并于 2026 年 2 月推出面向终端用户的 Cowork Plugins 插件市场,便利企业部署定制化的 AI 工作流。

尤其是 2 月初,当 Anthropic 宣布法律领域插件时,Thomson Reuters 和 LegalZoom 等法律科技公司股价应声下跌。这也显示出,Anthropic 向企业 AI Agent 市场进入的纵深度。

竞争白热化,安全正成为其竞争的工具

与它在企业级市场开拓同步的,是 Anthropic 在市场叙事上刻意打造的可信企业专家形象。

由于 AI 竞争日益白热化,Anthropic 在打造自身的企业级可信形象时,日益呈现出鲜明的防御性与攻击性。

比如,今年 2 月,Anthropic 在超级碗投放了四个意有所指的广告,矛头直指 OpenAI。每支广告都以一个带有强烈负面情绪的单词开场,展示的是一个普通人向 AI 寻求建议时被无关广告打断的荒诞场景。

在其中一则广告里,一名男子在 AI 助手化身的健身教练的指导下训练。当男子需要制定健身计划时,AI 助手突然插入了广告。画面最后出现了一句话,Ads are coming to Al. But not to Claude。这批评的当然是 OpenAI 此前宣布在大模型聊天助手里推出广告功能。

除了这次针锋相对以外,2025 年 5 月 Anthropic 也干过类似的事。

当时他们在旧金山投放广告,广告牌上写着“你可以信任的 AI”和“没有那些戏剧性的那个”,人们普遍将之解读为影射 OpenAI 在 2023 年 11 月的董事会政变。

Sam Altman 没有沉默下去,他反击称 Anthropic 言辞不诚实,并且称该公司只向富人提供昂贵的产品,而 OpenAI 强烈认为需要将 AI 带给数十亿无法支付订阅费用的人。

除了攻击 OpenAI,对待来自中国的开源竞争对手,Anthropic 也有不少的动作。

去年 DeepSeek 狂潮席卷全球,面对开源冲击,Dario Amodei 在个人博客发表长文,将芯片出口管制提升到国家安全的高度,称其为"决定我们最终处于单极还是双极世界的最重要因素"。去年 2 月,Anthropic 还呼吁针对先进 AI 芯片和模型权重进行出口管制。

甚至在今年 2 月特朗普政府允许出售 H200 新品时,Amodei 还公开抨击这一政策,称是将技术领先优势交给竞争对手。

他的芯片管制言论当然受到了英伟达 CEO 黄仁勋的反对,不少人认为这是利用国家安全的名义来进行商业竞争,维系自身优势。

就在 2 月与国防部门的对峙之际,Anthropic 还发布了措辞强硬的"技术报告",指控 DeepSeek、Moonshot 和 MiniMax 进行"工业规模的蒸馏攻击"。报告发布时间恰逢 Amodei 被召至国防部接受"质询"之际,也有人认为这是在重塑 Anthropic 的美国"爱国守护者"的形象。

回顾 Amodei 对中国 AI 的态度,突变点发生在 2025 年 DeepSeek 发布后。此前,他对百度在吴恩达麾下的时光时曾公开表示那段时间是他进入 AI 的重要启蒙。而随着 DeepSeek 在推理能力上的突破,他对中国 AI 转向了更激进的态度。某种程度而言,这反映了美国 AI 产业内部对中国竞争的深度焦虑。

相比 1985 年出生的 Sam Altman 的高调和举世闻名,外界对 1983 年出生的 Dario Amodei 了解不算多。Dario Amodei 更为内敛,更重视隐私,他没有 X 账号,很少抛头露面。他的公开采访也主要集中在技术和政策议题上,且多为深度技术讨论而非营销宣传,外界通常将他视作一位技术专家型 CEO。

而 Sam Altman 则被视作管理型 CEO,职业创业者和投资人出身,擅长管理和整合资源人脉,擅长利用公众影响力塑造公司形象。

但从过去一年 Dario Amodei 在面对不同竞争对手采取不同竞争策略的举措来看,Dario Amodei 明显是一名审慎、低调,能在行业激烈竞争中利用不同资源来压制对手的人。同时,他的议程设置策略明显不可小觑。

在 Sam Altman 与美国五角大楼宣布合作后,社交媒体上掀起了抛弃 ChatGPT 转投 Claude 的 活动,2 月 28 日 Claude 在 AppStore 上登顶。

Dario Amodei 强烈的竞争意识从何而来?也许就来自这个行业的激烈竞争和天量投入带来的生存焦虑。

在最近的一个播客访谈中,Dario Amodei 认为 AI 的进步将继续,但可能不会像许多人预期的 那样保持陡峭、不间断的上升。他解释称,哪怕收入预测只偏差 20%(从 1 万亿降到 8000 亿),即使 AI 能力最终实现,但只要晚一年,公司可能就会破产。因此他在 AI 投入上也十分稳健,500 亿美元基础设施投资计划远低于 OpenAI 的承诺。

激烈的行业竞争甚至还在侵蚀 Anthropic 对安全的承诺。TIME 杂志 2 月 24 日发布的独家报道显示,Anthropic 正放弃核心安全承诺——除非能事先保证公司的安全措施足够,否则绝不训练 AI 系统。他们在相关政策里删除了禁止公司在安全措施未到位前训练更强大模型的硬性限制。一些评论人士认为,评估和缓解风险的方法跟不上能力发展的速度。

虽然因“AI 安全”考量拒绝了美国国防部门的施压,但在大模型市场的激烈竞争下,Anthropic 最终也许难以维持它曾经引以为傲的差异化承诺。

扫码关注公众号

获取更多技术资讯