语音一夜成AI圈香饽饽:GPT-RT2上线,奥特曼说爱打字的是老登?

HelloKitty • 2026-05-09 14:47

89

本文由 雷科技AGI 撰写/授权提供,转载请注明原出处。

以下文章来源于:雷科技AGI

作者:天星

2024 年 2 月,OpenAI 发布了 Sora。这个能生成视频的 AI 模型用极短的时间改写了移动互联网时代的内容创作方式,甚至连迪士尼都曾计划为此注资十亿美元,并计划在 Sora 2 中引入自己的核心影视 IP。但就在 26 年 3 月,OpenAI 宣布关闭 Sora,相关 API 也会在 9 月停止提供。

对此,OpenAI 的解释是「将计算资源重新分配至核心企业产品」。

那到底是怎样的产品值得 OpenAI 不惜「壮士断腕」呢?刚刚过去的四月里,OpenAI 先后发布了 GPT-Image 2.0、GPT-5.5 等新服务。5 月 7 日,OpenAI 也乘胜追击,接连上线了 GPT-5.5 Instant 和今天我们要谈的重点——GPT-Realtime-2 系列模型。

GPT RT2让 AI 像真人一样说话

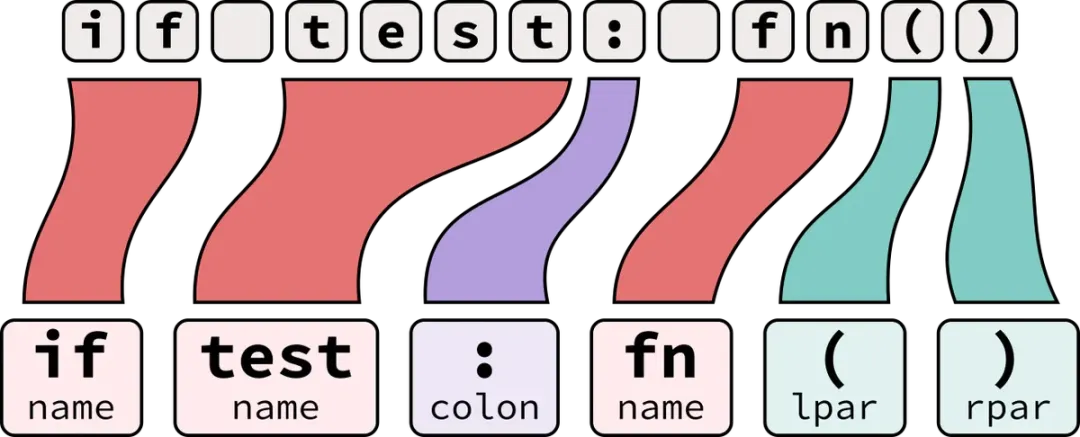

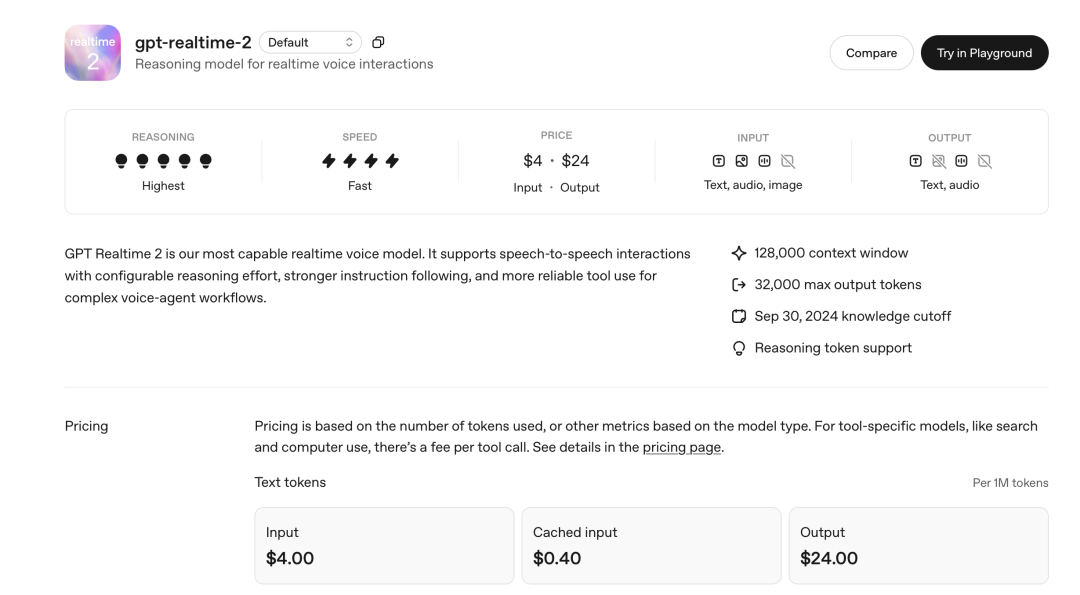

简单来说,GPT-Realtime-2(简称GPT RT2)是一个全面优化 AI 语音能力的模型系列,包含原版(GPT-Realtime-2)、翻译(GPT-Realtime-Translate)和转录(GPT-Realtime-Whisper)三个分支。其中 GPT-Realtime-2 具备 GPT-5 级别推理能力,开发者甚至可以自定义模型的推理深度,在准确性、时效性和算力成本之间找到自己的平衡。

图片来源:OpenAI

而这些新技术的目的有且只有一个——让 AI 能像真人一样说话。

我知道,其实现在不少 AI 模型在 TTS 音色上已经和真人非常接近了,大家平时接到的运营商、银行的骚扰电话,十有八九就是 AI 打出的,在通话的「全损音质」下,想分清对方是真人还是 AI 确实有点难度。

但只要我们一张嘴,这些 AI 客服就会马上露馅,在雷科技看来,这种 AI 语音模型和真人的能力差距,主要体现在复杂任务处理能力上。以一个经典笑话举例:

下班路上买一个西瓜,如果看到苹果,就买两个。

没有推理能力的 AI 会按照自己的想法把「就买两个」的对象当成西瓜或苹果;而有推理能力的 AI 会发现这是个有歧义的病句,反过来要求用户给出更清晰的要求。再举一个例子:你要求车机「折叠副驾驶位,打开零重力模式」时,车机是否能主动推理出你要打开零重力模式的,其实是副驾驶后排的座位呢?

而 GPT-Realtime-2 的出现,就给 AI 带来了真正理解用户需求的能力。

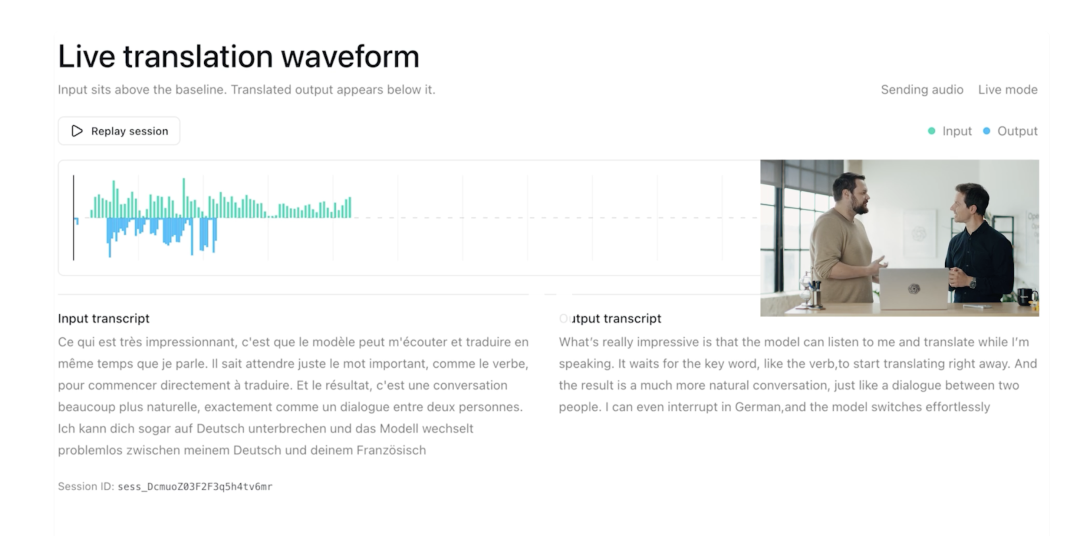

除此之外,GPT-Realtime-2 的平行工具调用(Parallel tool calls)可以一次拉起多个组件,以响应用户的复杂语音指令;GPT-Realtime-Whisper 可以以近乎实时的速度把语音转写成文档,让「实时字幕」成为可能;GPT-Realtime-Translate 的同步翻译功能可以在对方还在说话时直接生成语音译文,效率堪比同声传译。

图片来源:OpenAI

毫不夸张地说,GPT-Realtime-2 的出现,很有可能会改变未来 AI 的交互方式,让语音交互取代文字,成为未来日常 AI (非工作等生产力 AI)的主要交互模式。

「老登」习惯打字,年轻人爱动口?

但话又说回来,在语音交互赛道上发力,其实是近几年 AI 赛道的共识了:

5 月 7 日千问 PC 端上线 AI 语音输入,用极强语义解析能力打造了可以用于工作场景的 AI 用例,在此之前,豆包、Claude、ChatGPT、Gemini等AI均已支持桌面语音模式,允许用户用嘴与AI交互,包括编程;4 月 27 日影石 Insta360 联手字节跳动 AI 编程平台 TRAE 推出了适用于 Vibe-Coding 的领夹麦克风;4 月 23 日涂鸦在全球开发者大会上发布了 PVAD 自训练模型和 TTS增强引擎,提出了 LUI(语言交互界面,与图形交互界面 GUI 对应)的概念。

甚至在就在今天,马斯克也在 X 上为 xAI 的打造的 Grok Voice Think Fast 1.0 语音助手宣传造势。

图片来源:X

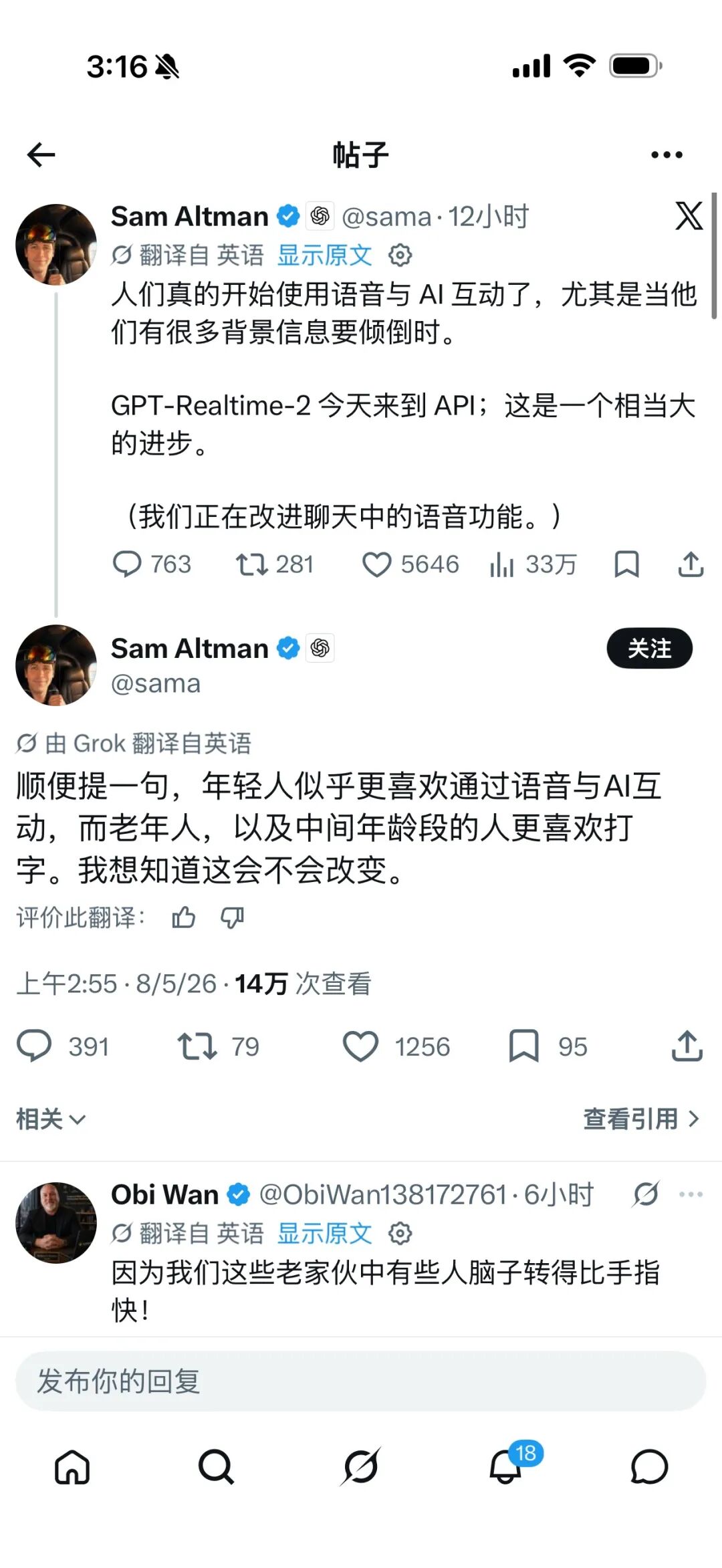

那为什么 2026 年的 AI 战场会落在语音交互界面上呢?OpenAI CEO Sam Altman 就提到了一个观点:

顺便提一句,年轻人似乎更喜欢通过语音与 AI 互动,而老年人以及中间年龄段的人更喜欢打字。我想知道这会不会改变。

在雷科技看来,这一现象背后不仅是习惯问题,也是年轻人与中年人思维模式的差异。对于在全时在线、触屏环境中长大的 00 后、10 后(以及诞生于语音交互时代的 20 后)来说,键盘带有浓厚的「班味」,除了打游戏外几乎不会碰。

图片来源:X

顺着这个角度想,在过去 20 年里,键鼠组合高效、精准的输入方式为 PC 的生产力工具的身份打下了基础,但也限制了我们「必须在电脑前才能工作」。而 LUI 的出现改变了这个刻板印象:起身接杯水也好、下楼透气也好,甚至只是瘫在椅子上思考时,AI 都能通过我们的「只言片语」跟上我们的思维,让灵感随时在线。

事实上,语音输入「有效信息含量低」的特点,也确实只有 AI 可以解决。以千问今天上线的 PC 端上线 AI 语音输入为例,雷科技简单体验了一下。除了基础的语音输入外,千问 PC 语音输入还可以自动过滤掉说话过程中那些没有意义的语气词、填充词。

比如在输入图中这个需求时,我几乎在每一个停顿处都加入了大量的「呃」「就是」,千问也能直接过滤掉。

图片来源:雷科技

不可否认的是,在办公室等公共场所使用语音输入,多少会对其他同事产生影响。但 AI 语音能力的提升,确实让语音输入在工作场景也具备了「实用性」,如果你像年轻人一样说话跳脱、思如泉涌、「脑子比嘴快」,又或者喜欢用语音输入,那千问的语音输入功能对你确实很有帮助。

从这个角度看,拥抱语音交互,本质上是 AI 巨头们在抢占这些年轻用户的市场。谁能把语音交互做稳,谁就能垄断这些年轻人碎片化时间的「交互主权」。

其实这种迎合下一代使用习惯,超前建立用户粘性的做法也并非新鲜事,MacBook Neo、Chromebook、iPad 等电子产品在海外烧钱发力教育市场,背后也是同样的逻辑。

只不过在雷科技看来,除了面向下一代的超前布局外,AI 巨头不约而同发力 LUI,背后还有别的推动力:LUI 和 AI 的的终极目标一致,都带有「永远待命、随时可用」的属性。

文字界面(TUI、命令行)也好、图形界面(GUI)也罢,经过多年的发展,这类视觉交互能覆盖的场景早已到头。但在开车、锻炼、下厨、洗澡这些「手脚被占用」的场景里,语音交互的价值仍未被完全挖掘。

以最常见的驾驶场景为例:为了填补实体按键缺失带来了交互空白,国内新能源品牌早已在 LUI 语音交互界面上发力;对着车机下超长复杂指令,也成为了大家体验智能座舱时的保留节目。

作为回应,不少车企也开始与头部 AI 企业合作,利用外部的语音大模型完善智能座舱的体验。比如在去年的广州车展上,不少车企就向雷科技透露自己的车机「融入了豆包」的能力。

图片来源:雷科技

可以说,在 AI 市场风起云涌的 2026 年,哪家 AI 企业能抢先完善 AI 语音,带领行业从 GUI 交互走向 LUI,谁就能抢先一步吃上「新的蛋糕」。

语音成了 AI 硬件交互的入口

即使我们抛开 LUI 这种长远命题不谈,从用户、智能硬件的角度来看,语音交互其实也是加速 IoT 设备转型为 AIoT 设备的捷径。

以往的智能硬件要变「聪明」,需要堆屏幕、堆算力芯片。而 AI 语音对设备端的硬件要求极低,一个用来收音的麦克风、一个处理音频数据的计算模块、一个用于跑端侧模型的算力平台(这个对部分 AI 硬件来说甚至是可选项)再加上最基本的网络连接能力,任何一个曾经不起眼的 IoT 产品,都能摇身一变成为 AIoT 硬件。

图片来源:雷科技

为雷科技报道海外展会和高管群访立下汗马功劳的钉钉 A1 录音卡就是最好的例子。过去雷科技也试过不少智能录音设备,甚至买过运行端侧本地模型的智能录音笔。但受模型能力限制,这类「智能录音笔」效果通常都不尽如人意。

不过钉钉 A1 就没有这个问题了:手机里装着完整的大模型,能以近乎同步的速度输出翻译结果。而把转写、翻译的任务交给手机后,A1 里的端侧小模型也能将更多的资源用在语音拾取、降噪等方面,从源头优化录音效果。

在录音、转写、翻译这三大功能外,钉钉 A1 录音卡也充分发挥了 AI 智能体的能力,可以将录音内容直接转化为符合标准格式的会议记录、待办事项,甚至可以在基础上对内容进行二次深度理解。

而从产品多样性的角度看,除了给传统 IoT 设备「赋能」外,AI 语音交互的出现甚至催生了不少 AI 新概念产品。像科大讯飞就基于其在语音识别领域多年的技术积累,打造了包括 AI 翻译机、AI 墨水屏办公本、会议耳机、AI 眼镜甚至是 AI 键盘、AI 鼠标等产品。

尽管产品品类繁多,但按照其对 AI 技术的应用,雷科技认为这些 AI 产品依旧有一条横跨品类的「主线」——用语音 AI 丰富硬件的交互方式,从而优化产品的体验。

图片来源:讯飞

以讯飞的 AI 办公本为例,受限于像素响应时间,电子墨水屏设备天然就不适合键盘输入。用过 Kindle 的朋友应该对 Kindle 连 Wi-Fi、打密码的流程深有体会。这种输入手段的缺失让电子墨水屏设备长期以来只能当作单纯的「显示设备」,不具备真正的办公能力。

但 LUI 的出现改变了电子墨水屏「只有输出没有输入」的局面:讯飞星火大模型的外语和方言识别能力,解锁了电子墨水屏的输入能力,让墨水屏从「显示器」真正升级成了「办公本」。搭配图片理解等多模态输入能力,讯飞早已将电子墨水屏设备打造成了「全能办公设备」。

可以说,无论从产品、用户还是 AI 供应商的角度看,语音交互对 AI 的重要性都毋庸置疑。

中国 AI 的优势:更会听/说中文

另外,发力 AI 语音交互对国内 AI 巨头来说,其实还有另一个意义——中国的 AI 公司,天生更懂中文。

按第一语言(母语)来算,中文是世界使用人数最大的语言;按照总使用人数(母语+第二语言)来计算,中文是世界使用人数第二大的语言。

可能有人认为「懂中文」只对国内用户有意义,上升不到国际角度,但事实并非如此。雷科技前段时间去美国旧金山参加了追觅的发布会,更早之前也在巴塞罗那、柏林等非英语城市参与了海外展会的报道。

就雷科技的所见所闻而言,大量一代移民即使身处海外,也只会说中国话(主要为粤语)。很多上年纪的华人即使在温哥华、旧金山、巴塞罗那、墨尔本等移民城市生活多年,依旧过不了最基本的入籍语言关。

很显然,他们也有使用 AI 的需求,甚至对于不会打字的老人群体来说,语音交互是他们使用电子产品的唯一手段。但无论 Google 的 Gemini、OpenAI 的 ChatGPT 或 xAI 的 Grok,其对中文语音的支持都相当有限。以 ChatGPT 为例,过年策划主流 AI 助手中文和方言支持时,雷科技就发现 ChatGPT 并不能稳定、持续输出广东话,说着说着就会自动切换回英语。

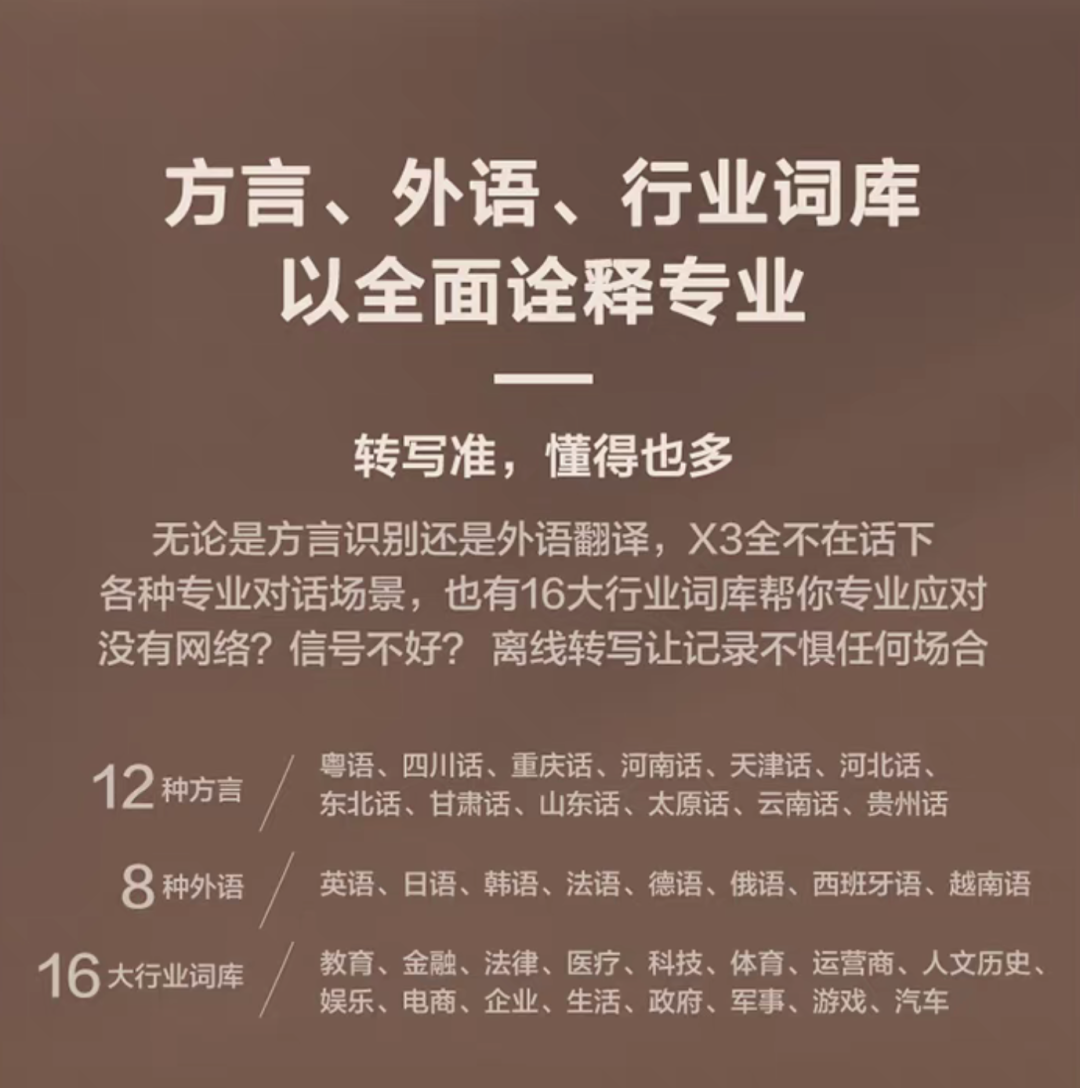

对 ChatGPT、Gemini、Grok 来说,「说中文」是个不小的挑战;但对豆包、千问、Kimi、讯飞等国内 AI 服务来说,这恰恰是「与生俱来」的优势。

图片来源:豆包

相比英语,中文存在大量的倒装、省略以及「只可意会」的潜台词。再加上中国庞大的方言体系,广东话、四川话、东北话……每一个方言背后都是一套独立的文化逻辑。海外巨头的大模型虽然能翻译中文,但在处理带口音的口语、特定语境下的俚语时,往往无从下手。

而这恰恰为豆包、千问、讯飞等国内头部品牌建立了天然的护城河。像刚刚提到的千问 PC 端语音输入能力,甚至可以对语音素材进行规整,精准找到用户语音中的重点,不需要用户「意思意思」。前几年,商汤甚至还推出了首个面向粤语用户的 AI 服务「日日新」。

不可否认,无感 AI 交互是一切 AI 服务的终极目标。但在这种主动感知 AI 交互普及之前,语音依然是最高效、最直接的桥梁。国内 AI 行业通过死磕中文和方言,实际上也换来了「海外华人」这一被海外 AI 巨头长期忽略的用户群体,找到了一条跻身世界头部品牌的快车道。

2026 年,AI 竞争逻辑已经倒转:以前的 AI「需要人学」,现在的 AI「拼命学人」。随着语音交互、LUI 等概念的普及,那个对着输入框抠字的日子,真的该翻篇了。

扫码关注公众号

获取更多技术资讯